Uncertainty-Guided Likelihood Tree Search

作者: Julia Grosse, Ruotian Wu, Ahmad Rashid, Cheng Zhang, Philipp Hennig, Pascal Poupart, Agustinus Kristiadi

分类: cs.LG

发布日期: 2024-07-04 (更新: 2025-09-04)

备注: 10 pages

💡 一句话要点

提出不确定性引导的似然树搜索算法,解决序列决策中奖励稀疏问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 树搜索 不确定性引导 似然函数 序列决策 奖励稀疏 探索与利用 语言模型 路径规划

📋 核心要点

- 现有树搜索方法在奖励稀疏场景下效率低,尤其是在需要昂贵评估(如LLM查询)时。

- 论文提出一种基于似然正则性假设的概率搜索启发式方法,引导树搜索过程。

- 实验表明,该方法能以更少的评估次数找到高似然路径,适用于大规模实际应用。

📝 摘要(中文)

本文提出了一种不确定性引导的树搜索算法,用于奖励函数是路径对数似然函数的场景。由于树规模的组合爆炸,可以获得奖励的路径集合非常稀疏,尤其是在通过昂贵的评估(例如查询大型语言模型)获得似然时。为了解决这个挑战,我们推导出了一种基于似然正则性假设的概率搜索启发式方法。与现有的树搜索方法不同,该方法可以执行回溯并权衡探索与利用,并且不需要昂贵的roll-out或复杂的贝叶斯推理。通过在及时的大规模实际应用中进行广泛的on-model和off-model实验,我们证明了该方法能够以更少的代价昂贵的评估来识别具有高似然的路径。

🔬 方法详解

问题定义:论文旨在解决序列决策问题中,奖励函数为路径似然函数时,由于搜索空间巨大且奖励稀疏,传统树搜索算法效率低下的问题。尤其是在似然评估需要昂贵计算资源(例如查询大型语言模型)时,问题更加突出。现有方法要么需要大量的roll-out,要么需要复杂的贝叶斯推理,计算成本高昂。

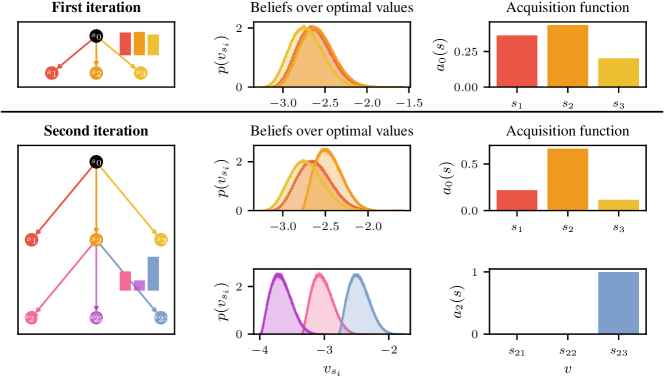

核心思路:论文的核心思路是利用似然函数的正则性假设,构建一个概率搜索启发式,引导树搜索过程。通过估计节点的不确定性,算法能够自适应地平衡探索(探索不确定性高的区域)和利用(利用已知的高奖励区域),从而更有效地找到高似然路径。

技术框架:该算法是一种树搜索算法,其主要流程包括:1) 从根节点开始,根据概率搜索启发式选择下一个要扩展的节点;2) 对选定的节点进行扩展,生成新的子节点;3) 对新生成的子节点进行似然评估(即计算奖励);4) 根据评估结果更新节点的不确定性估计;5) 重复步骤1-4,直到达到预定的搜索深度或计算资源限制。算法支持回溯,允许在搜索过程中返回到之前的节点,从而避免陷入局部最优。

关键创新:该方法最重要的创新点在于其不确定性引导的搜索启发式。与传统树搜索方法不同,该启发式不仅考虑了节点的奖励值,还考虑了节点的不确定性。这种不确定性估计允许算法在探索和利用之间进行权衡,从而更有效地搜索稀疏奖励空间。此外,该方法不需要昂贵的roll-out或复杂的贝叶斯推理,降低了计算成本。

关键设计:论文中,不确定性估计的具体方法未知,但可以推测是基于已评估节点的似然值,通过某种回归或插值方法来估计未评估节点的似然值,并计算其不确定性。概率搜索启发式可能基于Upper Confidence Bound (UCB) 或 Thompson Sampling 等策略,将奖励值和不确定性结合起来,指导节点选择。具体的参数设置和损失函数未知,需要参考论文原文。

🖼️ 关键图片

📊 实验亮点

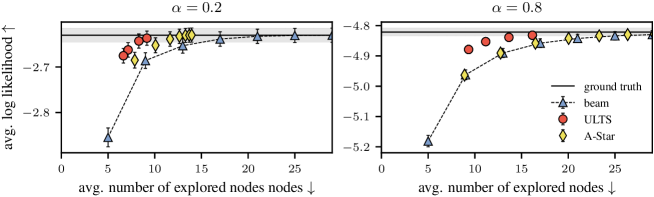

论文通过on-model和off-model实验验证了所提出方法的有效性。实验结果表明,该方法能够以更少的评估次数找到具有高似然的路径,显著优于现有的树搜索方法。具体的性能数据和提升幅度未知,需要参考论文原文。

🎯 应用场景

该研究成果可应用于各种序列决策问题,尤其是在奖励函数是路径似然函数且评估成本高昂的场景。例如,可以用于自然语言生成任务中,优化生成的文本序列以最大化语言模型的似然;也可以用于机器人路径规划中,优化机器人的运动轨迹以最大化某种目标函数的似然。该方法能够降低计算成本,提高搜索效率,具有重要的实际应用价值。

📄 摘要(原文)

Tree search is a fundamental tool for planning, as many sequential decision-making problems can be framed as searching over tree-structured spaces. We propose an uncertainty-guided tree search algorithm for settings where the reward function is a log-likelihood function of the paths. Due to the combinatorial explosion of the tree size, the set of paths for which one can obtain rewards is sparse, particularly when the likelihood is obtained through expensive evaluations, such as by querying a large language model. We address this challenge by deriving an probabilistic search heuristic based on regularity assumptions for the likelihood. Unlike existing tree search methods, the proposed method can perform backtracking and trade-off exploration with exploitation, and yet does not require expensive roll-outs, or sophisticated Bayesian inference. Through extensive on-model and off-model experiments on timely, large-scale practical applications, we demonstrate that our method identifies paths with high likelihood while requiring fewer costly evaluations.