A fast neural hybrid Newton solver adapted to implicit methods for nonlinear dynamics

作者: Tianyu Jin, Georg Maierhofer, Katharina Schratz, Yang Xiang

分类: math.NA, cs.LG

发布日期: 2024-07-04 (更新: 2025-02-13)

💡 一句话要点

提出一种快速神经混合牛顿求解器,加速非线性动力学隐式方法

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting)

关键词: 深度学习 牛顿法 非线性动力学 隐式方法 无监督学习

📋 核心要点

- 隐式时间步进格式在求解刚性非线性时间演化方程时具有更好的稳定性和结构保持特性,但代价是需要在每个时间步求解非线性方程。

- 论文提出一种基于深度学习的混合牛顿法,通过离线无监督学习为牛顿迭代提供高效的初始化,从而加速非线性方程的求解。

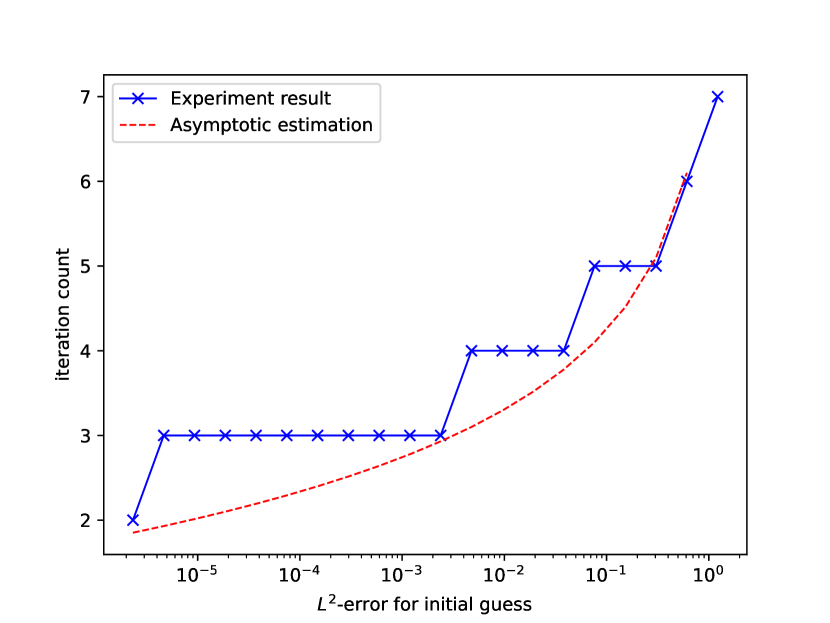

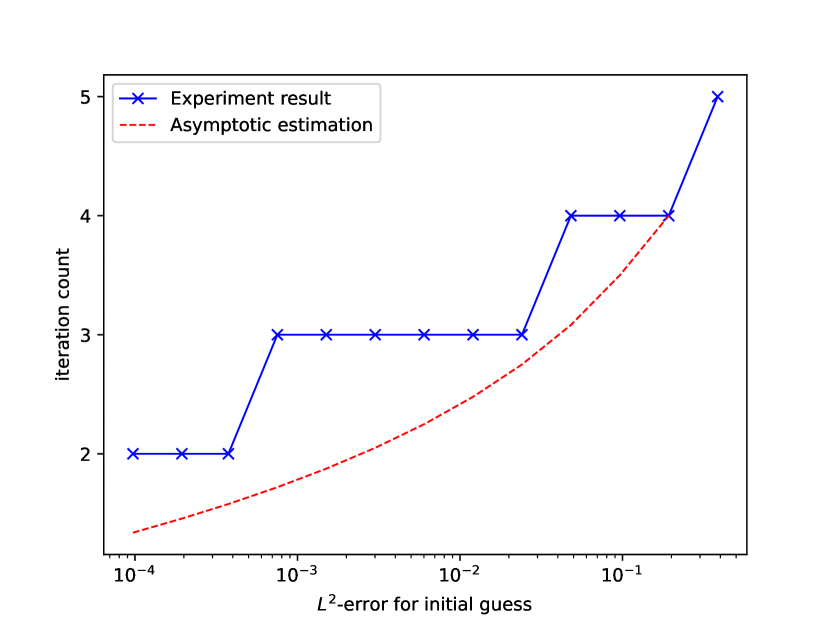

- 数值实验结果表明,该神经混合求解器能够有效加速牛顿法的收敛,在一维和二维问题中均表现出良好的性能。

📝 摘要(中文)

本文提出了一种基于深度学习的混合牛顿法,用于加速求解刚性非线性时间演化方程的非线性时间步长系统。该方法针对性地设计了一种学习策略,能够在离线阶段进行鲁棒的无监督学习,并为牛顿迭代提供高效的初始化,从而持续加速牛顿法的收敛。论文提供了通过改进初始化实现的牛顿法改进率的可量化指标,并分析了无监督学习策略的泛化误差上界。理论结果通过大量的数值实验得到支持,证明了所提出的神经混合求解器在一维和二维情况下的效率。

🔬 方法详解

问题定义:论文旨在解决刚性非线性时间演化方程在使用隐式方法进行数值求解时,每个时间步都需要求解高维非线性方程组的问题。传统的牛顿迭代法虽然可以求解,但计算成本高昂,尤其是在高维问题中,收敛速度慢,对初值敏感。

核心思路:论文的核心思路是利用深度学习技术,通过离线无监督学习,训练一个能够为牛顿迭代提供良好初始值的神经网络。这样,牛顿迭代就可以从一个更接近真实解的点开始,从而减少迭代次数,加速收敛。这种混合方法结合了神经网络的快速预测能力和牛顿迭代的精确求解能力。

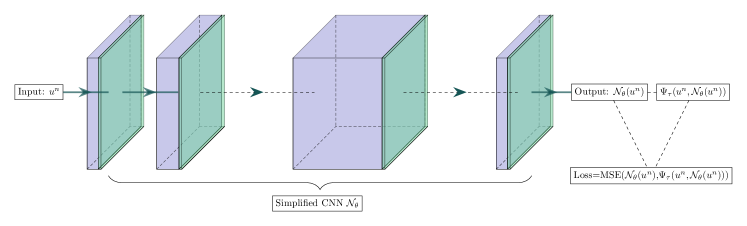

技术框架:整体框架包含两个主要阶段:离线训练阶段和在线求解阶段。在离线训练阶段,利用大量的历史数据,通过无监督学习训练一个神经网络,使其能够预测非线性方程组的近似解。在在线求解阶段,首先使用训练好的神经网络生成牛顿迭代的初始值,然后使用牛顿迭代法进行精确求解。

关键创新:论文的关键创新在于提出了一种针对性的学习策略,该策略能够进行鲁棒的无监督学习,并为牛顿迭代提供高效的初始化。此外,论文还提供了改进初始化后牛顿法改进率的可量化指标,并分析了无监督学习策略的泛化误差上界。

关键设计:论文采用无监督学习方法,具体使用的网络结构和损失函数未知。关键在于如何设计无监督学习的目标,使其能够有效地学习到非线性方程组解的近似分布。此外,如何选择合适的神经网络结构,以及如何平衡神经网络的预测精度和计算成本,也是重要的设计考虑。

🖼️ 关键图片

📊 实验亮点

论文通过数值实验验证了所提出的神经混合求解器的效率。实验结果表明,该方法能够有效加速牛顿法的收敛,在一维和二维问题中均表现出良好的性能。具体的性能数据和对比基线未知,但论文强调了该方法在加速求解非线性方程方面的潜力。

🎯 应用场景

该研究成果可应用于各种涉及刚性非线性时间演化方程的科学和工程领域,例如计算流体力学、结构力学、化学反应动力学等。通过加速非线性方程的求解,可以显著提高仿真效率,从而加速新材料的研发、优化工程设计等。

📄 摘要(原文)

The use of implicit time-stepping schemes for the numerical approximation of solutions to stiff nonlinear time-evolution equations brings well-known advantages including, typically, better stability behaviour and corresponding support of larger time steps, and better structure preservation properties. However, this comes at the price of having to solve a nonlinear equation at every time step of the numerical scheme. In this work, we propose a novel deep learning based hybrid Newton's method to accelerate this solution of the nonlinear time step system for stiff time-evolution nonlinear equations. We propose a targeted learning strategy which facilitates robust unsupervised learning in an offline phase and provides a highly efficient initialisation for the Newton iteration leading to consistent acceleration of Newton's method. A quantifiable rate of improvement in Newton's method achieved by improved initialisation is provided and we analyse the upper bound of the generalisation error of our unsupervised learning strategy. These theoretical results are supported by extensive numerical results, demonstrating the efficiency of our proposed neural hybrid solver both in one- and two-dimensional cases.