A Bayesian Solution To The Imitation Gap

作者: Risto Vuorio, Mattie Fellows, Cong Lu, Clémence Grislain, Shimon Whiteson

分类: cs.LG

发布日期: 2024-06-29

💡 一句话要点

提出贝叶斯模仿差距解决方案(BIG),解决专家与智能体观测差异下的模仿学习问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 模仿学习 贝叶斯逆强化学习 信息收集 模仿差距 部分观测马尔可夫决策过程

📋 核心要点

- 传统模仿学习在专家与智能体观测能力存在差异时,会因“模仿差距”而失效,专家策略对智能体不再是最优。

- BIG方法利用贝叶斯逆强化学习,从专家演示中推断奖励后验分布,并结合探索成本先验,鼓励智能体探索。

- 实验证明,BIG在存在模仿差距时,允许智能体进行探索,并在无差距时,依然能有效利用专家演示学习最优策略。

📝 摘要(中文)

在许多现实环境中,智能体必须学会在没有明确奖励信号但有专家演示的情况下行动。模仿学习(IL)是从此类演示中学习策略的常用框架。然而,在某些情况下,专家和智能体之间观测能力的差异会导致模仿差距,即专家的策略对智能体而言并非最优,而简单地应用IL可能会导致灾难性失败。特别是,如果专家观察到马尔可夫状态而智能体没有,那么专家将不会演示智能体需要但专家不需要的信息收集行为。本文提出了一种贝叶斯模仿差距解决方案(BIG),首先使用专家演示以及指定未演示的探索行为成本的先验,通过贝叶斯逆强化学习(IRL)推断奖励的后验分布。然后,BIG使用奖励后验来学习贝叶斯最优策略。实验表明,与IL不同,BIG允许智能体在遇到模仿差距时在测试时进行探索,同时在不存在这种差距时仍然学习使用专家演示来优化行为。

🔬 方法详解

问题定义:论文旨在解决模仿学习中,由于专家和智能体观测能力不同而产生的“模仿差距”问题。当专家可以观察到完整的马尔可夫状态,而智能体只能观察到部分状态时,专家演示的策略可能对智能体而言并非最优。传统的模仿学习方法在这种情况下会失效,因为智能体无法学习到专家未演示的信息收集行为。

核心思路:论文的核心思路是利用贝叶斯逆强化学习(IRL)从专家演示中推断奖励函数,并引入一个先验来惩罚未在演示中出现的探索行为。通过这种方式,智能体可以在学习专家策略的同时,也学会主动探索以弥补观测上的不足。最终学习到的策略是贝叶斯最优的,即在奖励后验分布下期望回报最大。

技术框架:BIG方法主要包含两个阶段:1) 奖励函数推断阶段:使用专家演示数据和一个探索成本先验,通过贝叶斯逆强化学习(IRL)推断奖励函数的后验分布。这个后验分布反映了对不同奖励函数的置信度。2) 策略学习阶段:利用推断出的奖励函数后验分布,学习一个贝叶斯最优策略。该策略旨在最大化在奖励后验分布下的期望回报,从而平衡模仿专家行为和自主探索。

关键创新:BIG方法的关键创新在于将贝叶斯方法引入模仿学习,并显式地考虑了探索成本。传统的模仿学习方法通常假设专家演示是最优的,而BIG方法则允许智能体在学习过程中进行探索,以适应观测上的差异。通过奖励函数后验分布,BIG方法能够更好地捕捉环境的不确定性,并学习到更鲁棒的策略。

关键设计:BIG方法中的关键设计包括:1) 探索成本先验:该先验用于惩罚未在专家演示中出现的行为,从而引导智能体在探索时更加谨慎。2) 奖励函数后验分布:该后验分布反映了对不同奖励函数的置信度,智能体需要根据该分布来学习策略。3) 贝叶斯最优策略:该策略旨在最大化在奖励后验分布下的期望回报,从而平衡模仿专家行为和自主探索。

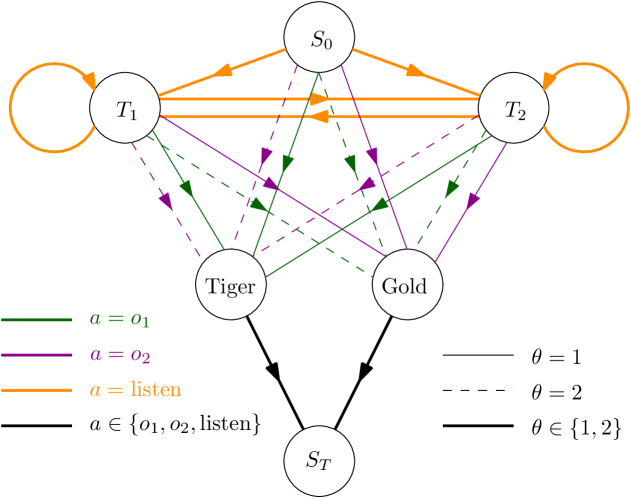

🖼️ 关键图片

📊 实验亮点

实验结果表明,在存在模仿差距的环境中,BIG方法明显优于传统的模仿学习方法。BIG方法能够学习到信息收集行为,从而更好地适应环境。在没有模仿差距的环境中,BIG方法也能与传统模仿学习方法相媲美,证明了其通用性和有效性。

🎯 应用场景

该研究成果可应用于机器人导航、自动驾驶等领域,尤其是在智能体无法获得完全观测信息的复杂环境中。例如,在搜救任务中,救援机器人可能无法像人类专家一样清晰地观察到所有环境细节,BIG方法可以帮助机器人学习人类专家的搜救策略,并在必要时进行自主探索,提高搜救效率。

📄 摘要(原文)

In many real-world settings, an agent must learn to act in environments where no reward signal can be specified, but a set of expert demonstrations is available. Imitation learning (IL) is a popular framework for learning policies from such demonstrations. However, in some cases, differences in observability between the expert and the agent can give rise to an imitation gap such that the expert's policy is not optimal for the agent and a naive application of IL can fail catastrophically. In particular, if the expert observes the Markov state and the agent does not, then the expert will not demonstrate the information-gathering behavior needed by the agent but not the expert. In this paper, we propose a Bayesian solution to the Imitation Gap (BIG), first using the expert demonstrations, together with a prior specifying the cost of exploratory behavior that is not demonstrated, to infer a posterior over rewards with Bayesian inverse reinforcement learning (IRL). BIG then uses the reward posterior to learn a Bayes-optimal policy. Our experiments show that BIG, unlike IL, allows the agent to explore at test time when presented with an imitation gap, whilst still learning to behave optimally using expert demonstrations when no such gap exists.