A Survey on Data Quality Dimensions and Tools for Machine Learning

作者: Yuhan Zhou, Fengjiao Tu, Kewei Sha, Junhua Ding, Haihua Chen

分类: cs.LG, cs.AI

发布日期: 2024-06-28

备注: This paper has been accepted by The 6th IEEE International Conference on Artificial Intelligence Testing (IEEE AITest 2024) as an invited paper

🔗 代码/项目: GITHUB

💡 一句话要点

综述机器学习数据质量评估与改进工具,并展望LLM的应用前景

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 数据质量 机器学习 数据评估 数据清洗 大型语言模型 生成式AI 数据治理 开源工具

📋 核心要点

- 传统的数据质量评估方法在面对大规模、复杂的数据集时面临挑战,无法有效保证机器学习模型的性能。

- 本综述旨在全面评估现有数据质量评估与改进工具,并为未来开源工具的开发提供指导。

- 论文探讨了大型语言模型和生成式AI在数据质量评估与改进中的潜在应用,为未来的研究方向提供了思路。

📝 摘要(中文)

机器学习(ML)技术已广泛应用于社会各方面,数据质量(DQ)对于ML模型的性能、公平性、鲁棒性、安全性和可扩展性至关重要。随着以数据为中心的人工智能中数据量增大和复杂性提高,传统方法(如探索性数据分析(EDA)和交叉验证(CV))面临挑战,因此掌握DQ工具至关重要。本综述回顾了过去5年中的17种DQ评估和改进工具,介绍了这些工具中嵌入的DQ维度、指标和主要功能,比较了它们的优缺点,并为开发用于ML的开源DQ工具提出了路线图。基于对挑战和新兴趋势的讨论,进一步强调了大型语言模型(LLM)和生成式AI在ML的DQ评估和改进中的潜在应用。我们相信这份全面的综述可以加深对ML中DQ的理解,并推动以数据为中心的人工智能的进步。本综述中调查的文献完整列表可在GitHub上找到:https://github.com/haihua0913/awesome-dq4ml。

🔬 方法详解

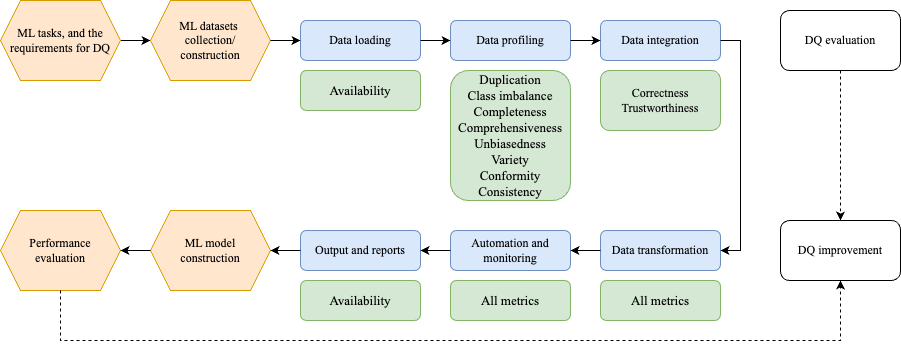

问题定义:论文旨在解决机器学习模型训练过程中,由于数据质量问题(如不完整、不一致、不准确等)导致的模型性能下降、公平性受损、鲁棒性不足等问题。现有方法,如EDA和CV,在大规模复杂数据集上效率低下,无法有效识别和解决数据质量问题。

核心思路:论文的核心思路是对现有数据质量评估和改进工具进行系统性的梳理和分析,总结其在不同数据质量维度上的表现,并探讨新兴技术(如LLM和生成式AI)在数据质量管理中的应用潜力,从而为开发更有效的数据质量工具提供指导。

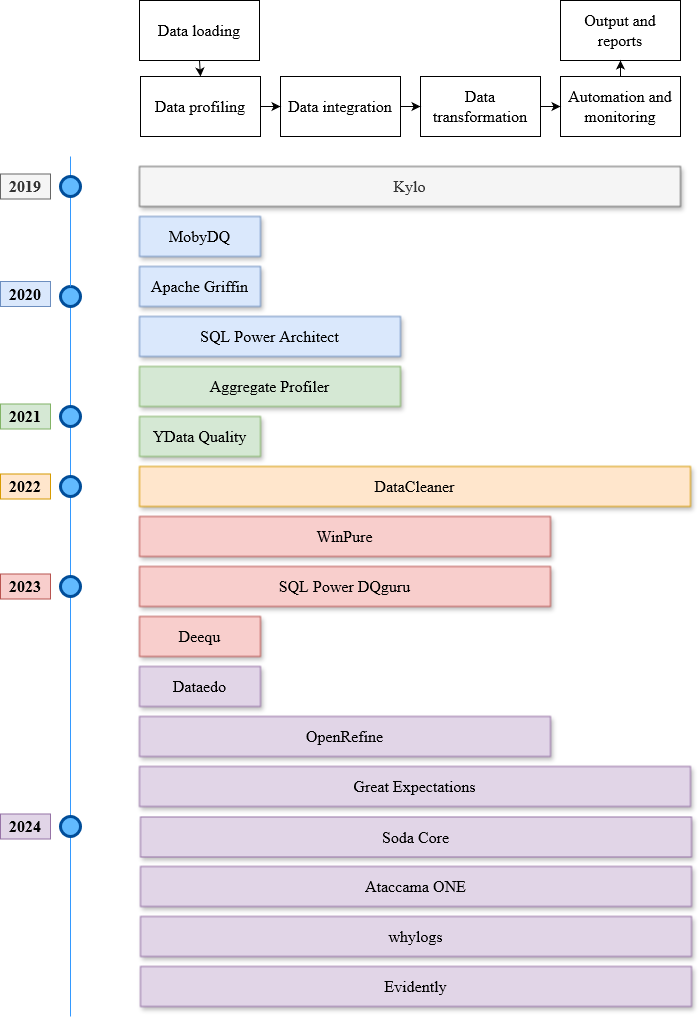

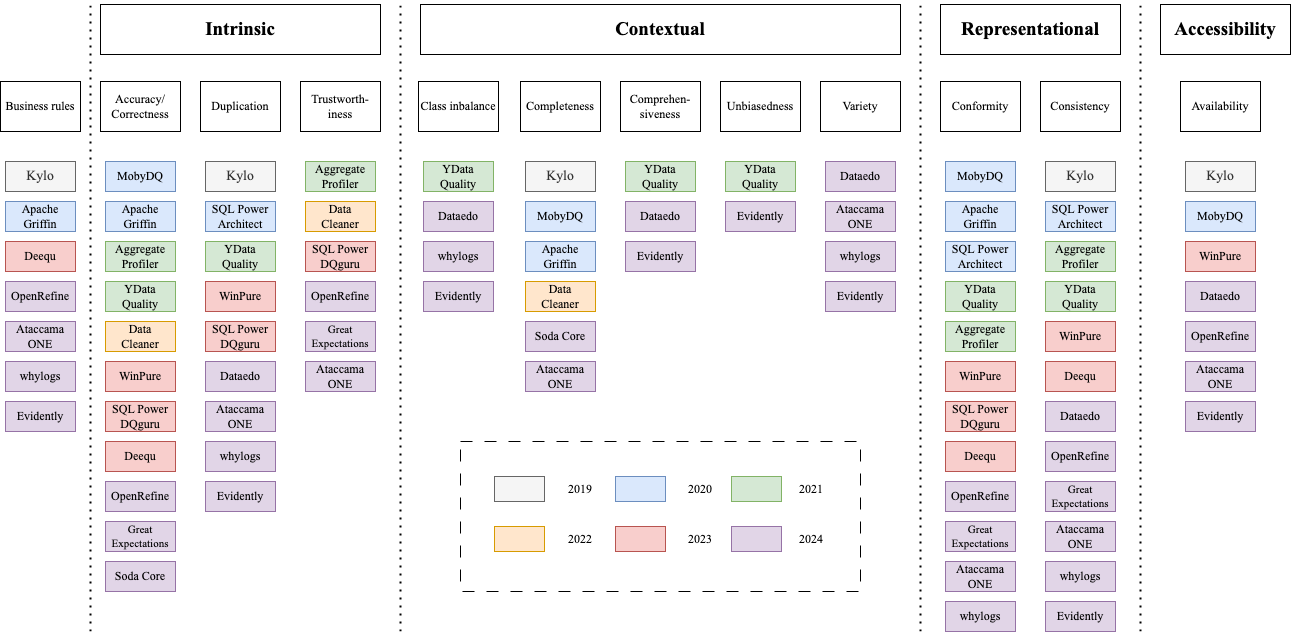

技术框架:论文首先定义了数据质量的各个维度,然后对17种数据质量评估和改进工具进行了详细的介绍,包括它们所采用的指标、主要功能以及优缺点。接着,论文提出了一个开发开源数据质量工具的路线图,并讨论了当前面临的挑战和未来的发展趋势。最后,论文探讨了LLM和生成式AI在数据质量评估和改进中的潜在应用。

关键创新:论文的关键创新在于对现有数据质量工具进行了全面的对比分析,并提出了一个面向机器学习的数据质量工具开发路线图。此外,论文还前瞻性地探讨了LLM和生成式AI在数据质量管理中的应用,为未来的研究方向提供了新的思路。

关键设计:论文的关键设计在于对数据质量维度的划分和对现有工具的评估指标的选择。论文选取了具有代表性的17种数据质量评估和改进工具,并从多个维度对其进行了比较分析,从而为读者提供了一个全面的视角。

🖼️ 关键图片

📊 实验亮点

该综述对17种数据质量评估和改进工具进行了详细的比较分析,总结了它们的优缺点,并提出了一个开发开源数据质量工具的路线图。此外,论文还探讨了LLM和生成式AI在数据质量管理中的应用,为未来的研究方向提供了新的思路。

🎯 应用场景

该研究成果可应用于各种机器学习场景,尤其是在数据质量对模型性能至关重要的领域,如金融风控、医疗诊断、自动驾驶等。通过使用文中提到的工具和方法,可以有效提升数据质量,从而提高模型的准确性、鲁棒性和公平性,最终提升业务价值。

📄 摘要(原文)

Machine learning (ML) technologies have become substantial in practically all aspects of our society, and data quality (DQ) is critical for the performance, fairness, robustness, safety, and scalability of ML models. With the large and complex data in data-centric AI, traditional methods like exploratory data analysis (EDA) and cross-validation (CV) face challenges, highlighting the importance of mastering DQ tools. In this survey, we review 17 DQ evaluation and improvement tools in the last 5 years. By introducing the DQ dimensions, metrics, and main functions embedded in these tools, we compare their strengths and limitations and propose a roadmap for developing open-source DQ tools for ML. Based on the discussions on the challenges and emerging trends, we further highlight the potential applications of large language models (LLMs) and generative AI in DQ evaluation and improvement for ML. We believe this comprehensive survey can enhance understanding of DQ in ML and could drive progress in data-centric AI. A complete list of the literature investigated in this survey is available on GitHub at: https://github.com/haihua0913/awesome-dq4ml.