Mental Modeling of Reinforcement Learning Agents by Language Models

作者: Wenhao Lu, Xufeng Zhao, Josua Spisak, Jae Hee Lee, Stefan Wermter

分类: cs.LG, cs.AI, cs.CL, cs.RO

发布日期: 2024-06-26

备注: https://lukaswill.github.io/

💡 一句话要点

利用语言模型对强化学习智能体进行心理建模,探索其行为理解能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 强化学习 语言模型 心理建模 可解释性 智能体行为理解

📋 核心要点

- 现有方法难以有效理解强化学习智能体的行为模式,阻碍了可解释强化学习的发展。

- 论文探索利用大型语言模型(LLMs)构建智能体的心理模型,通过分析交互历史理解其行为。

- 实验结果表明,当前LLMs在没有额外创新情况下,尚不能完全胜任智能体心理建模任务。

📝 摘要(中文)

本文首次实证研究了大型语言模型(LLMs)通过推理智能体的行为及其对状态的影响,从智能体交互历史中构建智能体心理模型的能力。该研究旨在揭示利用LLMs阐明强化学习智能体行为的潜力,从而解决可解释强化学习(XRL)中的一个关键挑战。为此,我们提出了具体的评估指标,并在不同复杂度的强化学习任务数据集上进行了测试,报告了智能体心理模型建立的发现。结果表明,如果没有进一步的创新,LLMs目前还不能仅通过推理来完全进行智能体心理建模。这项工作为现代LLMs的能力和局限性提供了新的见解。

🔬 方法详解

问题定义:论文旨在解决如何利用大型语言模型理解强化学习智能体的行为模式,即构建智能体的心理模型。现有方法缺乏有效手段从智能体的交互历史中推断其行为逻辑,导致可解释性差。

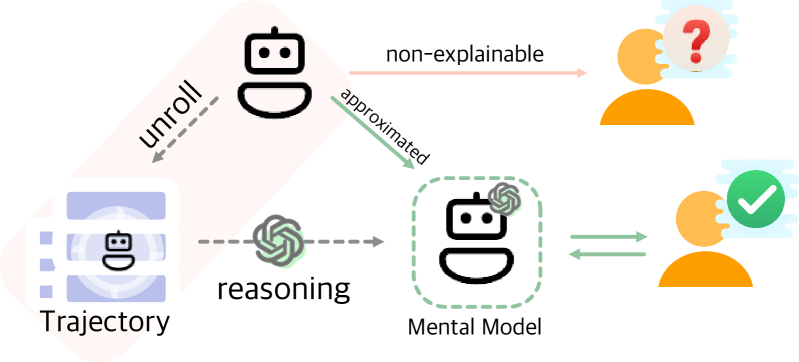

核心思路:论文的核心思路是利用大型语言模型(LLMs)强大的语言理解和推理能力,将智能体的交互历史转化为自然语言描述,然后让LLMs基于这些描述来推断智能体的目标、策略和行为原因,从而构建智能体的心理模型。这样设计的目的是希望借助LLMs已有的世界知识和推理能力,实现对智能体行为的更深层次理解。

技术框架:整体框架包括数据预处理、LLM推理和评估三个主要阶段。首先,将强化学习智能体的交互历史(状态、动作、奖励)转化为自然语言描述。然后,将这些描述输入到LLM中,让LLM进行推理,预测智能体的目标、策略和行为原因。最后,使用特定的评估指标来评估LLM构建的智能体心理模型的准确性和完整性。

关键创新:论文的关键创新在于首次尝试将大型语言模型应用于强化学习智能体的心理建模,并提出了相应的评估指标。与传统的基于规则或模型的解释方法不同,该方法利用LLMs的通用知识和推理能力,有望实现对智能体行为的更灵活和更深入的理解。

关键设计:论文设计了特定的提示工程(prompt engineering)方法,以引导LLM进行有效的推理。例如,使用特定的模板来描述智能体的交互历史,并设计问题来引导LLM预测智能体的目标和策略。此外,论文还提出了针对智能体心理建模的评估指标,例如,衡量LLM预测的智能体目标与实际目标之间的匹配程度。

🖼️ 关键图片

📊 实验亮点

实验结果表明,当前的大型语言模型在没有进一步创新情况下,尚不能完全胜任智能体心理建模任务。尽管LLMs能够理解部分智能体的行为,但在复杂环境下,其推理能力仍然有限。该研究揭示了LLMs在智能体行为理解方面的局限性,为未来的研究方向提供了指导。

🎯 应用场景

该研究成果可应用于可解释强化学习(XRL)领域,帮助人们更好地理解和信任智能体的决策。例如,在自动驾驶、医疗诊断等高风险领域,理解智能体的行为至关重要。此外,该研究还可以用于调试和优化强化学习算法,提高智能体的性能和鲁棒性。未来,该技术有望扩展到更广泛的人工智能系统,促进人机协作。

📄 摘要(原文)

Can emergent language models faithfully model the intelligence of decision-making agents? Though modern language models exhibit already some reasoning ability, and theoretically can potentially express any probable distribution over tokens, it remains underexplored how the world knowledge these pretrained models have memorized can be utilized to comprehend an agent's behaviour in the physical world. This study empirically examines, for the first time, how well large language models (LLMs) can build a mental model of agents, termed agent mental modelling, by reasoning about an agent's behaviour and its effect on states from agent interaction history. This research may unveil the potential of leveraging LLMs for elucidating RL agent behaviour, addressing a key challenge in eXplainable reinforcement learning (XRL). To this end, we propose specific evaluation metrics and test them on selected RL task datasets of varying complexity, reporting findings on agent mental model establishment. Our results disclose that LLMs are not yet capable of fully mental modelling agents through inference alone without further innovations. This work thus provides new insights into the capabilities and limitations of modern LLMs.