KalMamba: Towards Efficient Probabilistic State Space Models for RL under Uncertainty

作者: Philipp Becker, Niklas Freymuth, Gerhard Neumann

分类: cs.LG, stat.ML

发布日期: 2024-06-21

💡 一句话要点

KalMamba:面向不确定性强化学习的高效概率状态空间模型

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 状态空间模型 概率模型 卡尔曼滤波 Mamba 序列建模 不确定性

📋 核心要点

- 现有概率状态空间模型在强化学习中至关重要,但计算效率不如确定性模型,限制了其在高维数据中的应用。

- KalMamba结合概率SSM的优势和Mamba的可扩展性,在潜在空间中学习线性高斯SSM的动态参数,实现高效推断。

- 实验表明,KalMamba在强化学习任务中与现有SSM方法相比,在计算效率方面有显著提升,尤其是在长序列交互中。

📝 摘要(中文)

概率状态空间模型(SSM)对于从高维、部分信息中进行强化学习(RL)至关重要,因为它们为控制提供了简洁的表示。然而,它们缺乏像S4或Mamba等确定性模型的计算效率。我们提出了KalMamba,一种高效的架构,用于学习RL的表示,它结合了概率SSM的优势和确定性SSM的可扩展性。KalMamba利用Mamba学习潜在空间中线性高斯SSM的动态参数。该潜在空间中的推断相当于标准的卡尔曼滤波和平滑。我们使用类似于Mamba的并行关联扫描来实现这些操作,以获得一个有原则的、高效的、可扩展的概率SSM。实验表明,KalMamba在RL中与最先进的SSM方法竞争,同时显著提高了计算效率,尤其是在较长的交互序列上。

🔬 方法详解

问题定义:论文旨在解决强化学习中概率状态空间模型(SSM)计算效率低下的问题。现有的概率SSM虽然能提供简洁的控制表示,但在处理高维、部分信息时,其计算复杂度限制了其应用。确定性SSM,如S4和Mamba,虽然计算效率高,但缺乏概率SSM处理不确定性的能力。

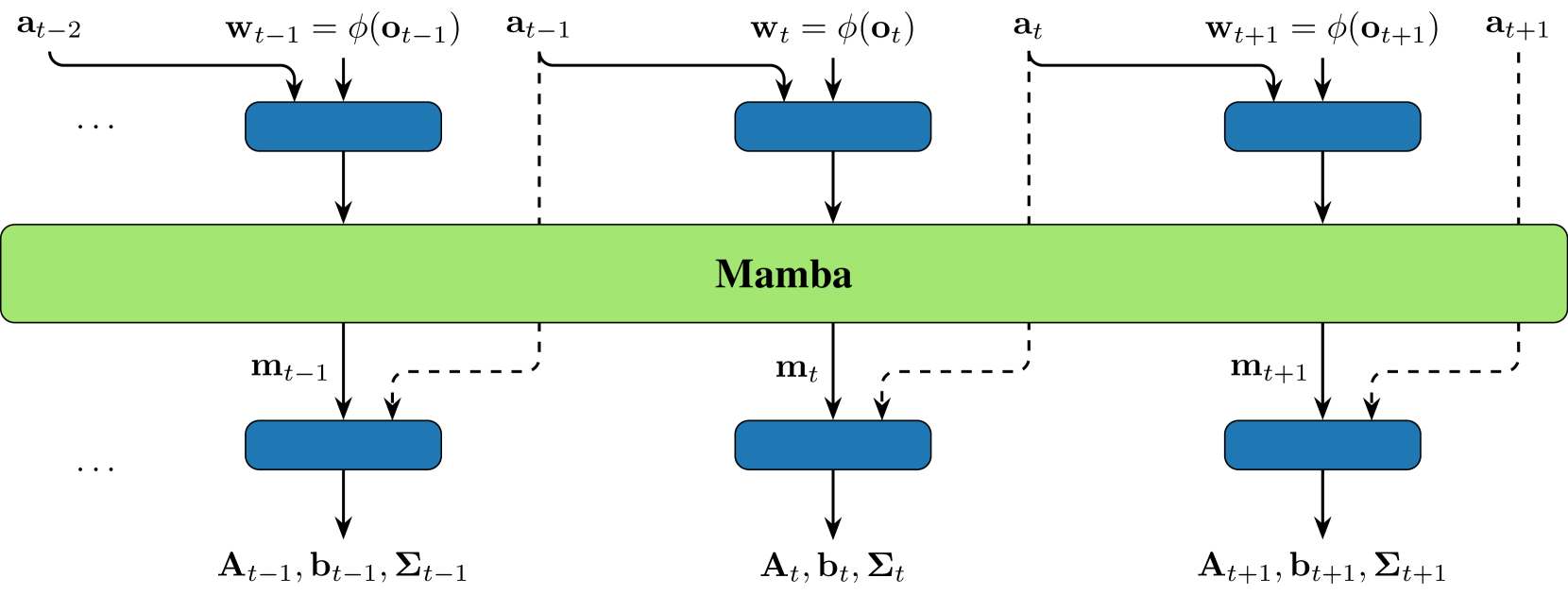

核心思路:KalMamba的核心思路是将概率SSM与确定性SSM的优势结合起来。具体来说,它利用Mamba模型学习潜在空间中线性高斯SSM的动态参数。这样,既能利用Mamba的高效计算能力,又能保持概率SSM处理不确定性的能力。通过在潜在空间进行卡尔曼滤波和平滑,实现高效的概率推断。

技术框架:KalMamba的整体框架包括以下几个主要模块:1) Mamba模型:用于学习潜在空间中线性高斯SSM的动态参数。2) 线性高斯SSM:在潜在空间中构建概率状态空间模型。3) 卡尔曼滤波和平滑:用于在潜在空间中进行高效的概率推断。4) 并行关联扫描:类似于Mamba,用于加速卡尔曼滤波和平滑的计算。整个流程是,首先使用Mamba学习动态参数,然后构建线性高斯SSM,最后使用卡尔曼滤波和平滑进行推断。

关键创新:KalMamba的关键创新在于将Mamba模型与概率SSM结合,利用Mamba学习概率SSM的动态参数,从而实现了高效的概率推断。与传统的概率SSM相比,KalMamba的计算效率更高,尤其是在处理长序列数据时。与确定性SSM相比,KalMamba能够处理不确定性,更适合于强化学习任务。

关键设计:KalMamba的关键设计包括:1) 使用Mamba模型学习动态参数,Mamba的结构和参数设置直接影响动态参数的学习效果。2) 在潜在空间中构建线性高斯SSM,需要选择合适的潜在空间维度和噪声模型。3) 使用并行关联扫描加速卡尔曼滤波和平滑,需要设计高效的并行算法。4) 损失函数的设计需要考虑动态参数学习和概率推断的准确性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,KalMamba在强化学习任务中与最先进的SSM方法相比,在计算效率方面有显著提升,尤其是在较长的交互序列上。具体来说,KalMamba在保持甚至略微提升性能的同时,显著降低了计算时间,使得在更长的序列上进行训练和推理成为可能。论文中给出了具体的性能数据和对比基线,证明了KalMamba的有效性。

🎯 应用场景

KalMamba在机器人控制、自动驾驶、金融建模等领域具有广泛的应用前景。它可以用于处理高维、部分可观测的环境,并能有效地处理环境中的不确定性。通过学习环境的动态模型,KalMamba可以帮助智能体做出更明智的决策,提高其在复杂环境中的表现。未来的研究可以探索KalMamba在更复杂的强化学习任务中的应用,并进一步提高其计算效率和泛化能力。

📄 摘要(原文)

Probabilistic State Space Models (SSMs) are essential for Reinforcement Learning (RL) from high-dimensional, partial information as they provide concise representations for control. Yet, they lack the computational efficiency of their recent deterministic counterparts such as S4 or Mamba. We propose KalMamba, an efficient architecture to learn representations for RL that combines the strengths of probabilistic SSMs with the scalability of deterministic SSMs. KalMamba leverages Mamba to learn the dynamics parameters of a linear Gaussian SSM in a latent space. Inference in this latent space amounts to standard Kalman filtering and smoothing. We realize these operations using parallel associative scanning, similar to Mamba, to obtain a principled, highly efficient, and scalable probabilistic SSM. Our experiments show that KalMamba competes with state-of-the-art SSM approaches in RL while significantly improving computational efficiency, especially on longer interaction sequences.