Demystifying Language Model Forgetting with Low-rank Example Associations

作者: Xisen Jin, Xiang Ren

分类: cs.LG, cs.CL, stat.ML

发布日期: 2024-06-20 (更新: 2025-12-07)

备注: NeurIPS 2025. Updated code and data URL

🔗 代码/项目: GITHUB

💡 一句话要点

利用低秩示例关联揭示并缓解语言模型微调中的遗忘现象

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语言模型 灾难性遗忘 低秩矩阵 矩阵补全 持续学习 知识保留 微调 遗忘预测

📋 核心要点

- 大型语言模型微调后易遗忘上游知识,现有方法缺乏对遗忘与新任务间依赖性的深入分析。

- 论文核心思想是发现遗忘模式与新任务之间存在低秩关联,并利用矩阵补全预测遗忘。

- 实验表明,该方法能有效预测遗忘,并通过加权回放显著减少微调过程中的知识遗忘。

📝 摘要(中文)

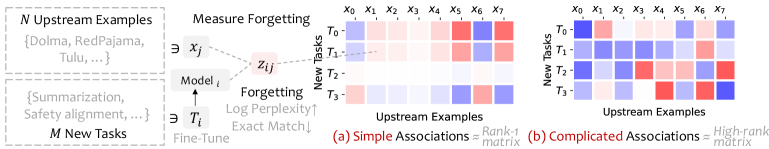

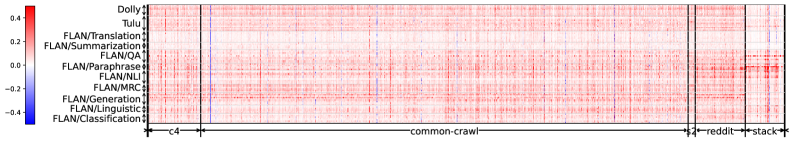

大型语言模型(LLMs)在微调后会遭受上游知识的遗忘。尽管已经有一些缓解遗忘的努力,但很少有研究调查被遗忘的上游示例与新学习任务之间的依赖关系。对此类依赖关系的深入了解能够实现高效且有针对性的遗忘缓解。在本文中,我们实证分析了在$N$个语言建模或指令调优的上游示例中发生的遗忘,这些遗忘发生在LLMs在$M$个新任务之一上进行微调之后,并将其可视化为$M imes N$矩阵。我们表明,这些矩阵通常可以用低秩矩阵很好地近似,这表明学习的任务和被遗忘的上游示例之间存在简单的关联。利用该分析,我们通过经验关联上的矩阵补全来预测LLMs在未见任务上进行微调时上游示例的遗忘。这使得能够快速识别大多数被遗忘的示例,而无需对整个上游数据进行昂贵的推理。尽管方法简单,但该方法优于先前使用LMs学习已学习任务和上游示例的语义关系的方法。我们通过展示在微调期间对预测的示例进行加权回放,从而显著减少遗忘,证明了我们分析的实际效用。代码、数据和统计信息已公开。

🔬 方法详解

问题定义:大型语言模型在微调过程中会遗忘预训练阶段学习到的知识,即“灾难性遗忘”。现有方法主要集中在缓解遗忘,但缺乏对遗忘现象内在机制的深入理解,特别是被遗忘的样本与新学习任务之间的关联性。这使得缓解策略缺乏针对性,效率较低。

核心思路:论文的核心思路是揭示被遗忘的上游示例与新学习的任务之间存在低秩关联。这意味着遗忘模式并非随机,而是可以通过少量潜在因素来解释。通过分析这种关联,可以预测哪些上游示例最容易被遗忘,从而有针对性地进行干预。

技术框架:该方法主要包含以下几个阶段:1) 遗忘矩阵构建:对LLM在每个新任务上微调后,评估其在上游数据集上的性能下降情况,构建一个M×N的遗忘矩阵,其中M是新任务的数量,N是上游示例的数量。矩阵中的每个元素表示对应示例在对应任务微调后的遗忘程度。2) 低秩近似:对遗忘矩阵进行低秩分解,例如使用奇异值分解(SVD),提取主要的潜在因素。3) 矩阵补全:利用已知的遗忘数据和低秩结构,通过矩阵补全技术预测LLM在未见任务上微调时,哪些上游示例会被遗忘。4) 遗忘缓解:在微调过程中,对预测容易被遗忘的示例进行加权回放,以增强LLM对这些知识的记忆。

关键创新:该方法最重要的创新点在于发现了遗忘现象的低秩结构,并将其应用于遗忘预测和缓解。与以往关注语义关系的方法不同,该方法直接建模遗忘模式,更加高效且易于实现。此外,该方法无需对整个上游数据集进行推理,大大降低了计算成本。

关键设计:关键设计包括:1) 遗忘程度的度量:如何准确评估每个示例的遗忘程度,例如使用困惑度或准确率的变化。2) 低秩分解的秩的选择:选择合适的秩以平衡模型的复杂度和预测精度。3) 矩阵补全算法的选择:选择合适的矩阵补全算法,例如基于核范数最小化的方法。4) 加权回放策略:如何确定回放示例的权重,例如根据预测的遗忘程度进行加权。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在遗忘预测方面优于基于语言模型学习语义关系的方法。通过对预测的易遗忘示例进行加权回放,能够显著减少微调过程中的知识遗忘。具体而言,该方法在多个数据集上实现了统计意义上的显著提升,证明了其有效性和实用性。

🎯 应用场景

该研究成果可应用于提升大型语言模型在持续学习场景下的性能,减少微调过程中的知识遗忘。例如,在医疗、金融等专业领域,可以利用该方法在模型更新时,有针对性地保留关键的领域知识,避免模型性能下降,保证服务的稳定性和可靠性。此外,该方法还可以用于评估不同微调策略对知识遗忘的影响,指导模型训练过程。

📄 摘要(原文)

Large language models (LLMs) suffer from forgetting of upstream knowledge when fine-tuned. Despite efforts on mitigating forgetting, few have investigated how forgotten upstream examples are dependent on newly learned tasks. Insights on such dependencies enable efficient and targeted mitigation of forgetting. In this paper, we empirically analyze forgetting that occurs in $N$ upstream examples of language modeling or instruction-tuning after fine-tuning LLMs on one of $M$ new tasks, visualized in $M\times N$ matrices. We show that the matrices are often well-approximated with low-rank matrices, indicating the dominance of simple associations between the learned tasks and forgotten upstream examples. Leveraging the analysis, we predict forgetting of upstream examples when fine-tuning LLMs on unseen tasks with matrix completion over the empirical associations. This enables fast identification of most forgotten examples without expensive inference on the entire upstream data. Despite simplicity, the approach outperforms prior approaches that learn semantic relationships of learned tasks and upstream examples with LMs. We demonstrate the practical utility of our analysis by showing statistically significantly reduced forgetting as we upweight predicted examples for replay during fine-tuning. Code, data, and statistics collected: https://github.com/AuCson/low-rank-forgetting