Can Low-Rank Knowledge Distillation in LLMs be Useful for Microelectronic Reasoning?

作者: Nirjhor Rouf, Fin Amin, Paul D. Franzon

分类: cs.LG

发布日期: 2024-06-19 (更新: 2024-06-27)

备注: 4 pages, 2 figures, 2 tables, The First IEEE International Workshop on LLM-Aided Design (LAD'24)

💡 一句话要点

提出LoRA-KD方案,探索LLM在微电子推理中的应用潜力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 知识蒸馏 低秩适配 微电子 电子设计自动化

📋 核心要点

- 现有EDA工具在处理复杂微电子问题时存在局限性,缺乏自然语言理解和推理能力。

- 提出一种基于低秩知识蒸馏(LoRA-KD)的LLM适配方案,旨在提升LLM在微电子领域的推理能力。

- 通过实验验证了Llama-2-7B模型在微电子问答和问题解决方面的潜力,并进行了定性和定量分析。

📝 摘要(中文)

本文针对大型语言模型(LLMs)在电子设计自动化(EDA)领域的应用可行性进行了实证研究。目标是评估当前语言模型(Llama-2-7B)作为微电子问答专家的能力,以及其在解决微电子相关问题中的推理和生成能力。Llama-2-7B通过多种适配方法进行了测试,包括引入一种新颖的低秩知识蒸馏(LoRA-KD)方案。实验结果包括定性和定量分析。

🔬 方法详解

问题定义:论文旨在探索大型语言模型(LLMs)在微电子领域,特别是电子设计自动化(EDA)中的应用潜力。现有EDA工具在处理需要复杂推理和领域知识的问题时存在局限性,缺乏对自然语言描述的电路设计需求的理解和生成能力。因此,如何利用LLM的强大语言理解和生成能力来辅助微电子设计是一个重要的研究问题。

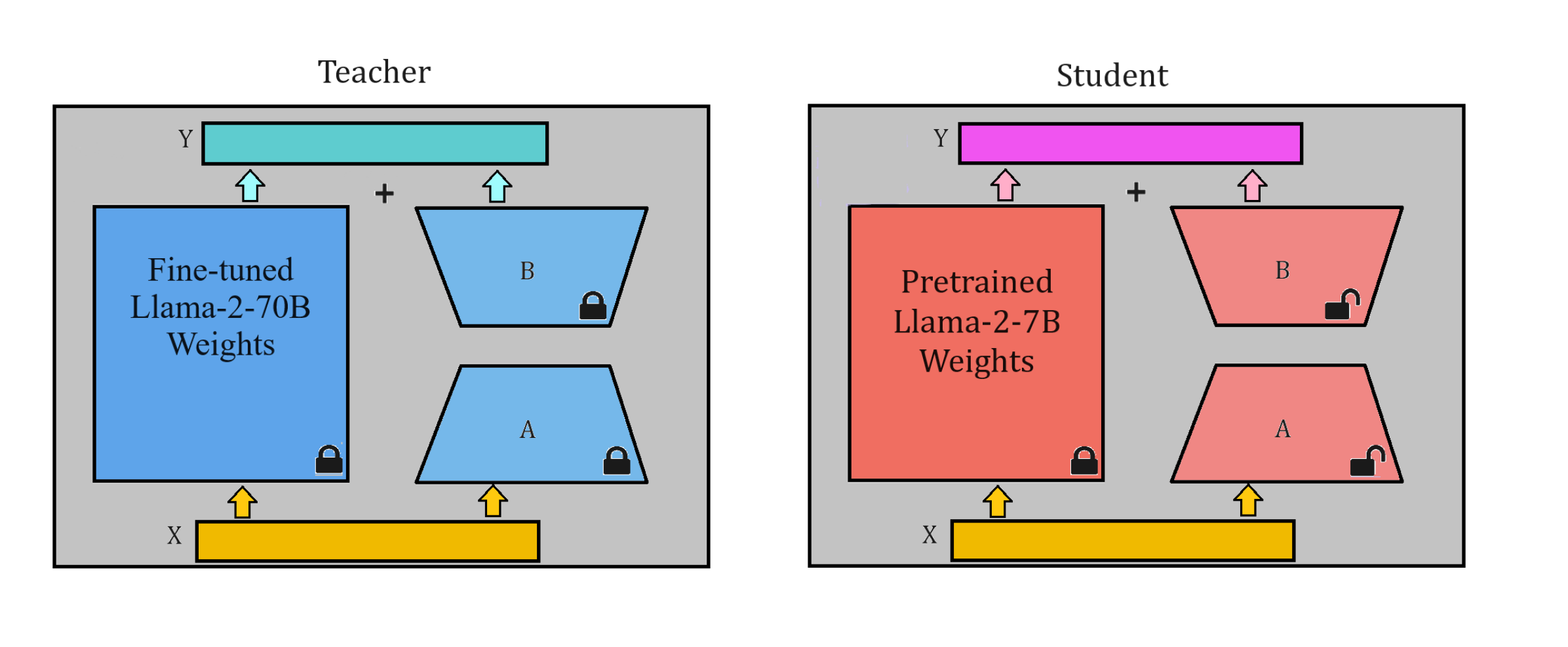

核心思路:论文的核心思路是利用知识蒸馏技术,将大型预训练语言模型(如Llama-2-7B)的知识迁移到微电子领域。通过低秩适配(LoRA)方法,在保持模型大部分参数不变的情况下,微调少量参数,从而降低训练成本并避免灾难性遗忘。结合知识蒸馏,让学生模型学习教师模型的输出,进一步提升模型在特定任务上的性能。

技术框架:整体框架包含以下几个阶段:1) 选择预训练的LLM(Llama-2-7B)作为基础模型。2) 构建微电子领域的问答数据集和问题解决数据集。3) 使用LoRA方法对LLM进行微调,使其适应微电子领域的知识。4) 引入知识蒸馏,使用原始LLM或微调后的LLM作为教师模型,训练学生模型。5) 对训练后的模型进行评估,包括定性和定量分析。

关键创新:论文的关键创新在于提出了一种新颖的低秩知识蒸馏(LoRA-KD)方案。该方案结合了LoRA的参数高效性和知识蒸馏的知识迁移能力,能够在有限的计算资源下,有效地将大型LLM的知识迁移到微电子领域。此外,论文还针对微电子领域的特点,设计了特定的数据集和评估指标。

关键设计:LoRA的具体实现方式是,在Transformer模型的自注意力模块中,引入低秩矩阵来近似权重矩阵的更新。知识蒸馏采用交叉熵损失函数,让学生模型的输出概率分布尽可能接近教师模型的输出概率分布。实验中,作者探索了不同的LoRA秩、学习率和蒸馏温度等参数,以找到最佳的训练配置。

🖼️ 关键图片

📊 实验亮点

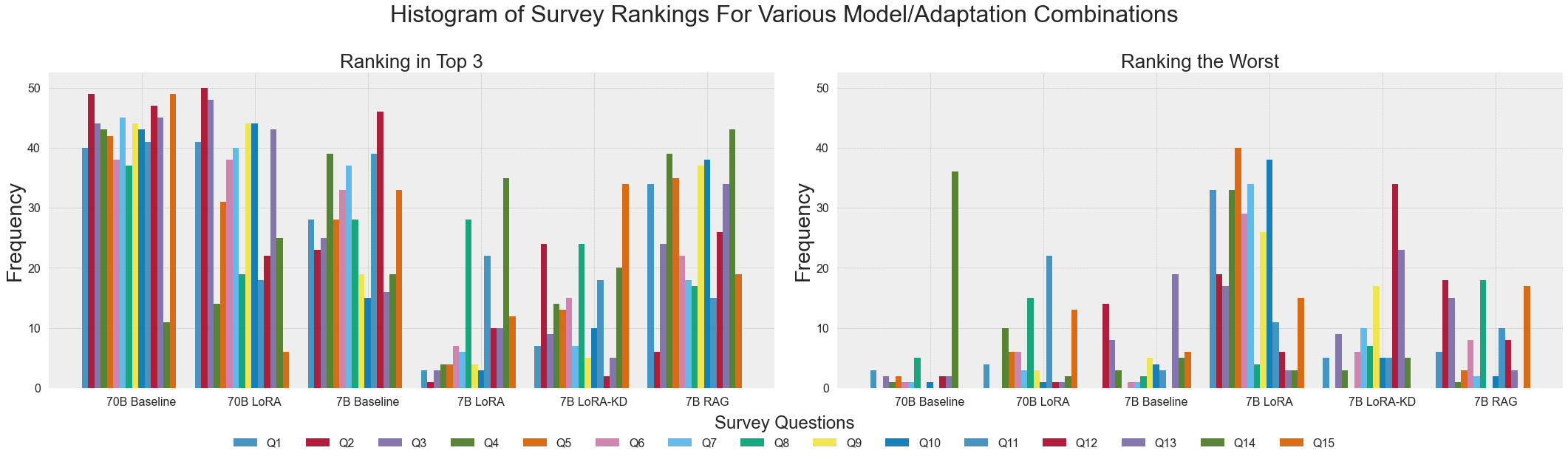

实验结果表明,通过LoRA-KD方案,Llama-2-7B模型在微电子问答和问题解决任务上取得了显著的性能提升。定性分析表明,模型能够理解复杂的微电子概念,并生成合理的答案和解决方案。定量分析表明,LoRA-KD方案优于传统的微调方法,并在某些任务上接近甚至超过了原始LLM的性能。

🎯 应用场景

该研究成果可应用于智能EDA工具的开发,例如自动问答系统、电路设计辅助工具和故障诊断系统。通过利用LLM的推理和生成能力,可以显著提高微电子设计的效率和质量,并降低设计成本。未来,该技术有望扩展到更广泛的硬件设计领域,例如芯片架构设计和系统级设计。

📄 摘要(原文)

In this work, we present empirical results regarding the feasibility of using offline large language models (LLMs) in the context of electronic design automation (EDA). The goal is to investigate and evaluate a contemporary language model's (Llama-2-7B) ability to function as a microelectronic Q & A expert as well as its reasoning, and generation capabilities in solving microelectronic-related problems. Llama-2-7B was tested across a variety of adaptation methods, including introducing a novel low-rank knowledge distillation (LoRA-KD) scheme. Our experiments produce both qualitative and quantitative results.