A Super-human Vision-based Reinforcement Learning Agent for Autonomous Racing in Gran Turismo

作者: Miguel Vasco, Takuma Seno, Kenta Kawamoto, Kaushik Subramanian, Peter R. Wurman, Peter Stone

分类: cs.LG, cs.CV, cs.RO

发布日期: 2024-06-18

备注: Accepted at the Reinforcement Learning Conference (RLC) 2024

💡 一句话要点

提出一种仅使用车载视觉信息的超人水平强化学习赛车智能体,在Gran Turismo中实现自主驾驶

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 自主赛车 计算机视觉 深度学习 车载传感器

📋 核心要点

- 现有自主赛车智能体依赖外部全局特征,限制了其在真实环境中的应用。

- 该论文提出一种仅使用车载摄像头和速度信息的强化学习智能体,实现自主赛车。

- 实验表明,该智能体在Gran Turismo 7中超越了人类车手,并验证了视觉输入的重要性。

📝 摘要(中文)

本文提出了一种超人水平的赛车智能体,它仅依赖于车载传感器输入,即以自我为中心的摄像头视图的像素和车载传感器可感知的量(如车辆速度)。该智能体在训练时利用全局特征,但在测试时仅使用局部输入特征,从而在计时赛中超越了最优秀的人类车手。该智能体在 Gran Turismo 7 上针对多个赛道和车辆进行了评估。详细的消融实验表明,该智能体强烈依赖视觉输入,使其成为第一个基于视觉的超人赛车智能体。

🔬 方法详解

问题定义:现有自主赛车系统通常依赖于全局信息,例如赛道地图或GPS定位,这在实际应用中受到限制。本文旨在解决仅使用车载传感器(摄像头和速度计)实现超人水平自主赛车的问题,挑战在于如何从有限的局部信息中学习到有效的驾驶策略。

核心思路:该论文的核心思路是利用强化学习训练一个智能体,使其能够直接从车载摄像头图像和速度信息中学习驾驶策略。通过在训练阶段利用全局信息进行辅助,智能体可以学习到更有效的特征表示,并在测试阶段仅依赖局部信息进行推理。

技术框架:整体框架是一个端到端的强化学习系统。智能体接收来自游戏环境的图像和速度信息作为输入,通过深度神经网络提取特征,然后输出控制指令(例如转向、加速、刹车)。智能体与环境交互,根据获得的奖励信号更新网络参数。训练过程包括探索和利用两个阶段,智能体不断尝试新的驾驶策略,并学习如何最大化累积奖励。

关键创新:该论文的关键创新在于成功地训练了一个仅依赖车载视觉信息的超人水平赛车智能体。与以往依赖全局信息的系统相比,该方法更具通用性和实用性。此外,通过在训练阶段利用全局信息,并在测试阶段仅使用局部信息,有效地提高了智能体的泛化能力。

关键设计:具体的网络结构和训练细节未知,但可以推测使用了卷积神经网络(CNN)来处理图像输入,并可能结合循环神经网络(RNN)来处理时间序列数据。损失函数可能包括奖励最大化和行为正则化等项。训练过程中可能使用了各种技巧,例如经验回放、目标网络和探索策略,以提高训练效率和稳定性。具体的参数设置未知。

🖼️ 关键图片

📊 实验亮点

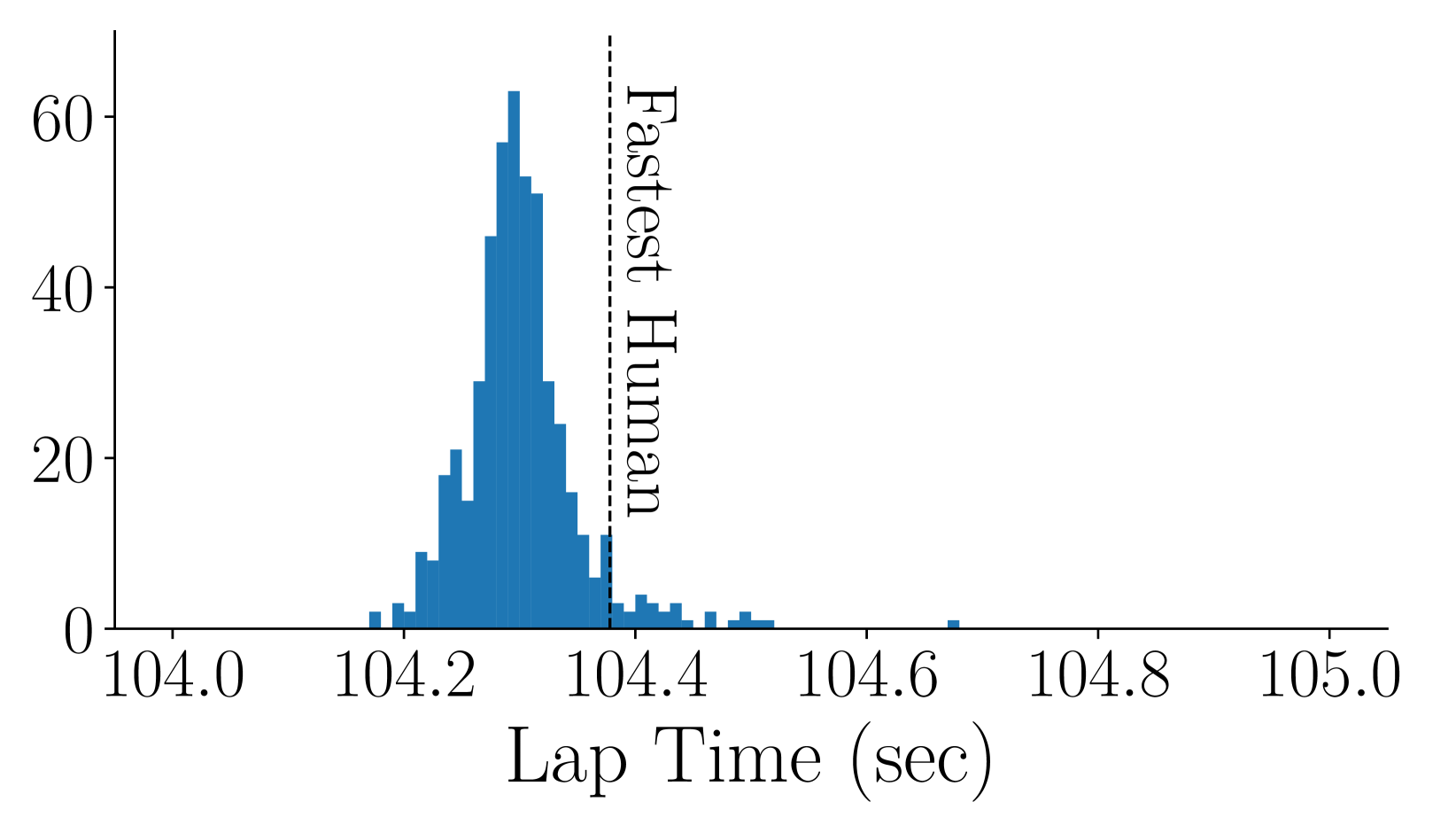

该论文最重要的实验结果是,所提出的智能体在 Gran Turismo 7 的计时赛中超越了最优秀的人类车手。消融实验表明,视觉输入对于智能体的性能至关重要,验证了该智能体是第一个基于视觉的超人赛车智能体。具体的性能提升数据未知,但实验结果表明该方法具有显著的优势。

🎯 应用场景

该研究成果可应用于真实的自动驾驶领域,尤其是在赛车运动和高级驾驶辅助系统(ADAS)中。通过模仿人类驾驶员的视觉感知和决策过程,可以提高自动驾驶系统的安全性和可靠性。此外,该方法还可以推广到其他需要从局部信息中进行决策的任务,例如机器人导航和无人机控制。

📄 摘要(原文)

Racing autonomous cars faster than the best human drivers has been a longstanding grand challenge for the fields of Artificial Intelligence and robotics. Recently, an end-to-end deep reinforcement learning agent met this challenge in a high-fidelity racing simulator, Gran Turismo. However, this agent relied on global features that require instrumentation external to the car. This paper introduces, to the best of our knowledge, the first super-human car racing agent whose sensor input is purely local to the car, namely pixels from an ego-centric camera view and quantities that can be sensed from on-board the car, such as the car's velocity. By leveraging global features only at training time, the learned agent is able to outperform the best human drivers in time trial (one car on the track at a time) races using only local input features. The resulting agent is evaluated in Gran Turismo 7 on multiple tracks and cars. Detailed ablation experiments demonstrate the agent's strong reliance on visual inputs, making it the first vision-based super-human car racing agent.