An Imitative Reinforcement Learning Framework for Pursuit-Lock-Launch Missions

作者: Siyuan Li, Rongchang Zuo, Bofei Liu, Yaoyu He, Peng Liu, Yingnan Zhao

分类: cs.LG, cs.RO

发布日期: 2024-06-17 (更新: 2025-10-10)

💡 一句话要点

提出一种模仿强化学习框架,用于无人机近距格斗的“追逐-锁定-发射”任务

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 模仿学习 强化学习 无人作战飞行器 近距格斗 自主决策 空中作战 策略学习

📋 核心要点

- 现有自主近距格斗策略学习面临探索能力弱、学习效率低以及模拟环境不真实等挑战。

- 提出一种模仿强化学习框架,结合专家数据和强化学习自主探索,提高学习效率和环境适应性。

- 实验结果表明,该框架在“追逐-锁定-发射”任务中表现出色,显著优于现有强化学习和模仿学习方法。

📝 摘要(中文)

本文提出了一种新颖的模仿强化学习框架,用于解决无人作战飞行器(UCAV)近距格斗(WVR)中的“追逐-锁定-发射”任务。该任务在空中战场上起着决定性作用。随着人工智能的发展,WVR交战正逐步向智能化和自主化模式发展。然而,自主WVR交战策略学习受到弱探索能力、低学习效率和不真实的模拟环境等挑战的阻碍。为了克服这些挑战,该框架高效地利用专家数据,同时实现自主探索。该框架不仅通过专家模仿提高了学习效率,而且通过强化学习的自主探索确保了对动态环境的适应性。实验结果表明,该框架擅长于多阶段任务,并且显著优于最先进的强化学习和模仿学习方法。凭借模仿专家和自主探索的能力,该框架可以快速学习复杂空中作战任务中的关键知识,达到高达100%的成功率,并表现出出色的鲁棒性。

🔬 方法详解

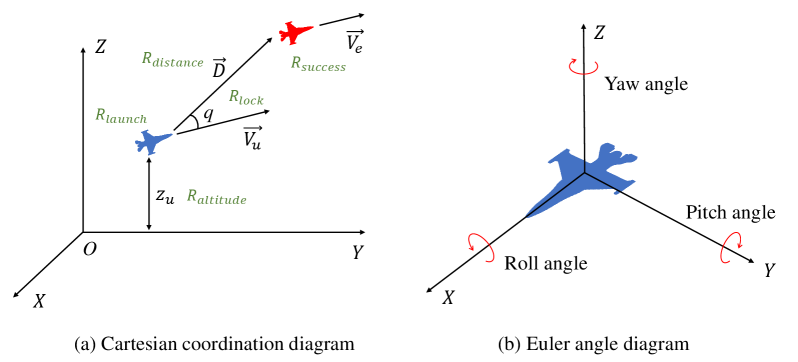

问题定义:论文旨在解决无人作战飞行器(UCAV)在近距格斗(WVR)中如何自主学习“追逐-锁定-发射”策略的问题。现有方法,如纯强化学习,存在探索效率低、训练时间长的问题;而纯模仿学习则泛化能力不足,难以适应复杂多变的空战环境。

核心思路:论文的核心思路是将模仿学习和强化学习相结合,利用专家数据引导初始策略,加速学习过程,并通过强化学习进行自主探索,提升策略的泛化能力和鲁棒性。这种结合既能利用专家经验,又能避免完全依赖专家数据带来的局限性。

技术框架:该框架包含两个主要阶段:模仿学习阶段和强化学习阶段。在模仿学习阶段,利用专家数据训练一个初始策略,使其能够初步完成“追逐-锁定-发射”任务。在强化学习阶段,使用该初始策略作为起点,通过与环境交互,利用强化学习算法(具体算法未知)进行策略优化,使其能够适应更复杂的环境和对抗策略。该框架基于Harfang3D沙盒环境进行仿真。

关键创新:该框架的关键创新在于将模仿学习和强化学习有机结合,克服了各自的缺点。模仿学习提供了快速学习的起点,而强化学习则保证了策略的适应性和鲁棒性。这种结合使得智能体能够更快地学习到有效的空战策略,并在复杂环境中表现出色。

关键设计:论文中未明确给出关键参数设置、损失函数、网络结构等技术细节。但是,可以推测,模仿学习阶段可能使用了行为克隆等方法,损失函数可能是专家行为和智能体行为之间的交叉熵损失。强化学习阶段可能使用了Actor-Critic或DQN等算法,并针对空战环境进行了定制化的奖励函数设计。具体的网络结构未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该模仿强化学习框架在无人机“追逐-锁定-发射”任务中取得了显著的性能提升,成功率高达100%,并且优于现有的强化学习和模仿学习方法。这表明该框架能够有效地学习复杂空战任务中的关键知识,并具有出色的鲁棒性。

🎯 应用场景

该研究成果可应用于无人作战飞行器的自主空战决策,提高其在复杂战场环境下的生存能力和作战效能。此外,该框架也可推广到其他复杂决策任务中,例如机器人导航、自动驾驶等领域,具有重要的实际应用价值和广阔的发展前景。

📄 摘要(原文)

Unmanned Combat Aerial Vehicle (UCAV) Within-Visual-Range (WVR) engagement, referring to a fight between two or more UCAVs at close quarters, plays a decisive role on the aerial battlefields. With the development of artificial intelligence, WVR engagement progressively advances towards intelligent and autonomous modes. However, autonomous WVR engagement policy learning is hindered by challenges such as weak exploration capabilities, low learning efficiency, and unrealistic simulated environments. To overcome these challenges, we propose a novel imitative reinforcement learning framework, which efficiently leverages expert data while enabling autonomous exploration. The proposed framework not only enhances learning efficiency through expert imitation, but also ensures adaptability to dynamic environments via autonomous exploration with reinforcement learning. Therefore, the proposed framework can learn a successful policy of `pursuit-lock-launch' for UCAVs. To support data-driven learning, we establish an environment based on the Harfang3D sandbox. The extensive experiment results indicate that the proposed framework excels in this multistage task, and significantly outperforms state-of-the-art reinforcement learning and imitation learning methods. Thanks to the ability of imitating experts and autonomous exploration, our framework can quickly learn the critical knowledge in complex aerial combat tasks, achieving up to a 100% success rate and demonstrating excellent robustness.