Towards Effective Evaluations and Comparisons for LLM Unlearning Methods

作者: Qizhou Wang, Bo Han, Puning Yang, Jianing Zhu, Tongliang Liu, Masashi Sugiyama

分类: cs.LG

发布日期: 2024-06-13 (更新: 2025-02-25)

💡 一句话要点

针对LLM不可学习的有效评估与对比框架,提升评估鲁棒性与实用性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 机器不可学习 评估指标 鲁棒性 性能校准 对抗性攻击 隐私保护

📋 核心要点

- 现有LLM不可学习评估指标易受攻击,无法真实反映模型知识擦除效果,需要更鲁棒的评估方法。

- 提出一种新的评估框架,通过设计鲁棒的评估指标和校准方法,解决评估指标脆弱和目标冲突问题。

- 通过实验验证了该评估框架的有效性,能够更准确地评估和比较不同的LLM不可学习方法。

📝 摘要(中文)

本文旨在改进大型语言模型(LLM)不可学习的评估方法。当前,消除LLM中不期望的数据记忆至关重要,因此机器不可学习的研究意义重大。虽然涌现出许多有前景的不可学习方法,但缺乏一个合适的评估框架来反映真实的不可学习效果。本文着重解决两个关键挑战:评估指标的鲁棒性和不同目标之间的权衡。研究发现,现有指标容易受到各种红队攻击的影响,可能无法反映LLM保留知识的真实程度,而倾向于反映表面的模型行为。为此,本文设计并评估了一系列候选指标,并选择了在各种攻击下最鲁棒的指标。此外,本文还提出了一种校准方法,可以在不可学习后恢复非目标数据的原始性能,从而能够专注于评估不可学习的强度。该评估框架显著提高了评估和比较各种LLM不可学习方法的有效性,并允许对现有工作进行基准测试,确定其合适的超参数,并探索增强其实际有效性的新技巧。

🔬 方法详解

问题定义:现有LLM不可学习的评估方法存在两个主要痛点。一是评估指标的鲁棒性不足,容易受到对抗性攻击的影响,导致评估结果失真。二是不可学习过程需要在消除不需要的知识和保留有用知识之间进行权衡,现有方法难以在两者之间达到帕累托最优,导致不同方法难以直接比较。

核心思路:本文的核心思路是构建一个更鲁棒、更公平的LLM不可学习评估框架。通过设计对对抗性攻击更具抵抗力的评估指标,以及提出一种校准方法来消除不可学习对非目标数据的影响,从而实现更准确、更可靠的评估。

技术框架:该评估框架主要包含以下几个模块:1) 候选评估指标的设计与评估:设计一系列新的评估指标,并评估其在不同类型的对抗性攻击下的鲁棒性。2) 鲁棒性指标选择:选择在各种攻击下表现最稳定的指标作为最终的评估指标。3) 性能校准:提出一种校准方法,用于恢复不可学习后非目标数据的原始性能。4) 不可学习效果评估与比较:使用校准后的模型和鲁棒的评估指标,对不同的不可学习方法进行评估和比较。

关键创新:本文的关键创新在于:1) 提出了针对LLM不可学习评估的鲁棒性指标,解决了现有指标容易受到对抗性攻击的问题。2) 提出了一种性能校准方法,解决了不可学习过程中目标冲突的问题,使得不同方法之间的比较更加公平。

关键设计:在评估指标方面,论文可能考虑了基于困惑度、生成文本相似度、知识问答等多种指标,并设计了相应的对抗性攻击方法来评估其鲁棒性。性能校准方法可能涉及到对模型参数进行微调,以恢复非目标数据的性能。具体的参数设置、损失函数和网络结构等细节在论文中会详细描述。

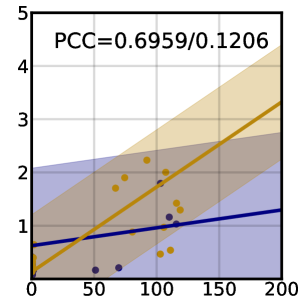

🖼️ 关键图片

📊 实验亮点

该研究通过实验验证了所提出的评估框架的有效性。实验结果表明,新的评估指标比现有指标更鲁棒,能够更准确地反映LLM的不可学习效果。此外,性能校准方法能够有效恢复非目标数据的性能,使得不同不可学习方法之间的比较更加公平。具体性能提升数据未知,需要在论文中查找。

🎯 应用场景

该研究成果可应用于各种需要保护用户隐私和数据安全的LLM应用场景,例如:在线教育、智能客服、医疗诊断等。通过使用更有效的不可学习方法,可以防止LLM泄露敏感信息,提高用户对AI系统的信任度,并促进LLM在更广泛领域的应用。

📄 摘要(原文)

The imperative to eliminate undesirable data memorization underscores the significance of machine unlearning for large language models (LLMs). Recent research has introduced a series of promising unlearning methods, notably boosting the practical significance of the field. Nevertheless, adopting a proper evaluation framework to reflect the true unlearning efficacy is also essential yet has not received adequate attention. This paper seeks to refine the evaluation of LLM unlearning by addressing two key challenges -- a) the robustness of evaluation metrics and b) the trade-offs between competing goals. The first challenge stems from findings that current metrics are susceptible to various red teaming scenarios. It indicates that they may not reflect the true extent of knowledge retained by LLMs but rather tend to mirror superficial model behaviors, thus prone to attacks. We address this issue by devising and assessing a series of candidate metrics, selecting the most robust ones under various types of attacks. The second challenge arises from the conflicting goals of eliminating unwanted knowledge while retaining those of others. This trade-off between unlearning and retention often fails to conform the Pareto frontier, rendering it subtle to compare the efficacy between methods that excel only in either unlearning or retention. We handle this issue by proposing a calibration method that can restore the original performance on non-targeted data after unlearning, thereby allowing us to focus exclusively on assessing the strength of unlearning. Our evaluation framework notably enhances the effectiveness when assessing and comparing various LLM unlearning methods, further allowing us to benchmark existing works, identify their proper hyper-parameters, and explore new tricks to enhance their practical efficacy.