State-Space Modeling in Long Sequence Processing: A Survey on Recurrence in the Transformer Era

作者: Matteo Tiezzi, Michele Casoni, Alessandro Betti, Marco Gori, Stefano Melacci

分类: cs.LG

发布日期: 2024-06-13 (更新: 2025-08-18)

备注: Currently under review

💡 一句话要点

综述:Transformer时代长序列建模中的状态空间模型与循环机制

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 长序列建模 循环神经网络 状态空间模型 Transformer 注意力机制

📋 核心要点

- 现有方法在处理长序列时,难以兼顾长期依赖关系和计算效率,Transformer虽然性能强大,但在长序列建模方面存在局限性。

- 该综述聚焦于基于循环机制的状态空间模型和新型Transformer,旨在克服传统方法的局限,实现更高效的长序列建模。

- 该综述对最新的循环模型架构和算法进行了全面分类和讨论,为研究人员提供了该领域的研究方向指导。

📝 摘要(中文)

有效学习序列数据是人工智能领域一个长期目标,尤其是在长序列情况下。自机器学习诞生以来,研究人员一直在探索能够处理序列模式的算法和架构,这些算法和架构能够保留关于过去输入的信息,同时利用未来的数据,而不会丢失宝贵的长期依赖关系和相关性。虽然这个终极目标受到人类实时处理感觉信息的启发,但许多解决方案通过人为地限制处理的上下文或处理有限长度的序列来简化学习范式。Transformer的普及进一步强调了这些解决方案,Transformer最初掩盖了循环神经网络的作用。然而,由于(深度)状态空间模型和大型上下文Transformer的新实例日益普及,循环网络目前正在经历强劲的复苏,它们都基于循环计算,旨在超越当前普遍技术的若干限制。大型语言模型的快速发展重新燃起了人们对高效处理时间数据的解决方案的兴趣。本综述深入总结了基于循环模型的序列数据处理的最新方法。报告并讨论了架构和算法解决方案的最新趋势的完整分类,指导研究人员进入这个吸引人的研究领域。新兴的图景表明,存在探索新途径的空间,这些途径由偏离标准时间反向传播的学习算法构成,朝着更真实的场景发展,在这些场景中,模式可以有效地在线处理,利用局部前向计算,并为该主题的研究开辟新的方向。

🔬 方法详解

问题定义:论文旨在解决长序列建模问题,现有方法如传统RNN存在梯度消失/爆炸问题,难以捕捉长期依赖;Transformer虽然通过注意力机制缓解了这个问题,但计算复杂度随序列长度呈平方增长,限制了其在超长序列上的应用。因此,如何设计既能有效捕捉长期依赖,又能高效处理长序列的模型是一个关键挑战。

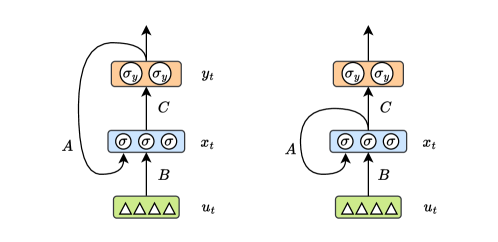

核心思路:论文的核心思路是深入研究基于循环机制的状态空间模型(SSM)和新型Transformer架构,这些模型通过循环计算来处理序列数据,从而在计算效率和建模能力之间取得平衡。SSM通过隐状态来记忆过去的信息,并利用循环更新规则来处理新的输入,而新型Transformer则通过改进注意力机制或引入循环结构来提高长序列处理能力。

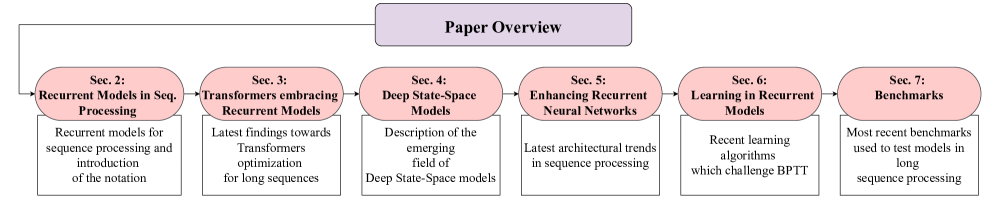

技术框架:该综述论文首先对长序列建模的背景和挑战进行了概述,然后详细介绍了基于循环机制的状态空间模型(SSM)的各种变体,包括其基本原理、架构设计和训练方法。接着,论文讨论了近年来涌现的新型Transformer架构,这些架构通过改进注意力机制、引入循环结构或采用其他技术手段来提高长序列处理能力。最后,论文对这些方法的优缺点进行了比较分析,并展望了未来发展方向。

关键创新:该综述的关键创新在于对Transformer时代下,循环机制在长序列建模中的复兴进行了系统性的梳理和分析。它不仅涵盖了传统的RNN和LSTM等循环神经网络,还重点关注了近年来兴起的基于状态空间模型的序列建模方法,以及在Transformer架构中融入循环机制的创新尝试。通过对这些方法的深入剖析,该综述揭示了循环机制在长序列建模中的重要作用和潜力。

关键设计:该综述的关键设计在于其全面的分类体系和深入的分析视角。它将各种基于循环机制的长序列建模方法按照不同的维度进行分类,例如按照循环单元的类型、状态更新的方式、注意力机制的改进等。同时,该综述还对这些方法的优缺点进行了深入的分析,并指出了未来研究的潜在方向。此外,该综述还关注了这些方法在实际应用中的表现,例如在语言建模、语音识别等任务上的性能。

🖼️ 关键图片

📊 实验亮点

由于是综述文章,没有具体的实验结果。但文章总结了大量基于循环机制和状态空间模型的长序列建模方法,并分析了它们在不同任务上的表现。通过对比这些方法的优缺点,为研究人员提供了选择合适模型的参考依据。此外,文章还指出了未来研究的潜在方向,例如探索新的循环单元设计、改进状态更新机制、以及将循环机制与Transformer架构更紧密地结合等。

🎯 应用场景

该研究对长序列建模具有广泛的应用前景,包括自然语言处理(如机器翻译、文本生成)、语音识别、视频分析、时间序列预测等领域。更高效的长序列建模能力可以提升这些应用在处理复杂任务时的性能,例如理解长篇文档、生成高质量的对话、预测金融市场趋势等。此外,该研究还有助于开发更智能的机器人和自动化系统,使其能够更好地理解和响应周围环境。

📄 摘要(原文)

Effectively learning from sequential data is a longstanding goal of Artificial Intelligence, especially in the case of long sequences. From the dawn of Machine Learning, several researchers have pursued algorithms and architectures capable of processing sequences of patterns, retaining information about past inputs while still leveraging future data, without losing precious long-term dependencies and correlations. While such an ultimate goal is inspired by the human hallmark of continuous real-time processing of sensory information, several solutions have simplified the learning paradigm by artificially limiting the processed context or dealing with sequences of limited length, given in advance. These solutions were further emphasized by the ubiquity of Transformers, which initially overshadowed the role of Recurrent Neural Nets. However, recurrent networks are currently experiencing a strong recent revival due to the growing popularity of (deep) State-Space models and novel instances of large-context Transformers, which are both based on recurrent computations that aim to go beyond several limits of currently ubiquitous technologies. The fast development of Large Language Models has renewed the interest in efficient solutions to process data over time. This survey provides an in-depth summary of the latest approaches that are based on recurrent models for sequential data processing. A complete taxonomy of recent trends in architectural and algorithmic solutions is reported and discussed, guiding researchers in this appealing research field. The emerging picture suggests that there is room for exploring novel routes, constituted by learning algorithms that depart from the standard Backpropagation Through Time, towards a more realistic scenario where patterns are effectively processed online, leveraging local-forward computations, and opening new directions for research on this topic.