CMamba: Channel Correlation Enhanced State Space Models for Multivariate Time Series Forecasting

作者: Chaolv Zeng, Zhanyu Liu, Guanjie Zheng, Linghe Kong

分类: cs.LG

发布日期: 2024-06-08 (更新: 2024-09-26)

💡 一句话要点

提出CMamba模型,通过增强通道相关性的状态空间模型提升多元时间序列预测性能。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多元时间序列预测 状态空间模型 Mamba 跨通道依赖性 全局数据依赖MLP 时间依赖性建模 通道混合

📋 核心要点

- 现有Mamba模型在多元时间序列预测中处理跨通道依赖性不足,限制了其性能。

- CMamba模型通过引入全局数据依赖MLP和改进的Mamba模块来增强跨通道依赖性建模能力。

- 在七个真实数据集上的实验表明,CMamba模型能够有效提高时间序列预测的准确性。

📝 摘要(中文)

本文提出了一种改进的Mamba模型CMamba,专门用于多元时间序列预测。现有基于线性、Transformer和卷积的模型在时间序列预测中取得了进展,特别是Transformer在时序和跨通道混合方面表现出色。Mamba作为一种状态空间模型,具有强大的序列和特征混合能力。然而,原始Mamba设计在处理跨通道依赖性方面存在不足,这限制了其在时间序列预测中的应用。CMamba模型包含一个改进的Mamba (M-Mamba)模块用于建模时间依赖性,一个全局数据依赖MLP (GDD-MLP)用于有效捕获跨通道依赖性,以及一个通道混合机制来缓解过拟合。在七个真实世界数据集上的综合实验表明,CMamba模型能够有效提高预测性能。

🔬 方法详解

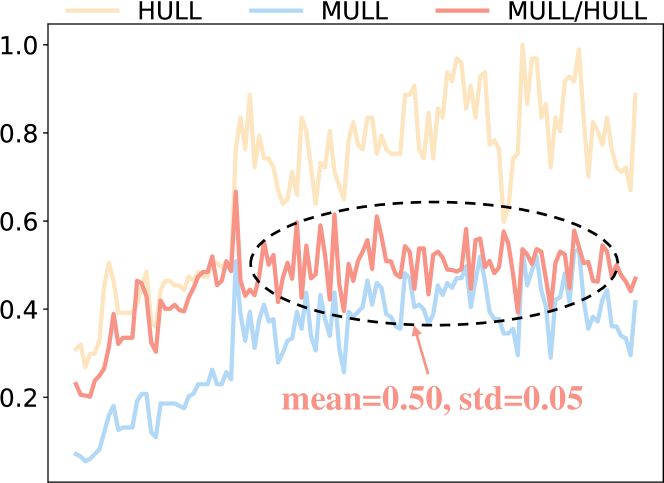

问题定义:多元时间序列预测旨在根据历史数据预测多个变量未来的值。现有方法,特别是原始Mamba模型,在捕获不同变量之间的跨通道依赖性方面存在不足,导致预测精度下降。简单的MLP结构虽然具有学习能力,但由于缺乏数据依赖性和全局感受野,在跨通道依赖建模上表现不佳。

核心思路:CMamba的核心思路是通过引入全局数据依赖机制来增强模型对跨通道依赖性的建模能力。具体来说,使用全局数据依赖MLP (GDD-MLP) 来显式地捕获通道间的相关性,并结合改进的Mamba (M-Mamba)模块来建模时间依赖性。同时,采用通道混合机制来防止过拟合。

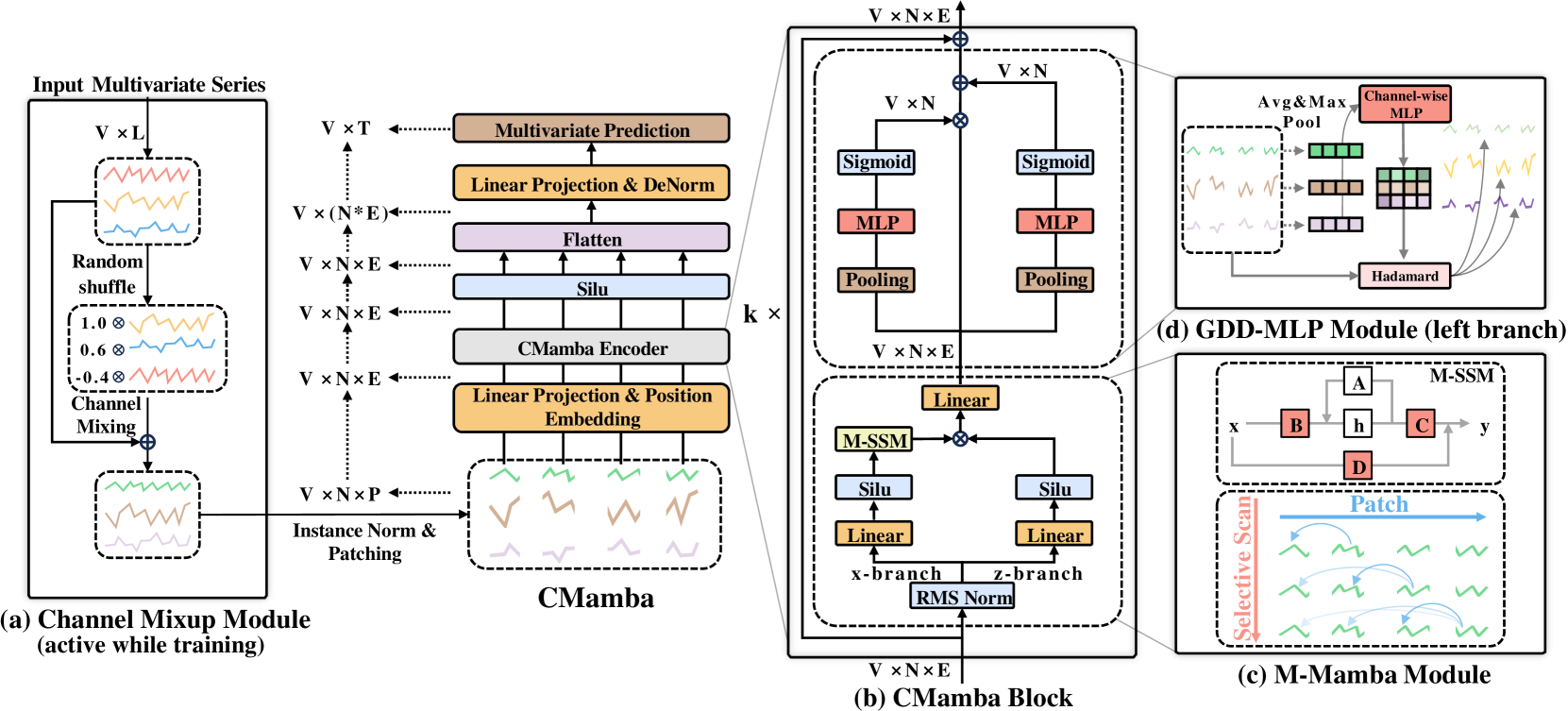

技术框架:CMamba模型的整体架构包含三个主要模块:M-Mamba模块、GDD-MLP模块和通道混合模块。首先,输入时间序列数据经过M-Mamba模块进行时间依赖性建模。然后,GDD-MLP模块利用全局数据依赖性来捕获跨通道依赖性。最后,通道混合模块用于缓解过拟合,提高模型的泛化能力。

关键创新:CMamba的关键创新在于引入了全局数据依赖MLP (GDD-MLP) 来显式地建模跨通道依赖性。与传统的MLP相比,GDD-MLP能够根据输入数据的全局信息动态地调整权重,从而更有效地捕获通道间的相关性。此外,改进的Mamba (M-Mamba)模块进一步增强了模型的时间依赖性建模能力。

关键设计:GDD-MLP模块的设计是关键。它首先对输入数据进行全局池化,得到全局上下文向量。然后,使用该向量来动态地调整MLP的权重。通道混合模块采用Mixup策略,通过对不同通道的数据进行线性插值来生成新的训练样本,从而提高模型的鲁棒性。具体的损失函数和网络结构细节在论文中有详细描述,但摘要中未明确提及具体参数设置。

🖼️ 关键图片

📊 实验亮点

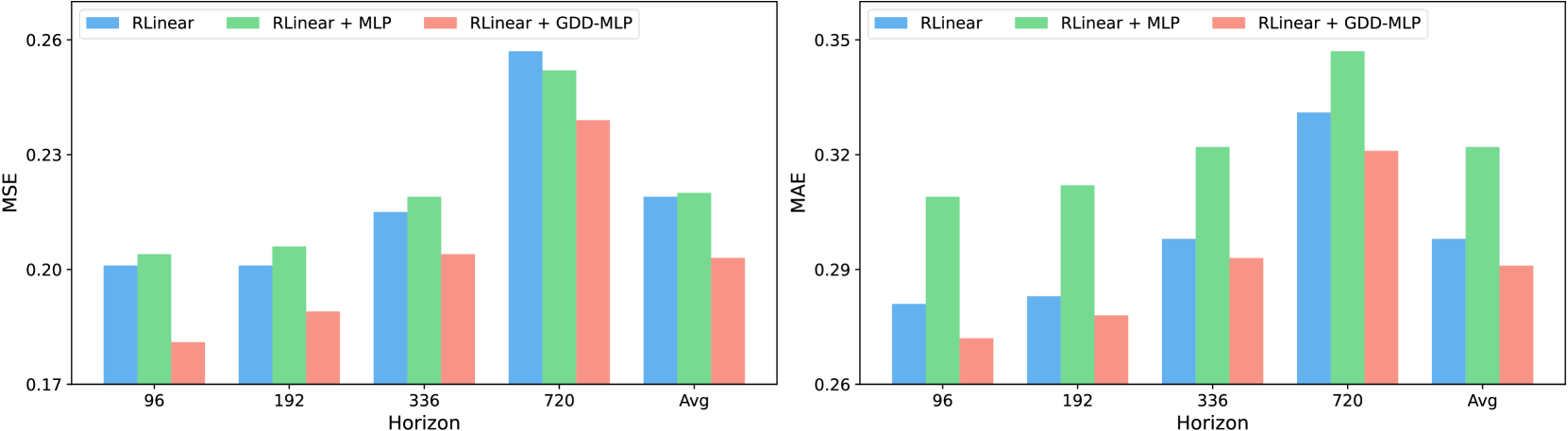

实验结果表明,CMamba模型在七个真实世界数据集上均取得了优于现有模型的预测性能。具体的性能提升幅度未知,但摘要强调了CMamba在提高预测性能方面的有效性。与基线模型相比,CMamba能够更准确地捕获时间依赖性和跨通道依赖性,从而实现更精确的预测。

🎯 应用场景

CMamba模型可应用于金融、交通、能源等多个领域的时间序列预测任务。例如,在金融领域,可以用于股票价格预测、风险管理等;在交通领域,可以用于交通流量预测、智能交通控制等;在能源领域,可以用于电力负荷预测、可再生能源发电预测等。该模型能够提高预测精度,为相关领域的决策提供更可靠的依据。

📄 摘要(原文)

Recent advancements in multivariate time series forecasting have been propelled by Linear-based, Transformer-based, and Convolution-based models, with Transformer-based architectures gaining prominence for their efficacy in temporal and cross-channel mixing. More recently, Mamba, a state space model, has emerged with robust sequence and feature mixing capabilities. However, the suitability of the vanilla Mamba design for time series forecasting remains an open question, particularly due to its inadequate handling of cross-channel dependencies. Capturing cross-channel dependencies is critical in enhancing the performance of multivariate time series prediction. Recent findings show that self-attention excels in capturing cross-channel dependencies, whereas other simpler mechanisms, such as MLP, may degrade model performance. This is counterintuitive, as MLP, being a learnable architecture, should theoretically capture both correlations and irrelevances, potentially leading to neutral or improved performance. Diving into the self-attention mechanism, we attribute the observed degradation in MLP performance to its lack of data dependence and global receptive field, which result in MLP's lack of generalization ability. Based on the above insights, we introduce a refined Mamba variant tailored for time series forecasting. Our proposed model, \textbf{CMamba}, incorporates a modified Mamba (M-Mamba) module for temporal dependencies modeling, a global data-dependent MLP (GDD-MLP) to effectively capture cross-channel dependencies, and a Channel Mixup mechanism to mitigate overfitting. Comprehensive experiments conducted on seven real-world datasets demonstrate the efficacy of our model in improving forecasting performance.