Confidence-aware Contrastive Learning for Selective Classification

作者: Yu-Chang Wu, Shen-Huan Lyu, Haopu Shang, Xiangyu Wang, Chao Qian

分类: cs.LG, cs.CV

发布日期: 2024-06-07

备注: Accepted by ICML 2024

💡 一句话要点

提出置信度感知的对比学习方法CCL-SC,提升选择性分类性能

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 选择性分类 对比学习 置信度感知 特征表示学习 深度学习

📋 核心要点

- 现有选择性分类方法主要集中在修改分类层结构以估计置信度,忽略了特征层的重要性。

- 论文提出置信度感知的对比学习方法CCL-SC,通过对比学习在特征层面提升选择性分类性能。

- 实验表明,CCL-SC在多个数据集上显著降低了选择性风险,且能与现有方法结合进一步提升性能。

📝 摘要(中文)

选择性分类旨在使模型仅在具有足够置信度时才进行预测,从而提高安全性和可靠性,这在高度敏感的场景中至关重要。以往方法主要使用深度神经网络,并侧重于修改分类层的结构以估计预测的置信度。本文为选择性分类提供了一个泛化界限,揭示了优化特征层有助于提升选择性分类的性能。受此理论启发,我们首次提出在特征层面显式地改进选择性分类模型,从而提出了一种新颖的置信度感知对比学习方法CCL-SC,用于选择性分类,该方法在模型置信度的控制下,使同类实例的特征相似,异类实例的特征不同。在CIFAR-10、CIFAR-100、CelebA和ImageNet等典型数据集上的实验结果表明,CCL-SC在几乎所有覆盖度上都实现了比现有最佳方法显著更低的选择性风险。此外,它可以与现有方法结合以带来进一步的改进。

🔬 方法详解

问题定义:选择性分类旨在让模型仅在足够自信时才进行预测,从而提高模型的可靠性。现有方法主要集中在修改分类层,缺乏对特征层优化的考虑,导致性能提升受限。如何有效利用特征层信息,提升选择性分类的性能是一个关键问题。

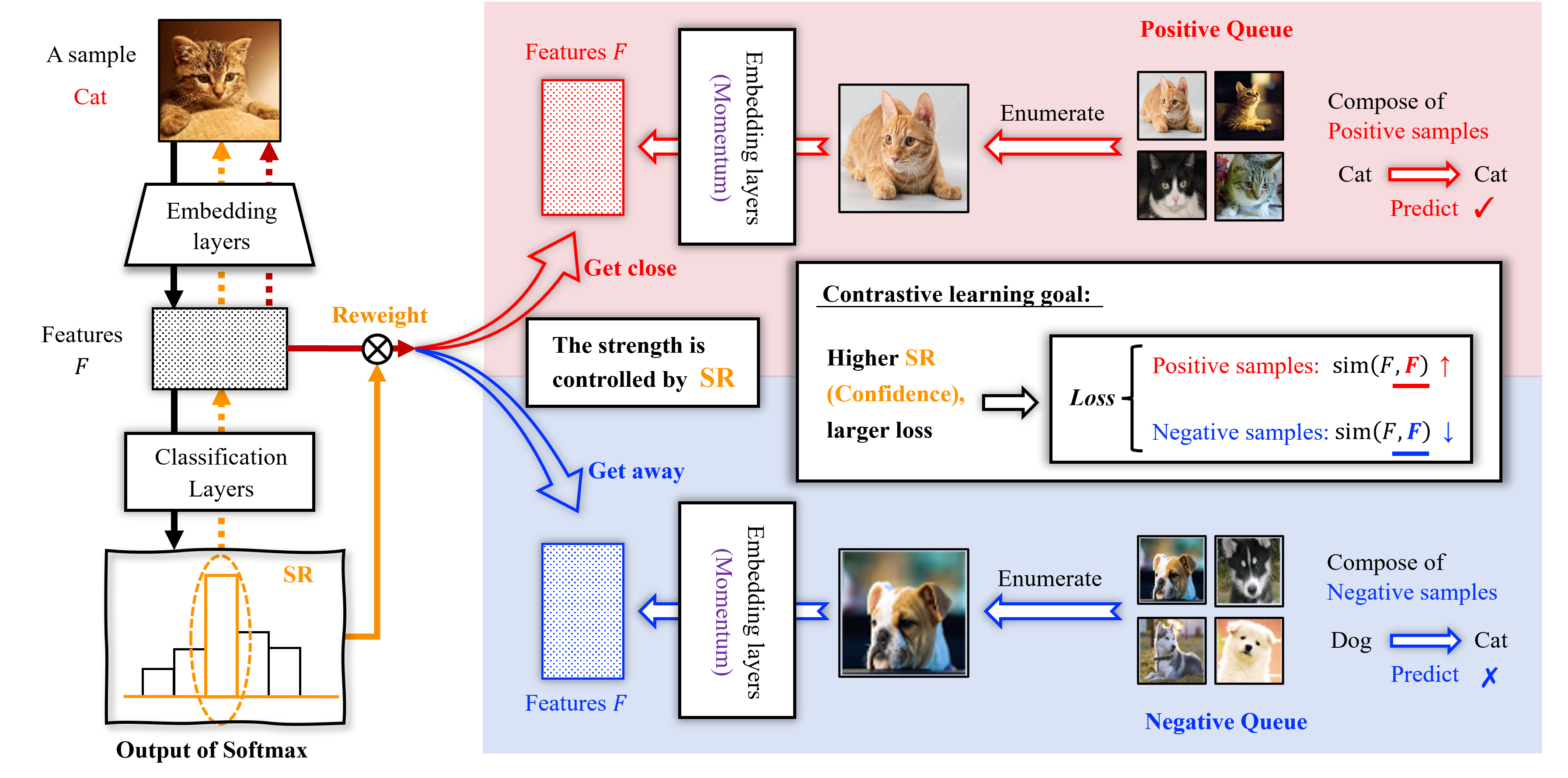

核心思路:论文的核心思路是利用对比学习,在特征层面显式地提升选择性分类模型的性能。通过置信度感知的方式,使模型对同类样本的特征表示更加接近,对异类样本的特征表示更加远离。这种方式能够增强特征的区分性,从而提高模型预测的置信度。

技术框架:CCL-SC方法的整体框架包括以下几个主要步骤:1) 使用标准的深度神经网络提取输入样本的特征表示;2) 利用分类层预测样本的类别和置信度;3) 根据预测的置信度,计算对比学习的损失函数,该损失函数鼓励同类样本的特征表示更加接近,异类样本的特征表示更加远离;4) 将对比学习的损失函数与分类损失函数结合,共同优化整个模型。

关键创新:该方法最重要的创新点在于首次将对比学习引入到选择性分类的特征层优化中,并提出了置信度感知的对比学习策略。与传统的对比学习方法不同,CCL-SC根据模型自身的置信度来调整对比学习的强度,使得模型能够更加关注那些置信度较低的样本,从而提高整体的性能。

关键设计:CCL-SC的关键设计包括:1) 使用交叉熵损失作为分类损失函数;2) 使用InfoNCE损失作为对比学习的损失函数,并根据模型的置信度对损失进行加权;3) 使用余弦相似度来衡量特征表示之间的距离;4) 通过调整置信度阈值来控制模型的覆盖率和选择性风险。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CCL-SC在CIFAR-10、CIFAR-100、CelebA和ImageNet等数据集上,相较于现有最佳方法,显著降低了选择性风险。例如,在CIFAR-10数据集上,CCL-SC在不同覆盖率下均取得了更低的选择性风险。此外,CCL-SC还可以与现有方法结合,进一步提升性能,展现了良好的泛化能力。

🎯 应用场景

该研究成果可应用于对安全性要求极高的场景,如自动驾驶、医疗诊断、金融风控等。在这些领域,模型必须能够识别自身的不确定性,并避免在没有足够信心的情况下做出错误的决策。通过提高选择性分类的性能,可以显著降低这些场景中的风险,并提高系统的可靠性。

📄 摘要(原文)

Selective classification enables models to make predictions only when they are sufficiently confident, aiming to enhance safety and reliability, which is important in high-stakes scenarios. Previous methods mainly use deep neural networks and focus on modifying the architecture of classification layers to enable the model to estimate the confidence of its prediction. This work provides a generalization bound for selective classification, disclosing that optimizing feature layers helps improve the performance of selective classification. Inspired by this theory, we propose to explicitly improve the selective classification model at the feature level for the first time, leading to a novel Confidence-aware Contrastive Learning method for Selective Classification, CCL-SC, which similarizes the features of homogeneous instances and differentiates the features of heterogeneous instances, with the strength controlled by the model's confidence. The experimental results on typical datasets, i.e., CIFAR-10, CIFAR-100, CelebA, and ImageNet, show that CCL-SC achieves significantly lower selective risk than state-of-the-art methods, across almost all coverage degrees. Moreover, it can be combined with existing methods to bring further improvement.