LinkGPT: Teaching Large Language Models To Predict Missing Links

作者: Zhongmou He, Jing Zhu, Shengyi Qian, Joyce Chai, Danai Koutra

分类: cs.LG

发布日期: 2024-06-07

💡 一句话要点

提出LinkGPT,利用大型语言模型预测图数据中缺失的链接,实现高效图推理。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 链接预测 图神经网络 指令调优 知识图谱

📋 核心要点

- 现有方法难以有效整合成对结构信息,且计算成本高昂,限制了大型语言模型在链接预测任务中的应用。

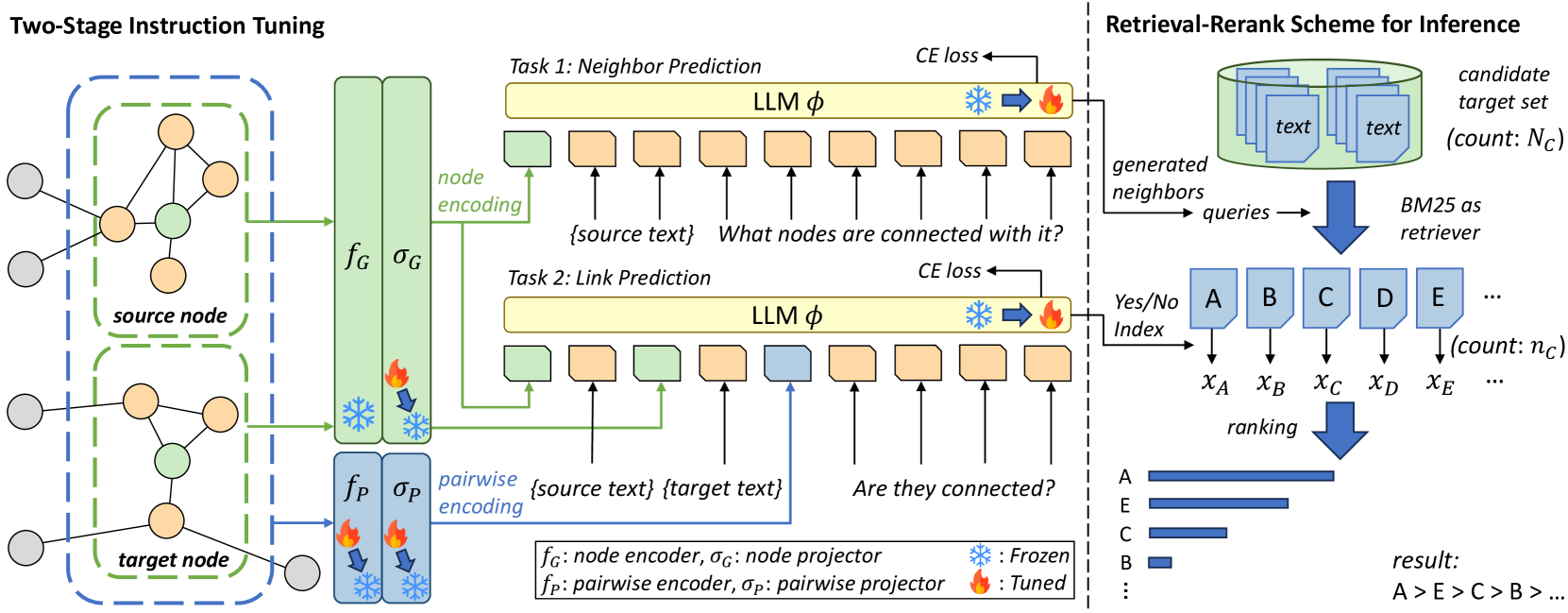

- LinkGPT通过两阶段指令调优,增强LLM对图结构的理解,并采用检索-重排序方案加速推理过程。

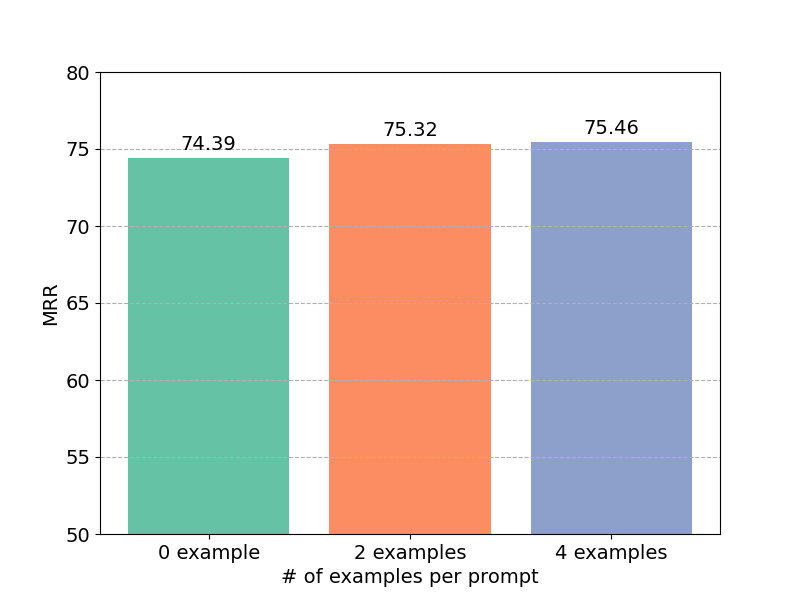

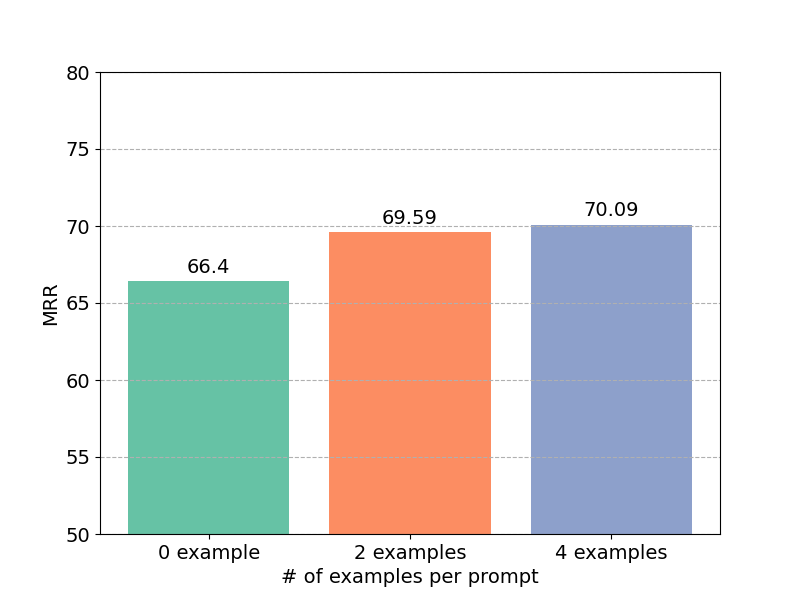

- 实验结果表明,LinkGPT在真实图数据上取得了SOTA性能,并在零样本和少样本学习中表现出优越的泛化能力,推理速度提升10倍。

📝 摘要(中文)

本文提出了一项新的任务,旨在利用大型语言模型(LLMs)预测图中节点之间缺失的链接。该任务评估了LLM基于学习到的模式对结构化数据进行推理和推断新事实的能力。这项新任务面临两个关键挑战:(1) 如何有效地将成对结构信息整合到LLM中,这对于链接预测(LP)的性能至关重要;(2) 如何解决教LLM执行LP时的计算瓶颈。为了应对这些挑战,我们提出了LinkGPT,这是第一个用于LP任务的端到端训练的LLM。为了有效提高LLM理解底层结构的能力,我们设计了一个两阶段的指令调优方法,第一阶段微调成对编码器、投影器和节点投影器,第二阶段进一步微调LLM以预测链接。为了解决推理时的效率挑战,我们引入了一种检索-重排序方案。实验表明,LinkGPT可以在真实世界的图上实现最先进的性能,并在零样本和少样本学习中实现卓越的泛化,超越现有的基准。在推理时,它可以实现10倍的加速,同时保持较高的LP精度。

🔬 方法详解

问题定义:论文旨在解决图数据中链接预测的问题,即预测图中节点之间缺失的连接关系。现有方法在利用大型语言模型进行链接预测时,面临两个主要痛点:一是如何有效地将成对结构信息融入LLM中,二是如何解决训练和推理过程中的计算效率问题。

核心思路:论文的核心思路是设计一个端到端可训练的LLM框架LinkGPT,通过两阶段指令调优来增强LLM对图结构的理解能力,并利用检索-重排序策略来加速推理过程。这种设计旨在充分利用LLM的语言建模能力和图结构的先验知识,从而提高链接预测的准确性和效率。

技术框架:LinkGPT的整体框架包含以下几个主要模块:1) Pairwise Encoder: 用于编码节点对之间的结构信息。2) Projector: 将编码后的结构信息投影到LLM的嵌入空间。3) Node Projector: 将节点特征投影到LLM的嵌入空间。4) LLM: 使用指令调优的方式,学习预测节点之间的链接关系。5) Retrieval-Reranking: 在推理阶段,首先检索候选链接,然后使用LLM对候选链接进行重排序,从而提高推理效率。

关键创新:LinkGPT的关键创新在于:1) 提出了一个端到端可训练的LLM框架,专门用于链接预测任务。2) 设计了一个两阶段指令调优方法,有效地将图结构信息融入LLM中。3) 引入了一种检索-重排序方案,显著提高了推理效率。与现有方法相比,LinkGPT能够更好地利用LLM的语言建模能力和图结构的先验知识,从而实现更高的链接预测准确性和效率。

关键设计:在两阶段指令调优中,第一阶段主要微调Pairwise Encoder、Projector和Node Projector,使其能够更好地将图结构信息编码到LLM的嵌入空间。第二阶段主要微调LLM,使其能够根据编码后的图结构信息预测节点之间的链接关系。在检索-重排序方案中,使用基于图嵌入的相似度搜索来检索候选链接,然后使用LLM对候选链接进行重排序。具体的参数设置和损失函数细节在论文中进行了详细描述(未知)。

🖼️ 关键图片

📊 实验亮点

LinkGPT在真实世界的图数据集上取得了state-of-the-art的性能,并在零样本和少样本学习中表现出卓越的泛化能力,超越了现有的基准模型。此外,LinkGPT在推理时实现了10倍的加速,同时保持了较高的链接预测精度,显著提升了图推理的效率。

🎯 应用场景

LinkGPT在社交网络分析、知识图谱补全、推荐系统等领域具有广泛的应用前景。例如,可以用于预测社交网络中潜在的朋友关系,补全知识图谱中缺失的实体关系,或者为用户推荐可能感兴趣的商品或服务。该研究有助于提升图数据分析和推理的效率和准确性,具有重要的实际价值和未来影响。

📄 摘要(原文)

Large Language Models (LLMs) have shown promising results on various language and vision tasks. Recently, there has been growing interest in applying LLMs to graph-based tasks, particularly on Text-Attributed Graphs (TAGs). However, most studies have focused on node classification, while the use of LLMs for link prediction (LP) remains understudied. In this work, we propose a new task on LLMs, where the objective is to leverage LLMs to predict missing links between nodes in a graph. This task evaluates an LLM's ability to reason over structured data and infer new facts based on learned patterns. This new task poses two key challenges: (1) How to effectively integrate pairwise structural information into the LLMs, which is known to be crucial for LP performance, and (2) how to solve the computational bottleneck when teaching LLMs to perform LP. To address these challenges, we propose LinkGPT, the first end-to-end trained LLM for LP tasks. To effectively enhance the LLM's ability to understand the underlying structure, we design a two-stage instruction tuning approach where the first stage fine-tunes the pairwise encoder, projector, and node projector, and the second stage further fine-tunes the LLMs to predict links. To address the efficiency challenges at inference time, we introduce a retrieval-reranking scheme. Experiments show that LinkGPT can achieve state-of-the-art performance on real-world graphs as well as superior generalization in zero-shot and few-shot learning, surpassing existing benchmarks. At inference time, it can achieve $10\times$ speedup while maintaining high LP accuracy.