Open-Endedness is Essential for Artificial Superhuman Intelligence

作者: Edward Hughes, Michael Dennis, Jack Parker-Holder, Feryal Behbahani, Aditi Mavalankar, Yuge Shi, Tom Schaul, Tim Rocktaschel

分类: cs.LG, cs.AI

发布日期: 2024-06-06

💡 一句话要点

提出开放性思维以实现人工超人智能的自我提升

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 开放性人工智能 超人智能 基础模型 自我提升 新颖性发现

📋 核心要点

- 核心问题:现有人工智能系统缺乏开放性和自我提升能力,难以实现真正的超人智能。

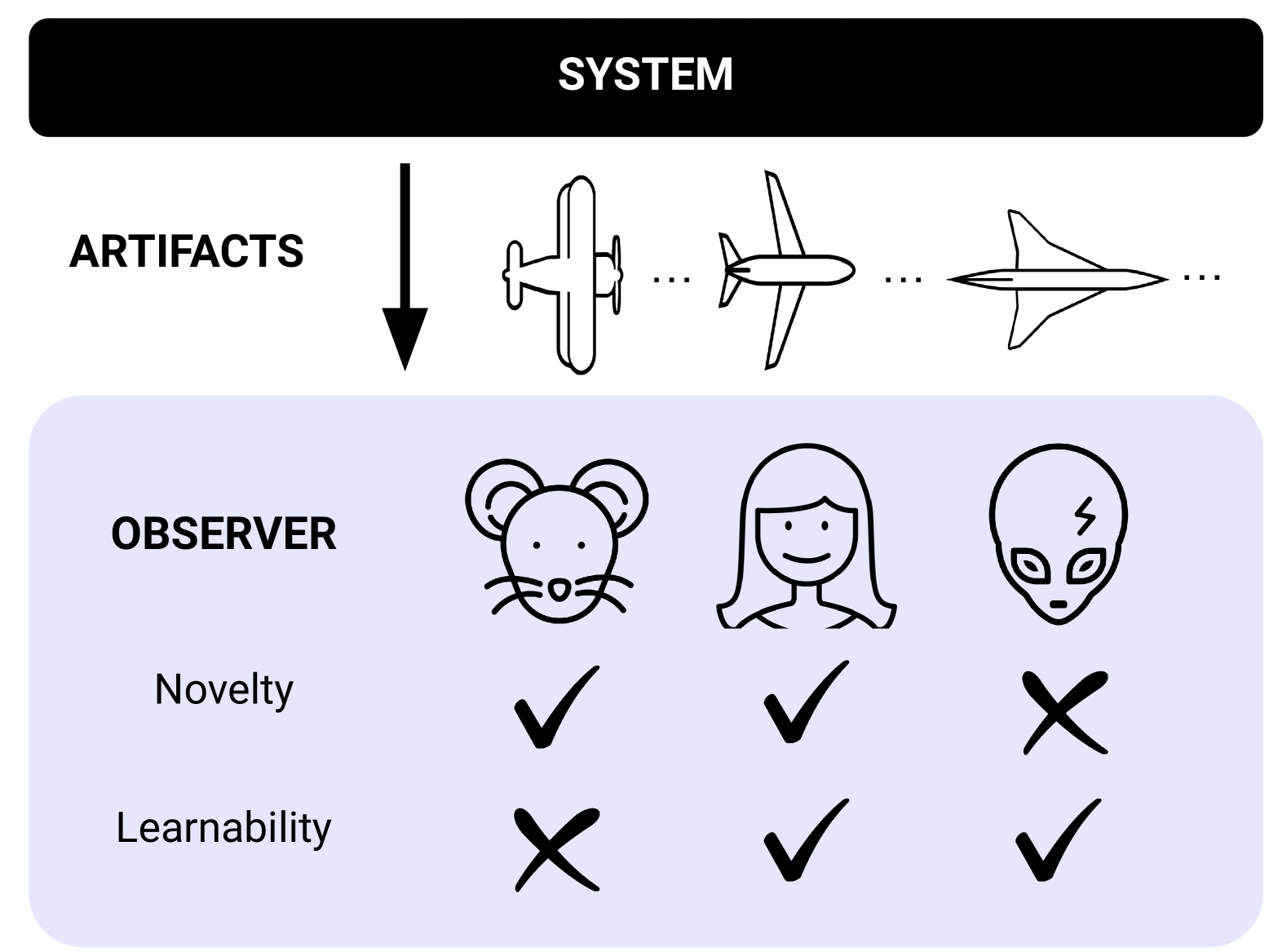

- 方法要点:提出通过新颖性和可学习性定义开放性,并展示如何利用基础模型构建开放性系统。

- 实验或效果:探讨开放性人工智能的安全性影响,强调其在未来研究中的重要性。

📝 摘要(中文)

近年来,人工智能系统的通用能力大幅提升,主要得益于在互联网规模数据上训练基础模型。然而,创造开放性、持续自我提升的人工智能仍然难以实现。本文认为,当前条件已具备实现开放性人工智能,并且这种开放性是任何人工超人智能的基本特性。我们通过新颖性和可学习性的视角提供了开放性的具体形式化定义,并展示了通过建立在基础模型之上的开放性系统实现人工超人智能的路径,能够进行新颖且与人类相关的发现。最后,我们探讨了通用开放性人工智能的安全性影响,预计开放性基础模型将成为未来研究的重要领域。

🔬 方法详解

问题定义:本文旨在解决人工智能系统缺乏开放性和自我提升的问题。现有方法往往依赖于固定的数据集和任务,无法适应不断变化的环境和需求。

核心思路:论文提出开放性思维的概念,强调通过新颖性和可学习性来定义开放性,从而实现人工智能的自我提升和创新能力。这样的设计能够使人工智能系统在面对未知任务时,具备更强的适应性和创造性。

技术框架:整体架构包括基础模型的训练、开放性系统的构建以及新颖性发现的实现。主要模块包括数据收集、模型训练、评估和反馈机制,确保系统能够持续学习和改进。

关键创新:最重要的技术创新在于将开放性与基础模型结合,形成一个能够自我提升的智能体。这与现有方法的本质区别在于,传统方法通常是静态的,而本文提出的系统具备动态适应能力。

关键设计:在参数设置上,采用灵活的学习率和损失函数,以适应不同的任务需求。网络结构上,结合多层次的神经网络以增强模型的表达能力,并通过反馈机制不断优化模型性能。

🖼️ 关键图片

📊 实验亮点

本文强调开放性人工智能的安全性影响,提出的系统在面对新任务时展现出显著的适应能力和创新能力。尽管具体性能数据尚未披露,但预期在未来的实验中将展示出超越传统模型的显著提升。

🎯 应用场景

该研究的潜在应用领域包括智能助手、自动化决策系统和创新性研究工具等。通过实现开放性人工智能,能够在医疗、金融、教育等多个领域提供更为智能和个性化的服务,推动技术的进步与社会的发展。

📄 摘要(原文)

In recent years there has been a tremendous surge in the general capabilities of AI systems, mainly fuelled by training foundation models on internetscale data. Nevertheless, the creation of openended, ever self-improving AI remains elusive. In this position paper, we argue that the ingredients are now in place to achieve openendedness in AI systems with respect to a human observer. Furthermore, we claim that such open-endedness is an essential property of any artificial superhuman intelligence (ASI). We begin by providing a concrete formal definition of open-endedness through the lens of novelty and learnability. We then illustrate a path towards ASI via open-ended systems built on top of foundation models, capable of making novel, humanrelevant discoveries. We conclude by examining the safety implications of generally-capable openended AI. We expect that open-ended foundation models will prove to be an increasingly fertile and safety-critical area of research in the near future.