Multi-Agent Imitation Learning: Value is Easy, Regret is Hard

作者: Jingwu Tang, Gokul Swamy, Fei Fang, Zhiwei Steven Wu

分类: cs.LG

发布日期: 2024-06-06 (更新: 2024-06-26)

💡 一句话要点

针对多智能体模仿学习,提出基于遗憾差距最小化的MALICE和BLADES算法。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多智能体模仿学习 遗憾差距 策略性智能体 在线凸优化 马尔可夫博弈

📋 核心要点

- 现有MAIL方法在非策略智能体假设下有效,但忽略了策略性智能体可能产生的偏差,导致鲁棒性不足。

- 论文提出基于遗憾差距最小化的MAIL目标,显式考虑智能体的潜在偏差,以提高策略性环境下的鲁棒性。

- 论文提出了MALICE和BLADES两种算法,分别在专家覆盖假设和可查询专家条件下,有效最小化遗憾差距。

📝 摘要(中文)

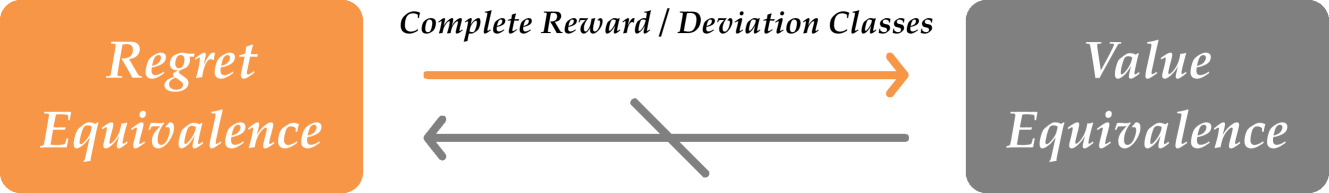

本文研究多智能体模仿学习(MAIL)问题,从学习者的角度出发,试图基于专家演示协调一组智能体。现有MAIL工作主要将问题简化为匹配专家在演示支持范围内的行为。虽然在智能体非策略性的假设下,这样做足以将学习者和专家之间的价值差距驱动为零,但不能保证对策略性智能体偏差的鲁棒性。直观地说,这是因为策略性偏差可能取决于一个反事实量:协调者在他们的推荐所诱导的状态分布之外的推荐。因此,我们开始研究马尔可夫博弈中MAIL的另一种目标,我们称之为遗憾差距,它明确考虑了群体中智能体的潜在偏差。我们首先深入探讨了价值差距和遗憾差距之间的关系。首先,我们表明,虽然价值差距可以通过单智能体IL算法的直接扩展来有效最小化,但即使价值等价也可能导致任意大的遗憾差距。这意味着在MAIL中实现遗憾等价比实现价值等价更难。然后,我们提供了一对有效的归约到无遗憾在线凸优化,它们能够在(a)专家覆盖假设下(MALICE)或(b)在可以查询专家的条件下(BLADES)最小化遗憾差距。

🔬 方法详解

问题定义:论文旨在解决多智能体模仿学习中,现有方法对策略性智能体偏差鲁棒性不足的问题。现有方法主要关注价值差距,即学习者策略与专家策略的价值差异,但在策略性智能体存在的情况下,即使价值差距很小,智能体也可能通过偏离学习者的推荐来最大化自身利益,导致整体性能下降。因此,需要一种更鲁棒的MAIL目标,能够显式考虑智能体的潜在偏差。

核心思路:论文的核心思路是将MAIL的目标从最小化价值差距转变为最小化遗憾差距。遗憾差距衡量的是,在给定学习者策略的情况下,智能体通过偏离推荐策略所能获得的额外收益。通过最小化遗憾差距,可以确保学习者策略对智能体的策略性行为具有更强的鲁棒性。这种思路的关键在于考虑了智能体的反事实行为,即在学习者推荐之外的行为。

技术框架:论文提出了两种算法来最小化遗憾差距:MALICE和BLADES。MALICE算法基于专家覆盖假设,即专家策略能够覆盖所有可能的状态和动作。BLADES算法则假设可以查询专家,即可以向专家询问在任意状态下的最优策略。两种算法都将MAIL问题归约到无遗憾在线凸优化问题,利用现有的在线学习算法来学习策略。整体流程包括:1) 收集专家演示数据;2) 利用MALICE或BLADES算法,基于在线凸优化学习策略;3) 在多智能体环境中部署学习到的策略。

关键创新:论文最重要的技术创新在于提出了基于遗憾差距的MAIL目标。与传统的基于价值差距的方法相比,遗憾差距能够更准确地衡量学习者策略的鲁棒性,并显式考虑了智能体的策略性行为。此外,论文还提出了两种有效的算法(MALICE和BLADES)来最小化遗憾差距,为解决策略性多智能体模仿学习问题提供了新的思路。

关键设计:MALICE算法的关键设计在于利用专家覆盖假设,将遗憾差距的计算转化为一个可解的优化问题。BLADES算法的关键设计在于利用可查询专家,通过查询专家策略来估计遗憾差距。两种算法都使用了在线凸优化框架,并选择了合适的损失函数和正则化项,以保证算法的收敛性和泛化能力。具体的参数设置和网络结构取决于具体的应用场景和智能体模型。

🖼️ 关键图片

📊 实验亮点

论文证明了即使价值等价也不能保证遗憾等价,突出了遗憾差距的重要性。MALICE和BLADES算法通过在线凸优化有效最小化遗憾差距,在模拟实验中表现出优于传统方法的性能,尤其是在策略性智能体存在的情况下,鲁棒性得到显著提升。具体的性能提升幅度取决于具体的实验设置和智能体模型。

🎯 应用场景

该研究成果可应用于自动驾驶、机器人协作、资源分配等领域。例如,在自动驾驶中,可以利用该方法训练车辆的驾驶策略,使其能够应对其他车辆的策略性行为,提高交通安全和效率。在机器人协作中,可以训练机器人团队的协作策略,使其能够应对其他机器人的潜在偏差,实现更高效的任务完成。在资源分配中,可以设计公平的分配机制,防止参与者的策略性行为导致资源分配不均。

📄 摘要(原文)

We study a multi-agent imitation learning (MAIL) problem where we take the perspective of a learner attempting to coordinate a group of agents based on demonstrations of an expert doing so. Most prior work in MAIL essentially reduces the problem to matching the behavior of the expert within the support of the demonstrations. While doing so is sufficient to drive the value gap between the learner and the expert to zero under the assumption that agents are non-strategic, it does not guarantee robustness to deviations by strategic agents. Intuitively, this is because strategic deviations can depend on a counterfactual quantity: the coordinator's recommendations outside of the state distribution their recommendations induce. In response, we initiate the study of an alternative objective for MAIL in Markov Games we term the regret gap that explicitly accounts for potential deviations by agents in the group. We first perform an in-depth exploration of the relationship between the value and regret gaps. First, we show that while the value gap can be efficiently minimized via a direct extension of single-agent IL algorithms, even value equivalence can lead to an arbitrarily large regret gap. This implies that achieving regret equivalence is harder than achieving value equivalence in MAIL. We then provide a pair of efficient reductions to no-regret online convex optimization that are capable of minimizing the regret gap (a) under a coverage assumption on the expert (MALICE) or (b) with access to a queryable expert (BLADES).