Reflective Policy Optimization

作者: Yaozhong Gan, Renye Yan, Zhe Wu, Junliang Xing

分类: cs.LG, cs.AI, stat.ML

发布日期: 2024-06-06

备注: 20 pages

🔗 代码/项目: GITHUB

💡 一句话要点

提出反射策略优化RPO,提升on-policy强化学习的样本效率

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 On-policy 策略优化 样本效率 反射学习

📋 核心要点

- On-policy强化学习方法(如TRPO和PPO)每次更新需要大量数据,导致样本效率低下,这是核心问题。

- RPO的核心思想是融合过去和未来的状态-动作信息,使智能体能够反思并改进当前状态下的动作选择。

- 实验结果表明,RPO在强化学习基准测试中表现出可行性和有效性,并显著提高了样本效率。

📝 摘要(中文)

本文提出反射策略优化(RPO),一种新颖的on-policy强化学习扩展方法,它融合了过去和未来的状态-动作信息以进行策略优化。这种方法使智能体能够进行自省,从而允许在当前状态下修改其动作。理论分析证实,策略性能单调提升并收缩解空间,从而加速收敛过程。经验结果表明RPO在两个强化学习基准测试中的可行性和有效性,最终实现了卓越的样本效率。该工作的源代码可在https://github.com/Edgargan/RPO 获取。

🔬 方法详解

问题定义:现有的on-policy强化学习算法,如TRPO和PPO,在策略更新时需要大量的样本数据,导致样本效率较低。这意味着智能体需要与环境进行大量的交互才能学习到有效的策略,这在实际应用中是一个很大的限制,尤其是在与真实环境交互成本较高的情况下。因此,如何提高on-policy算法的样本效率是一个重要的研究问题。

核心思路:RPO的核心思路是让智能体能够“反思”其行为,即利用过去和未来的状态-动作信息来改进当前的策略。通过融合这些信息,智能体可以更好地理解当前状态的长期影响,并做出更明智的决策。这种“反思”机制允许智能体在当前状态下修改其动作,从而更有效地探索环境并学习最优策略。

技术框架:RPO的整体框架可以概括为以下几个步骤:1. 智能体与环境交互,收集状态、动作和奖励序列。2. 利用收集到的数据,构建一个“反射”模型,该模型能够融合过去和未来的信息。3. 使用反射模型来改进当前的策略,使其能够更好地利用历史和未来的信息。4. 使用改进后的策略与环境交互,重复以上步骤。这个过程类似于一个循环,智能体不断地通过与环境交互和反思来改进其策略。

关键创新:RPO最关键的创新点在于引入了“反射”机制,允许智能体利用过去和未来的信息来改进当前的策略。这与传统的on-policy算法不同,后者通常只关注当前状态的信息。通过融合过去和未来的信息,RPO能够更有效地探索环境并学习最优策略。此外,理论分析表明,RPO能够保证策略性能的单调提升,并收缩解空间,从而加速收敛过程。

关键设计:RPO的关键设计包括如何构建和训练“反射”模型。一种可能的方法是使用循环神经网络(RNN)来处理过去和未来的状态-动作序列。RNN可以有效地捕捉序列数据中的时间依赖关系,从而更好地理解环境的动态特性。此外,损失函数的设计也很重要。一种可能的损失函数是最大化策略的期望回报,同时鼓励策略的平滑性,以避免策略的剧烈变化。

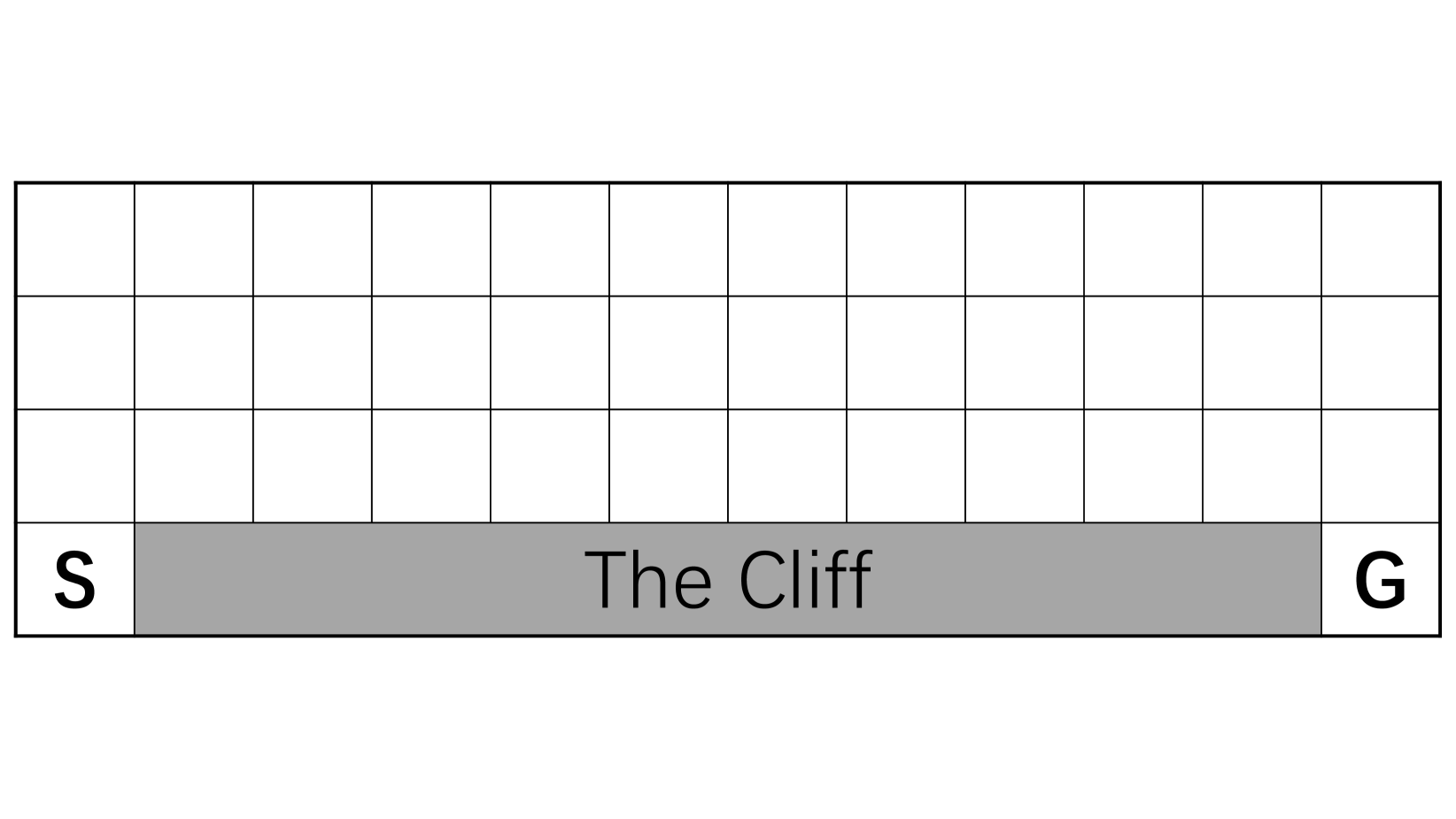

🖼️ 关键图片

📊 实验亮点

RPO在两个强化学习基准测试中进行了评估,结果表明RPO能够显著提高样本效率。具体来说,RPO在达到相同的性能水平时,所需的样本数量明显少于传统的on-policy算法,如TRPO和PPO。这表明RPO能够更有效地利用数据,从而更快地学习到有效的策略。此外,实验结果还表明,RPO具有良好的稳定性和鲁棒性,能够在不同的环境中表现出良好的性能。

🎯 应用场景

RPO具有广泛的应用前景,尤其是在需要高样本效率的强化学习任务中。例如,在机器人控制领域,与真实机器人交互的成本很高,因此需要高效的强化学习算法。RPO可以帮助机器人更快地学习到有效的控制策略,从而降低开发成本。此外,RPO还可以应用于游戏AI、自动驾驶等领域,提高智能体的学习效率和性能。未来,RPO有望成为一种通用的强化学习算法,应用于各种实际问题。

📄 摘要(原文)

On-policy reinforcement learning methods, like Trust Region Policy Optimization (TRPO) and Proximal Policy Optimization (PPO), often demand extensive data per update, leading to sample inefficiency. This paper introduces Reflective Policy Optimization (RPO), a novel on-policy extension that amalgamates past and future state-action information for policy optimization. This approach empowers the agent for introspection, allowing modifications to its actions within the current state. Theoretical analysis confirms that policy performance is monotonically improved and contracts the solution space, consequently expediting the convergence procedure. Empirical results demonstrate RPO's feasibility and efficacy in two reinforcement learning benchmarks, culminating in superior sample efficiency. The source code of this work is available at https://github.com/Edgargan/RPO.