Fine-Grained Causal Dynamics Learning with Quantization for Improving Robustness in Reinforcement Learning

作者: Inwoo Hwang, Yunhyeok Kwak, Suhyung Choi, Byoung-Tak Zhang, Sanghack Lee

分类: cs.LG, cs.AI

发布日期: 2024-06-05

备注: ICML 2024

💡 一句话要点

提出基于量化的细粒度因果动力学学习方法,提升强化学习的鲁棒性

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 因果动力学学习 强化学习 鲁棒性 细粒度推理 状态空间量化

📋 核心要点

- 现有因果动力学学习方法忽略了因果关系通常仅在特定上下文中显现的细粒度特征,缺乏对动力学的深入理解。

- 论文提出一种新的动力学模型,通过离散潜在变量量化状态-动作空间,学习细粒度的因果结构,用于更准确的预测。

- 实验结果表明,该方法在处理未见状态和局部虚假相关性时表现出更强的鲁棒性,尤其是在需要细粒度因果推理的任务中。

📝 摘要(中文)

本文提出了一种新的动力学模型,该模型能够推断细粒度的因果结构并将其用于预测,从而提高强化学习的鲁棒性。核心思想是联合学习动力学模型和一个离散潜在变量,该变量将状态-动作空间量化为子群。这有助于识别显示稀疏依赖关系的有意义的上下文,并在训练过程中为每个子群学习因果结构。实验结果表明,该方法在下游任务中对未见状态和局部虚假相关性的鲁棒性更强,尤其是在细粒度因果推理至关重要的情况下。此外,还展示了基于子群的量化方法在发现细粒度因果关系方面的有效性,优于现有方法。

🔬 方法详解

问题定义:现有因果动力学学习方法在构建动力学模型时,未能充分考虑因果关系在不同上下文中的差异性,即忽略了细粒度的因果依赖关系。这导致模型在面对未见状态或局部虚假相关性时,鲁棒性较差。因此,需要一种能够捕捉细粒度因果结构的动力学模型,以提升强化学习的鲁棒性。

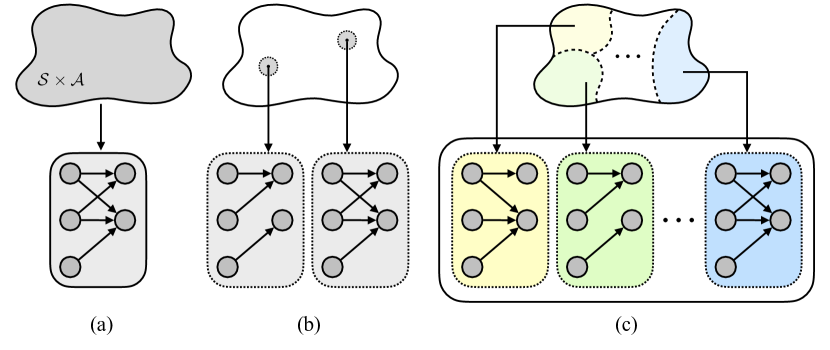

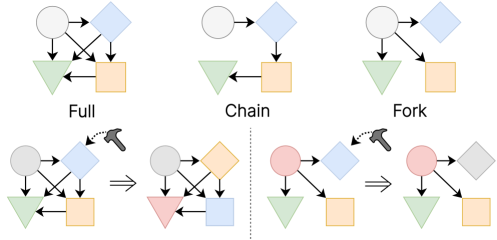

核心思路:论文的核心思路是通过引入一个离散潜在变量来量化状态-动作空间,将状态-动作空间划分为多个子群。每个子群代表一种特定的上下文,模型为每个子群学习独立的因果结构。这样,模型就能够捕捉到因果关系在不同上下文中的差异,从而实现细粒度的因果推理。

技术框架:该方法包含以下主要模块:1) 状态-动作空间量化模块:使用离散潜在变量将状态-动作空间划分为多个子群。2) 因果结构学习模块:为每个子群学习独立的因果结构。3) 动力学预测模块:基于学习到的因果结构,预测下一个状态。整体流程是,首先将状态-动作输入到量化模块,得到对应的子群。然后,根据该子群的因果结构,预测下一个状态。

关键创新:最重要的技术创新点是联合学习动力学模型和离散潜在变量,从而实现状态-动作空间的量化。与现有方法相比,该方法能够捕捉到因果关系在不同上下文中的差异,从而实现细粒度的因果推理。现有方法通常假设因果关系是全局一致的,忽略了其上下文依赖性。

关键设计:关键设计包括:1) 离散潜在变量的维度:需要根据具体任务进行调整,以平衡量化的粒度和计算复杂度。2) 因果结构学习算法:可以使用现有的因果发现算法,如PC算法或GES算法。3) 损失函数:需要包含动力学预测损失和量化损失,以保证模型的预测精度和量化的有效性。量化损失可以采用KL散度等方法,鼓励潜在变量的分布具有稀疏性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在多个强化学习任务中都取得了显著的性能提升。例如,在存在局部虚假相关性的任务中,该方法的鲁棒性明显优于现有方法。具体而言,该方法能够识别并忽略虚假相关性,从而做出更准确的预测。此外,实验还验证了该方法在发现细粒度因果关系方面的有效性,其学习到的因果结构更符合实际情况。

🎯 应用场景

该研究成果可应用于需要鲁棒性和可解释性的强化学习任务中,例如自动驾驶、机器人控制和医疗诊断。通过学习细粒度的因果关系,模型能够更好地理解环境,并在面对复杂和不确定的情况时做出更合理的决策。未来,该方法有望扩展到更复杂的环境和任务中,并与其他强化学习技术相结合,进一步提升智能系统的性能。

📄 摘要(原文)

Causal dynamics learning has recently emerged as a promising approach to enhancing robustness in reinforcement learning (RL). Typically, the goal is to build a dynamics model that makes predictions based on the causal relationships among the entities. Despite the fact that causal connections often manifest only under certain contexts, existing approaches overlook such fine-grained relationships and lack a detailed understanding of the dynamics. In this work, we propose a novel dynamics model that infers fine-grained causal structures and employs them for prediction, leading to improved robustness in RL. The key idea is to jointly learn the dynamics model with a discrete latent variable that quantizes the state-action space into subgroups. This leads to recognizing meaningful context that displays sparse dependencies, where causal structures are learned for each subgroup throughout the training. Experimental results demonstrate the robustness of our method to unseen states and locally spurious correlations in downstream tasks where fine-grained causal reasoning is crucial. We further illustrate the effectiveness of our subgroup-based approach with quantization in discovering fine-grained causal relationships compared to prior methods.