Pruner-Zero: Evolving Symbolic Pruning Metric from scratch for Large Language Models

作者: Peijie Dong, Lujun Li, Zhenheng Tang, Xiang Liu, Xinglin Pan, Qiang Wang, Xiaowen Chu

分类: cs.LG, cs.CL, cs.NE

发布日期: 2024-06-05

备注: Accepted by ICML2024, 29 pages, 4 figures

🔗 代码/项目: GITHUB

💡 一句话要点

Pruner-Zero:从零进化大语言模型符号剪枝指标,无需人工干预。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 模型剪枝 后训练剪枝 遗传编程 符号回归

📋 核心要点

- 大型语言模型剪枝面临无需重训练的挑战,现有方法依赖人工设计剪枝指标,效率低且依赖专家知识。

- Pruner-Zero 提出基于遗传编程的自动搜索框架,从头进化符号剪枝指标,无需人工干预。

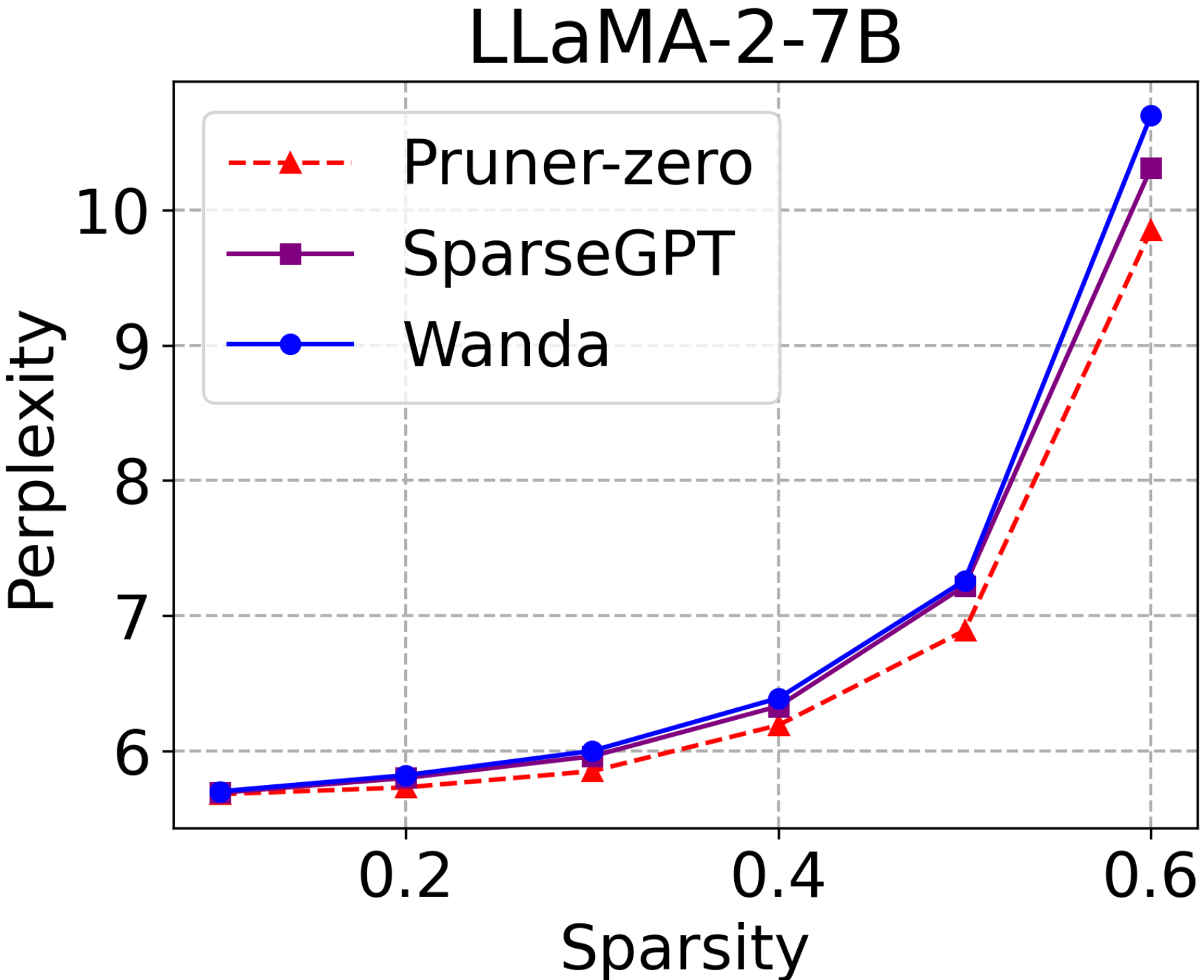

- 实验表明,Pruner-Zero 在 LLaMA 和 LLaMA-2 上优于 SOTA 后训练剪枝方法,提升了模型性能。

📝 摘要(中文)

大型语言模型(LLMs)因其庞大的规模面临部署挑战。剪枝方法通过删除部分权重来加速模型,但许多方法需要重新训练,这既昂贵又耗费计算资源。最近,后训练剪枝方法引入了新的指标,无需重新训练即可剪枝LLMs。然而,这些指标需要人类专家的参与和繁琐的试错。为了高效地识别更优的剪枝指标,我们开发了一个自动框架,使用遗传编程搜索符号剪枝指标。特别地,我们设计了一个包含现有剪枝指标的精细搜索空间,以发现潜在的符号剪枝指标。我们提出了一种相反操作简化策略,以增加种群的多样性。通过这种方式,Pruner-Zero 允许自动生成符号剪枝指标。基于搜索结果,我们探索了剪枝指标与剪枝后性能之间的相关性,并总结了一些原则。在LLaMA和LLaMA-2上进行的语言建模和零样本任务的大量实验表明,我们的Pruner-Zero获得了优于SOTA后训练剪枝方法的性能。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)剪枝过程中,对人工设计和调整剪枝指标的依赖问题。现有的后训练剪枝方法虽然避免了昂贵的重训练过程,但仍然需要人工参与设计剪枝指标,这需要大量的试错和专家知识,效率低下且难以找到最优解。

核心思路:论文的核心思路是利用遗传编程自动搜索最优的符号剪枝指标。通过定义一个包含现有剪枝指标的搜索空间,并使用遗传算法在其中进行搜索,从而自动发现能够有效剪枝LLMs且无需重训练的指标。这种方法避免了人工设计的局限性,能够更高效地找到更优的剪枝策略。

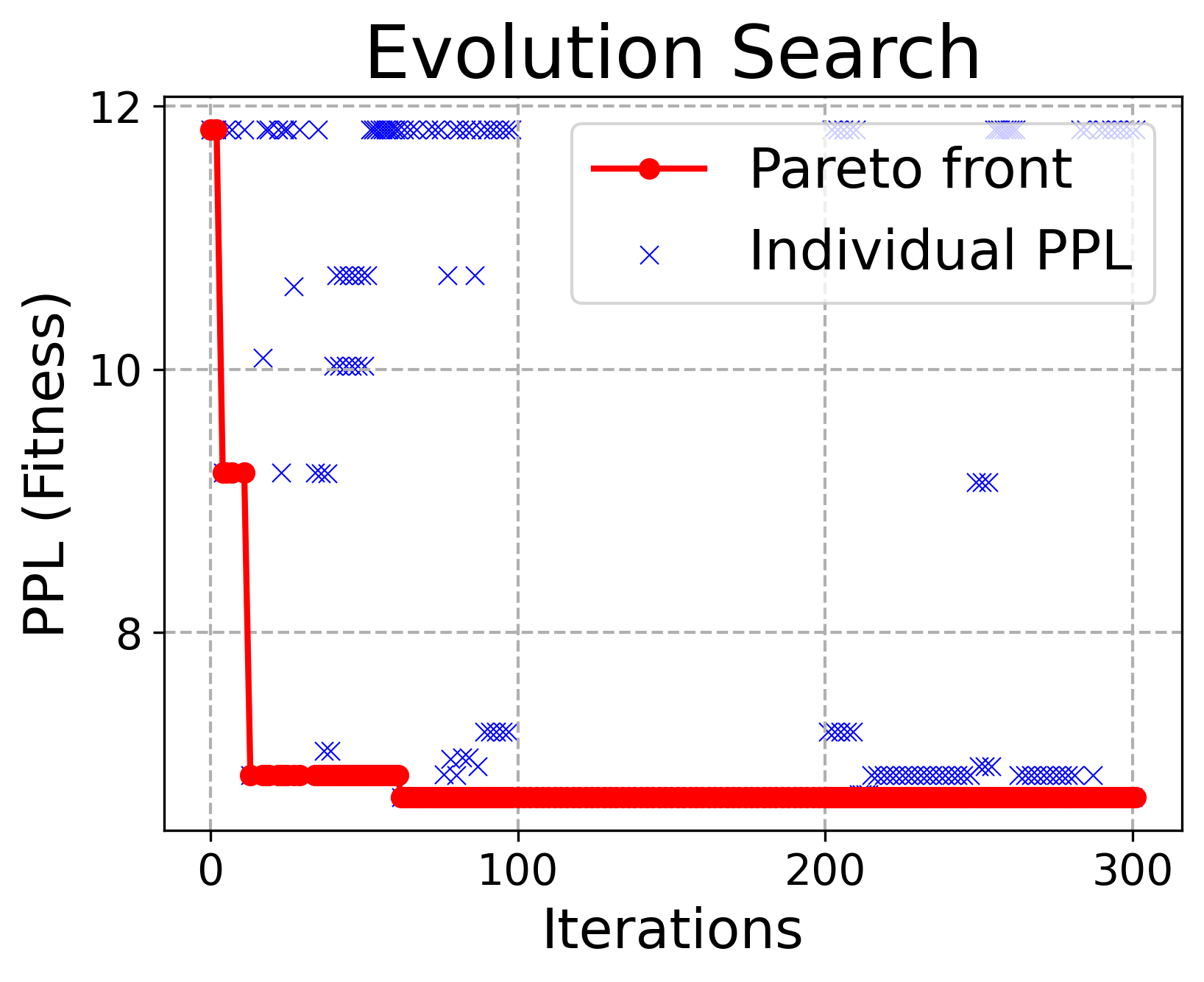

技术框架:Pruner-Zero 的整体框架包括以下几个主要模块:1) 搜索空间定义:定义包含现有剪枝指标的符号表达式作为搜索空间。2) 遗传编程:使用遗传算法在搜索空间中进化剪枝指标,包括选择、交叉和变异等操作。3) 评估函数:使用剪枝后的模型在验证集上的性能作为评估函数,指导遗传算法的搜索方向。4) 简化策略:提出一种相反操作简化策略,增加种群的多样性,避免陷入局部最优。

关键创新:Pruner-Zero 的最重要创新点在于实现了剪枝指标的自动生成,无需人工干预。与现有方法相比,它能够更高效地探索剪枝指标空间,找到更优的剪枝策略。此外,提出的相反操作简化策略也提高了搜索效率和结果的多样性。

关键设计:在搜索空间设计方面,论文精心设计了包含现有剪枝指标的符号表达式,例如权重幅度、激活值等。在遗传算法方面,使用了交叉和变异等操作来生成新的剪枝指标。在评估函数方面,使用了剪枝后的模型在验证集上的性能作为评估标准。此外,相反操作简化策略通过将表达式中的操作符替换为其相反操作符来增加种群的多样性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Pruner-Zero 在 LLaMA 和 LLaMA-2 上取得了优于 SOTA 后训练剪枝方法的性能。在语言建模任务和零样本任务上,Pruner-Zero 均表现出显著的优势,证明了其自动搜索剪枝指标的有效性。具体性能数据在论文中详细展示,相较于现有方法有明显的提升。

🎯 应用场景

Pruner-Zero 的应用场景广泛,可用于加速和压缩大型语言模型,降低部署成本,使其能够在资源受限的设备上运行。该研究成果对于推动LLMs在移动设备、边缘计算等领域的应用具有重要意义,并能促进AI技术的普及。

📄 摘要(原文)

Despite the remarkable capabilities, Large Language Models (LLMs) face deployment challenges due to their extensive size. Pruning methods drop a subset of weights to accelerate, but many of them require retraining, which is prohibitively expensive and computationally demanding. Recently, post-training pruning approaches introduced novel metrics, enabling the pruning of LLMs without retraining. However, these metrics require the involvement of human experts and tedious trial and error. To efficiently identify superior pruning metrics, we develop an automatic framework for searching symbolic pruning metrics using genetic programming. In particular, we devise an elaborate search space encompassing the existing pruning metrics to discover the potential symbolic pruning metric. We propose an opposing operation simplification strategy to increase the diversity of the population. In this way, Pruner-Zero allows auto-generation of symbolic pruning metrics. Based on the searched results, we explore the correlation between pruning metrics and performance after pruning and summarize some principles. Extensive experiments on LLaMA and LLaMA-2 on language modeling and zero-shot tasks demonstrate that our Pruner-Zero obtains superior performance than SOTA post-training pruning methods. Code at: \url{https://github.com/pprp/Pruner-Zero}.