Language Models Do Hard Arithmetic Tasks Easily and Hardly Do Easy Arithmetic Tasks

作者: Andrew Gambardella, Yusuke Iwasawa, Yutaka Matsuo

分类: cs.LG, cs.AI, cs.CL

发布日期: 2024-06-04

备注: In Proceedings of the 62nd Annual Meeting of the Association for Computational Linguistics (Volume 2: Short Papers)

💡 一句话要点

大语言模型擅长复杂算术首位预测,却不擅长简单算术末位预测

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 算术能力 条件预测 置信度提升 难易倒置

📋 核心要点

- 大型语言模型在算术任务中表现出反直觉的现象:复杂乘法首位预测准确,简单乘法末位预测较差。

- 论文提出通过提供高位正确答案作为条件,来提升LLM对低位(尤其是末位)算术结果的预测置信度。

- 实验表明,在提供高位正确答案后,Llama 2-13B和Mistral-7B模型在5位数乘法末位预测的置信度显著提升。

📝 摘要(中文)

大型语言模型(LLM)执行算术任务的能力一直是理论和实践争论的主题。本文表明,LLM通常能够正确且自信地预测n位数乘以m位数乘法任务的首位数字,而无需使用思维链推理,尽管这些任务需要复合运算才能解决。与此同时,LLM在实践中经常无法正确或自信地预测n位数乘以m位数乘法的末位数字,这项任务等同于一位数乘以一位数的乘法,可以很容易地学习或记忆。本文表明,当LLM以所有正确的高阶数字为条件时,后一项任务可以更稳健地解决,这平均而言将使用Llama 2-13B的5位数乘以5位数乘法任务中正确末位数字的置信度提高了230%以上(从0.13到0.43),使用Mistral-7B提高了150%(从0.22到0.55)。

🔬 方法详解

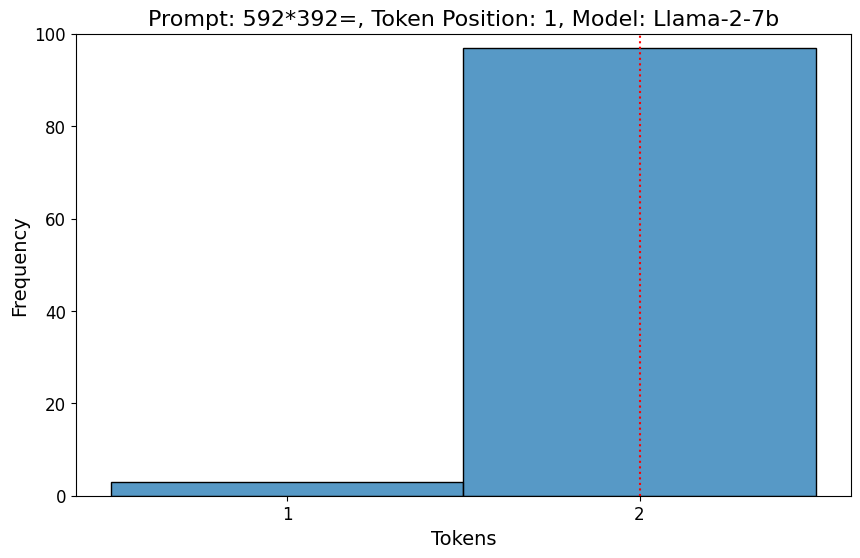

问题定义:论文旨在研究大型语言模型(LLM)在执行算术任务时的能力差异。现有研究表明LLM在某些复杂算术任务上表现良好,但论文发现LLM在简单算术任务(如个位数乘法,即预测乘法结果的最后一位)上的表现却不尽如人意。这种反直觉的现象表明LLM可能并非通过传统算术方法解决问题,而是依赖于其他机制,例如模式匹配或记忆。

核心思路:论文的核心思路是,LLM在预测算术结果的低位数字时,可能受到高位数字的影响。因此,如果将正确的高位数字作为条件提供给LLM,可以引导LLM更准确地预测低位数字。这种方法类似于人类在进行复杂计算时,会逐步分解问题,并利用中间结果来辅助后续计算。

技术框架:论文采用了一种条件预测的方法。具体来说,对于n位数乘以m位数的乘法任务,首先要求LLM预测完整的结果。然后,将正确的高位数字(例如,十位、百位等)作为条件,重新输入LLM,要求其预测个位数字。通过比较在有无高位数字条件下的预测结果,评估高位数字对低位数字预测的影响。

关键创新:论文的关键创新在于发现了LLM在算术任务中表现出的“难易倒置”现象,并提出了一种基于条件预测的方法来改善LLM在简单算术任务中的表现。这种方法揭示了LLM在解决算术问题时可能存在的偏差,并提供了一种有效的纠正方法。

关键设计:论文使用了Llama 2-13B和Mistral-7B两种大型语言模型进行实验。实验中,主要关注5位数乘以5位数的乘法任务。通过比较在有无高位数字条件下的个位数字预测置信度,评估了条件预测方法的效果。置信度是通过模型输出的softmax概率来衡量的。具体来说,论文计算了模型预测正确个位数字的平均softmax概率,并将其作为置信度的指标。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在提供高位正确答案作为条件后,Llama 2-13B模型在5位数乘法末位预测的置信度从0.13提升至0.43,提升幅度超过230%。Mistral-7B模型的置信度从0.22提升至0.55,提升幅度达到150%。这些数据表明,条件预测方法能够显著改善LLM在简单算术任务中的表现。

🎯 应用场景

该研究成果可应用于提升大语言模型在需要精确计算的场景中的可靠性,例如金融分析、科学计算等领域。通过对LLM进行针对性的调优,可以使其在处理涉及算术运算的任务时更加准确和稳定。此外,该研究也为理解LLM的内部工作机制提供了新的视角,有助于开发更高效、更可靠的AI系统。

📄 摘要(原文)

The ability (and inability) of large language models (LLMs) to perform arithmetic tasks has been the subject of much theoretical and practical debate. We show that LLMs are frequently able to correctly and confidently predict the first digit of n-digit by m-digit multiplication tasks without using chain of thought reasoning, despite these tasks require compounding operations to solve. Simultaneously, LLMs in practice often fail to correctly or confidently predict the last digit of an n-digit by m-digit multiplication, a task equivalent to 1-digit by 1-digit multiplication which can be easily learned or memorized. We show that the latter task can be solved more robustly when the LLM is conditioned on all of the correct higher-order digits, which on average increases the confidence of the correct last digit on 5-digit by 5-digit multiplication tasks using Llama 2-13B by over 230% (0.13 to 0.43) and Mistral-7B by 150% (0.22 to 0.55).