A Sim2Real Approach for Identifying Task-Relevant Properties in Interpretable Machine Learning

作者: Eura Nofshin, Esther Brown, Brian Lim, Weiwei Pan, Finale Doshi-Velez

分类: cs.HC, cs.LG

发布日期: 2024-05-31 (更新: 2024-09-18)

💡 一句话要点

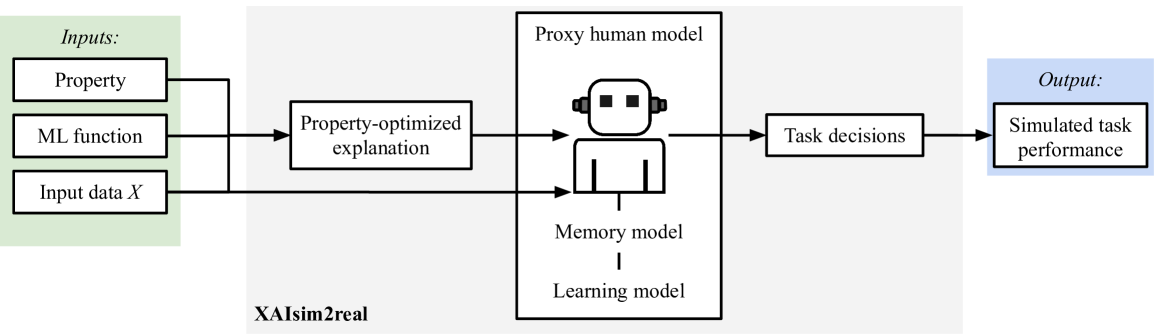

提出XAIsim2real,通过模拟用户研究优化可解释机器学习中的任务相关属性识别。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 可解释机器学习 人机协作 模拟用户研究 解释属性 任务相关性

📋 核心要点

- 现有方法难以针对不同下游任务高效地选择最佳AI解释,用户研究成本高昂且耗时。

- XAIsim2real通过合成用户研究,根据解释的属性预测用户偏好,从而优化解释选择。

- 实验表明,XAIsim2real能准确预测用户偏好,并揭示认知负荷对解释有效性的影响。

📝 摘要(中文)

人工智能解释可以辅助人类决策者,但最有用的解释取决于决策的上下文,即下游任务。用户研究对于确定每个任务的最佳解释至关重要。然而,测试每种解释和任务的组合是不切实际的,尤其是在考虑到影响人机协作的诸多因素(解释内容之外)时。本文利用两个洞察来简化寻找最有效解释的过程。首先,解释可以通过属性(如忠实性或复杂性)来表征,这些属性表明它们是否包含任务所需的正确信息。其次,我们引入了XAIsim2real,一个用于运行合成用户研究的流程。在我们的验证研究中,XAIsim2real准确地预测了用户在三个任务中的偏好,使其成为在全面研究之前改进解释选择的宝贵工具。此外,它还揭示了细微的关系,例如认知预算如何限制用户对复杂解释的参与——这一趋势已通过真实用户得到证实。

🔬 方法详解

问题定义:现有可解释机器学习(XAI)方法在为特定任务选择最佳解释时面临挑战。针对每种可能的解释和任务组合进行用户研究是不切实际的,因为用户研究成本高昂且耗时。此外,影响人机协作的因素众多,使得找到最有效的解释变得更加困难。现有方法缺乏一种高效、低成本的方式来评估不同解释在不同任务中的有效性。

核心思路:本文的核心思路是利用模拟用户研究来预测真实用户的偏好。通过将解释的属性(如忠实性、复杂性等)与任务需求联系起来,并构建一个模拟用户模型,可以快速评估不同解释在特定任务中的有效性。这种方法避免了直接进行大规模真实用户研究的需要,从而降低了成本和时间。

技术框架:XAIsim2real 包含以下主要阶段:1) 解释属性提取:从不同的解释方法中提取关键属性,如忠实性、完整性、简洁性等。2) 任务定义:明确定义下游任务,并确定任务对解释属性的需求。3) 模拟用户建模:构建一个模拟用户模型,该模型根据解释属性和任务需求来预测用户偏好。4) 合成用户研究:使用模拟用户模型生成合成用户数据,评估不同解释在不同任务中的表现。5) 真实用户验证:通过小规模的真实用户研究来验证模拟用户研究的有效性。

关键创新:XAIsim2real 的关键创新在于它提出了一种基于模拟用户研究的XAI评估方法。与传统的真实用户研究相比,XAIsim2real 能够以更低的成本和更高的效率评估不同解释在不同任务中的有效性。此外,XAIsim2real 能够揭示解释属性与任务需求之间的细微关系,从而帮助研究人员更好地理解人机协作的机制。

关键设计:在模拟用户建模方面,论文可能采用了基于规则、基于效用函数或基于机器学习的方法来模拟用户的决策过程。关键参数可能包括解释属性的权重、任务需求的量化指标以及模拟用户的认知能力等。损失函数的设计可能旨在最小化模拟用户偏好与真实用户偏好之间的差异。具体的网络结构(如果使用)以及其他技术细节在论文中可能有所描述,但此处未知。

🖼️ 关键图片

📊 实验亮点

XAIsim2real 在三个任务中准确预测了用户偏好,验证了其有效性。研究还揭示了认知预算对用户参与复杂解释的影响,这与真实用户研究的结果相符。这些结果表明,XAIsim2real 是一种有价值的工具,可以在全面研究之前改进解释选择。

🎯 应用场景

该研究成果可应用于各种人机协作场景,例如医疗诊断、金融风险评估和自动驾驶等。通过XAIsim2real,可以针对特定任务选择最有效的AI解释,提高用户对AI系统的信任度和采纳度,并最终提升决策质量。该方法还有助于开发更易于理解和使用的AI系统。

📄 摘要(原文)

Explanations of an AI's function can assist human decision-makers, but the most useful explanation depends on the decision's context, referred to as the downstream task. User studies are necessary to determine the best explanations for each task. Unfortunately, testing every explanation and task combination is impractical, especially considering the many factors influencing human+AI collaboration beyond the explanation's content. This work leverages two insights to streamline finding the most effective explanation. First, explanations can be characterized by properties, such as faithfulness or complexity, which indicate if they contain the right information for the task. Second, we introduce XAIsim2real, a pipeline for running synthetic user studies. In our validation study, XAIsim2real accurately predicts user preferences across three tasks, making it a valuable tool for refining explanation choices before full studies. Additionally, it uncovers nuanced relationships, like how cognitive budget limits a user's engagement with complex explanations -- a trend confirmed with real users.