Algorithmic Fairness in Performative Policy Learning: Escaping the Impossibility of Group Fairness

作者: Seamus Somerstep, Ya'acov Ritov, Yuekai Sun

分类: stat.ML, cs.CY, cs.LG

发布日期: 2024-05-30

💡 一句话要点

利用策略学习中的表现性,解决群体公平性困境

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 算法公平性 表现性策略学习 群体公平性 策略干预 社会分类 机器学习 优化算法

📋 核心要点

- 现有算法公平性方法在表现性环境中面临挑战,因为预测模型会反过来影响数据分布,导致公平性目标难以实现。

- 该论文提出利用决策者的策略学习能力,主动引导人群行为,从而在长期内改善群体公平性,而非被动适应数据分布。

- 该方法能够有效解决不同群体公平性定义之间的冲突,在表现性环境中实现比传统方法更强的公平性保证。

📝 摘要(中文)

在许多预测问题中,预测模型会影响预测目标的分布,这种现象被称为表现性,通常由对预测模型结果有既得利益的个体行为引起。虽然表现性通常会带来分布偏移问题,但我们开发了算法公平性实践,利用表现性在社会分类问题中实现更强的群体公平性保证(与非表现性设置中可实现的相比)。 特别是,我们利用决策者引导人群的能力来长期补救不平等。 这种方法的一个关键好处是,它可以解决相互冲突的群体公平性定义之间的不兼容性。

🔬 方法详解

问题定义:论文旨在解决在具有表现性的策略学习环境中,如何实现群体公平性的问题。现有方法通常假设数据分布是固定的,但在表现性环境中,预测模型本身会影响数据分布,导致传统的公平性定义和算法失效。此外,不同的群体公平性定义之间可能存在冲突,使得同时满足所有公平性目标变得不可能。

核心思路:论文的核心思路是利用决策者的策略学习能力,将公平性目标融入到策略设计中,主动引导人群行为,从而改变数据分布,最终实现长期的群体公平性。这种方法不再是被动地适应数据分布,而是主动地塑造数据分布,从而克服了传统方法的局限性。

技术框架:论文提出的技术框架包含以下几个主要阶段:1) 建立一个表现性策略学习模型,该模型能够模拟预测模型对数据分布的影响;2) 定义一个包含公平性目标的优化问题,该问题旨在找到一个能够最大化效用并满足公平性约束的策略;3) 设计一种算法来求解该优化问题,该算法能够有效地探索策略空间,并找到一个满足公平性目标的策略。

关键创新:论文最重要的技术创新点在于,它将表现性视为一种资源,而非一种障碍。通过利用表现性,决策者可以主动引导人群行为,从而实现比传统方法更强的群体公平性保证。此外,该方法能够解决不同群体公平性定义之间的冲突,使得同时满足多个公平性目标成为可能。

关键设计:论文的关键设计包括:1) 选择合适的表现性策略学习模型,该模型需要能够准确地模拟预测模型对数据分布的影响;2) 定义合适的公平性度量,该度量需要能够反映不同群体之间的不平等程度;3) 设计高效的优化算法,该算法需要能够有效地探索策略空间,并找到一个满足公平性目标的策略。具体的参数设置、损失函数和网络结构等技术细节取决于具体的应用场景。

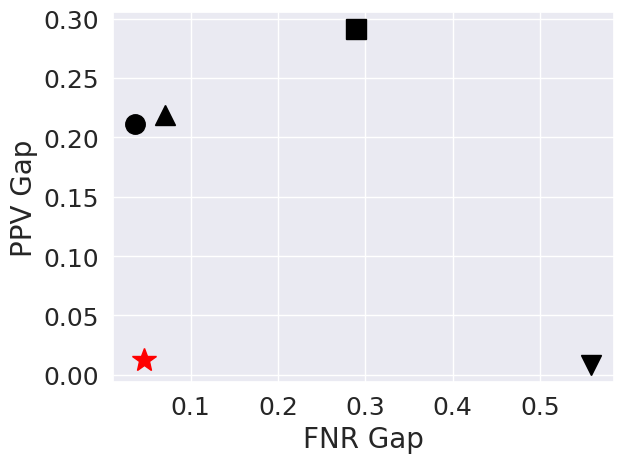

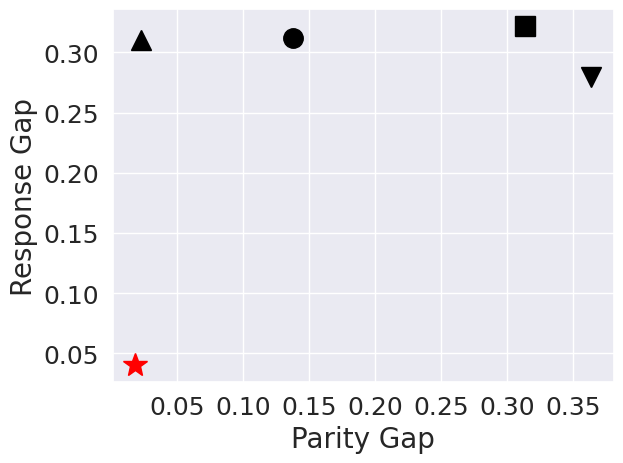

🖼️ 关键图片

📊 实验亮点

论文通过理论分析和实验验证,证明了所提出的方法在表现性环境中能够实现比传统方法更强的群体公平性保证。实验结果表明,该方法能够有效地解决不同群体公平性定义之间的冲突,并在多个数据集上取得了显著的性能提升。具体的性能数据和对比基线在论文中有详细描述。

🎯 应用场景

该研究成果可应用于各种社会分类问题,例如信贷评分、招聘、教育资源分配等。通过利用策略学习中的表现性,可以设计出更公平的策略,从而减少社会不平等,提高社会福利。该研究对于构建更公平、更公正的社会具有重要的实际价值和深远的影响。

📄 摘要(原文)

In many prediction problems, the predictive model affects the distribution of the prediction target. This phenomenon is known as performativity and is often caused by the behavior of individuals with vested interests in the outcome of the predictive model. Although performativity is generally problematic because it manifests as distribution shifts, we develop algorithmic fairness practices that leverage performativity to achieve stronger group fairness guarantees in social classification problems (compared to what is achievable in non-performative settings). In particular, we leverage the policymaker's ability to steer the population to remedy inequities in the long term. A crucial benefit of this approach is that it is possible to resolve the incompatibilities between conflicting group fairness definitions.