Parrot: Efficient Serving of LLM-based Applications with Semantic Variable

作者: Chaofan Lin, Zhenhua Han, Chengruidong Zhang, Yuqing Yang, Fan Yang, Chen Chen, Lili Qiu

分类: cs.LG, cs.AI

发布日期: 2024-05-30

备注: To appear on USENIX OSDI 2024

💡 一句话要点

Parrot:利用语义变量高效服务于基于LLM的应用

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 LLM应用 语义变量 端到端优化 数据流分析

📋 核心要点

- 现有公共LLM服务提供的请求级别API过于简化,导致LLM应用丢失关键的应用级别信息,无法进行端到端优化。

- Parrot提出语义变量,作为统一抽象,向LLM服务暴露应用级别知识,构建数据管道,实现LLM应用的自然编程。

- 实验结果表明,Parrot在流行的LLM应用场景中,能够实现高达一个数量级的性能提升,显著改善端到端体验。

📝 摘要(中文)

大型语言模型(LLM)的兴起催生了基于LLM的应用(又称AI代理或副驾驶),这是一种结合了LLM和传统软件优势的新型软件范式。来自不同租户的各种LLM应用可以使用多个LLM请求设计复杂的工作流程来完成一项任务。然而,它们必须使用当前公共LLM服务提供的过于简化的请求级别API,从而丢失了重要的应用级别信息。公共LLM服务不得不盲目地优化单个LLM请求,导致LLM应用的端到端性能欠佳。本文介绍了Parrot,一个专注于基于LLM的应用的端到端体验的LLM服务系统。Parrot提出了语义变量,一种统一的抽象,用于向公共LLM服务公开应用级别知识。语义变量注释请求提示中的输入/输出变量,并在连接多个LLM请求时创建数据管道,从而提供了一种自然的LLM应用编程方式。向公共LLM服务公开语义变量使其能够执行传统的数据流分析,以揭示多个LLM请求之间的相关性。这种相关性为基于LLM的应用的端到端性能开辟了一个全新的优化空间。广泛的评估表明,对于流行的和实用的LLM应用用例,Parrot可以实现高达一个数量级的改进。

🔬 方法详解

问题定义:论文旨在解决现有LLM服务在服务基于LLM的应用时,由于缺乏应用级别的上下文信息,导致端到端性能优化受限的问题。现有的请求级别API无法表达LLM请求之间的依赖关系和数据流,使得LLM服务只能独立地优化每个请求,而无法进行全局优化。

核心思路:论文的核心思路是引入“语义变量”的概念,作为一种统一的抽象,将应用级别的知识暴露给LLM服务。通过语义变量,LLM服务可以理解LLM请求之间的依赖关系、数据流和上下文信息,从而进行更有效的端到端优化。这种方法类似于传统编译器中的数据流分析,但应用于LLM应用的上下文中。

技术框架:Parrot系统的整体架构包含以下几个主要模块:1) 应用定义模块:允许开发者使用语义变量定义LLM应用的工作流程和数据依赖关系。2) 请求处理模块:负责接收和处理来自LLM应用的请求,并提取语义变量信息。3) 数据流分析模块:分析语义变量之间的依赖关系,构建数据流图。4) 优化模块:基于数据流图,进行端到端的性能优化,例如缓存、预取、并行执行等。5) LLM服务模块:与底层的LLM服务交互,执行LLM请求。

关键创新:最重要的技术创新点是“语义变量”的引入。与传统的请求级别API相比,语义变量能够表达LLM请求之间的依赖关系和数据流,从而为LLM服务提供了更多的上下文信息,使其能够进行更有效的端到端优化。这种方法类似于在LLM应用中引入了“类型系统”,使得LLM服务能够更好地理解应用的语义。

关键设计:语义变量的设计需要考虑以下几个关键因素:1) 表达能力:语义变量需要能够表达各种类型的应用级别知识,例如输入/输出变量、数据依赖关系、控制流等。2) 易用性:语义变量需要易于使用和理解,以便开发者能够轻松地定义LLM应用。3) 可扩展性:语义变量需要具有良好的可扩展性,以便支持各种类型的LLM应用和优化策略。论文中可能还涉及具体的缓存策略、预取算法、并行执行策略等优化细节,但摘要中未详细说明。

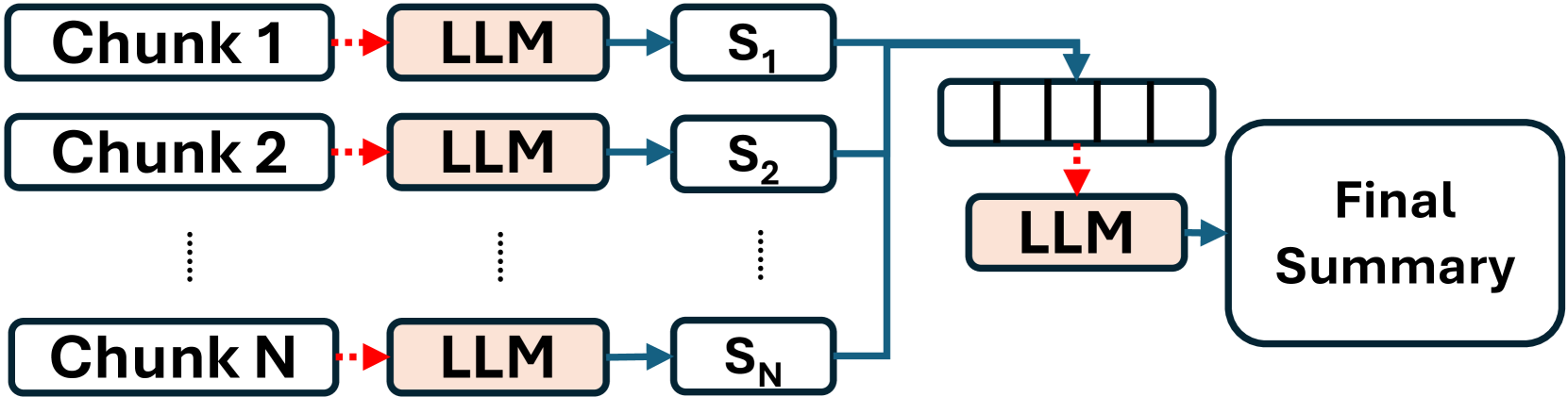

🖼️ 关键图片

📊 实验亮点

论文的实验结果表明,Parrot 在流行的LLM应用场景中,能够实现高达一个数量级的性能提升。具体的性能数据、对比基线以及提升幅度在摘要中没有详细给出,需要在论文正文中查找。但总体而言,实验结果有力地证明了 Parrot 的有效性和优越性。

🎯 应用场景

Parrot 的潜在应用领域非常广泛,包括但不限于:AI 助手、智能客服、自动化工作流、代码生成、文档摘要等。通过提升LLM应用的端到端性能,Parrot 可以显著改善用户体验,降低运营成本,并推动LLM技术在各个行业的应用。未来,Parrot 可以进一步扩展到支持更复杂的LLM应用场景,例如多模态应用、强化学习应用等。

📄 摘要(原文)

The rise of large language models (LLMs) has enabled LLM-based applications (a.k.a. AI agents or co-pilots), a new software paradigm that combines the strength of LLM and conventional software. Diverse LLM applications from different tenants could design complex workflows using multiple LLM requests to accomplish one task. However, they have to use the over-simplified request-level API provided by today's public LLM services, losing essential application-level information. Public LLM services have to blindly optimize individual LLM requests, leading to sub-optimal end-to-end performance of LLM applications. This paper introduces Parrot, an LLM service system that focuses on the end-to-end experience of LLM-based applications. Parrot proposes Semantic Variable, a unified abstraction to expose application-level knowledge to public LLM services. A Semantic Variable annotates an input/output variable in the prompt of a request, and creates the data pipeline when connecting multiple LLM requests, providing a natural way to program LLM applications. Exposing Semantic Variables to the public LLM service allows it to perform conventional data flow analysis to uncover the correlation across multiple LLM requests. This correlation opens a brand-new optimization space for the end-to-end performance of LLM-based applications. Extensive evaluations demonstrate that Parrot can achieve up to an order-of-magnitude improvement for popular and practical use cases of LLM applications.