Investigating the Impact of Choice on Deep Reinforcement Learning for Space Controls

作者: Nathaniel Hamilton, Kyle Dunlap, Kerianne L. Hobbs

分类: cs.LG, eess.SY

发布日期: 2024-05-20

💡 一句话要点

研究离散动作空间选择对空间控制深度强化学习性能的影响

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 深度强化学习 空间控制 离散动作空间 连续控制 自主控制

📋 核心要点

- 传统空间控制方法难以应对日益增长的空间资产和复杂任务需求,自主控制成为趋势。

- 论文研究了离散动作空间中动作选择数量对强化学习智能体在空间控制任务中性能的影响。

- 实验表明,离散动作空间在检查任务中表现更优,而连续控制在对接任务中表现更优。

📝 摘要(中文)

针对空间应用,传统控制方法应用广泛。然而,随着空间资产数量的增长,自主操作能够加速不同空间任务控制方法的开发。强化学习(RL)在众多复杂任务中表现出优异性能,因此日益流行。虽然RL智能体通常学习有界的连续控制值,但这对于传统上偏好开关控制的空间任务而言,可能不切实际。本文分析了离散动作空间的使用,其中智能体必须从预定义的操作列表中进行选择。实验探讨了提供给智能体的选择数量如何影响训练期间和训练后的性能。该分析针对检查任务(智能体必须环绕物体以检查其表面的点)和对接任务(智能体必须移动到另一航天器附近并以低相对速度“对接”)。两项任务的共同目标,以及大多数空间任务的共同目标,是最小化燃料使用,这促使智能体定期选择不使用燃料的动作。结果表明,有限数量的离散选择可以为检查任务带来最佳性能,而连续控制可以为对接任务带来最佳性能。

🔬 方法详解

问题定义:论文旨在研究在空间控制任务中使用深度强化学习时,离散动作空间中动作选择的数量对智能体性能的影响。现有方法通常使用连续控制或未充分探索离散动作空间的影响,这可能导致燃料效率低下或无法满足特定空间任务的需求。

核心思路:核心思路是通过实验对比不同数量的离散动作选择对强化学习智能体在空间检查和对接任务中的性能影响。通过分析智能体在不同动作选择下的学习曲线、燃料消耗等指标,确定适用于不同空间任务的最佳动作空间类型和大小。

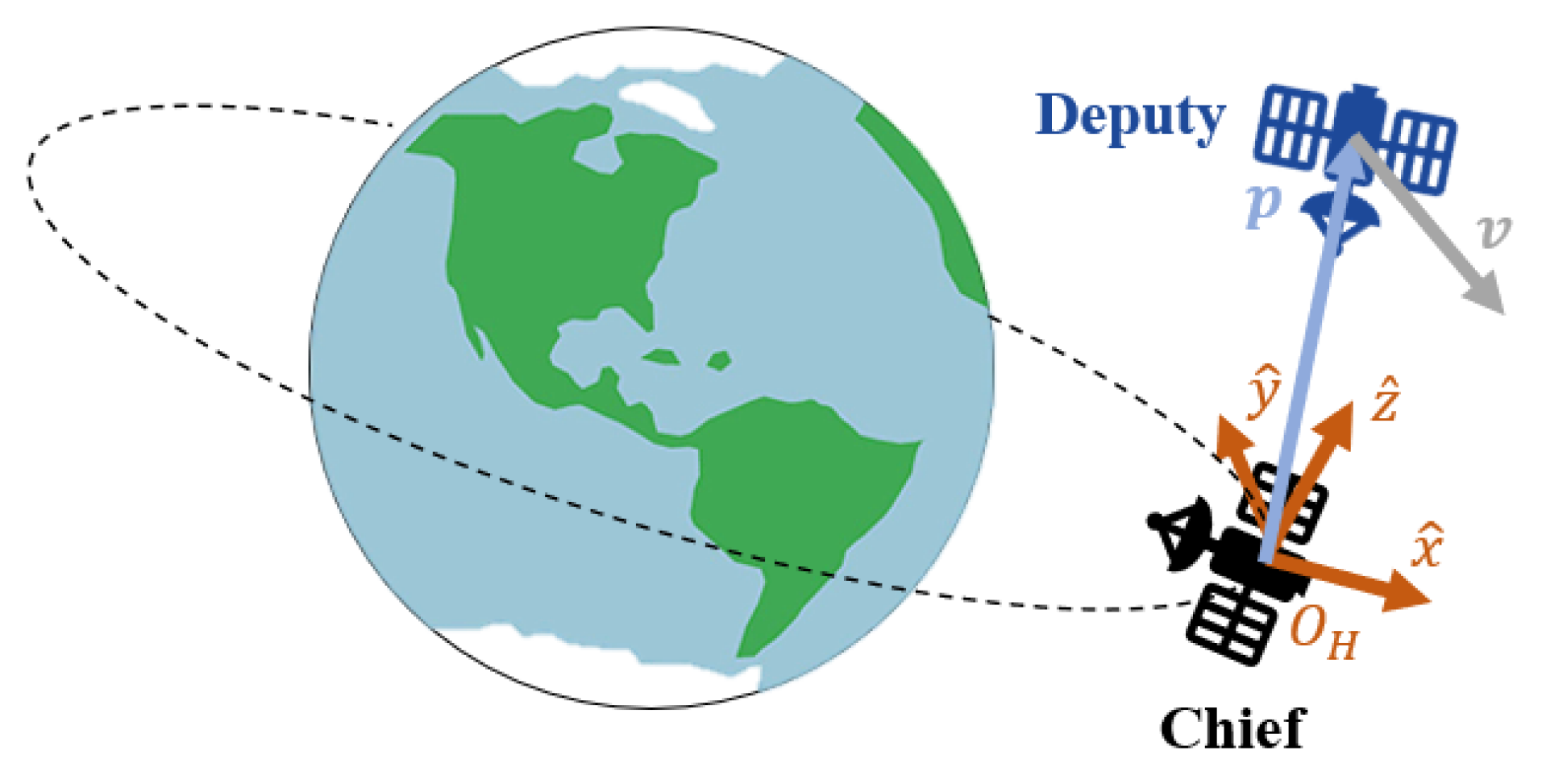

技术框架:整体框架包括两个主要的空间控制任务:空间物体检查和航天器对接。对于每个任务,使用深度强化学习算法训练智能体,智能体通过与环境交互学习控制策略。环境提供状态信息,智能体根据策略选择动作,并获得奖励。训练过程旨在最大化累积奖励,从而优化智能体的控制性能。

关键创新:关键创新在于对离散动作空间选择数量的系统性分析,并将其与连续控制进行对比。以往研究较少关注离散动作空间中动作选择数量对空间控制任务的影响。该研究揭示了不同任务对动作空间类型的偏好,为空间控制任务中强化学习的应用提供了指导。

关键设计:实验中,动作空间被设计为离散的,智能体可以从预定义的动作列表中选择动作,例如不同方向和大小的推力。动作选择的数量是实验中的一个关键参数。奖励函数被设计为鼓励智能体完成任务目标(例如,检查所有目标点或成功对接),同时惩罚燃料消耗。具体的网络结构和强化学习算法(例如,DQN、PPO等)在论文中未明确说明,属于实现细节,但会影响最终性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,对于空间物体检查任务,有限数量的离散动作选择能够获得最佳性能,这可能是因为离散动作空间有助于智能体更快地探索状态空间并避免局部最优解。而对于航天器对接任务,连续控制表现更优,这可能是因为对接任务需要更精细的控制才能实现平稳对接。具体的性能数据和提升幅度在摘要中未给出,需要在论文正文中查找。

🎯 应用场景

该研究成果可应用于航天器自主控制、空间机器人操作、卫星编队飞行等领域。通过选择合适的动作空间类型和大小,可以提高空间任务的效率、降低燃料消耗,并实现更复杂的自主控制功能。未来,该研究可以扩展到更复杂的空间任务和环境,例如在轨服务、空间碎片清除等。

📄 摘要(原文)

For many space applications, traditional control methods are often used during operation. However, as the number of space assets continues to grow, autonomous operation can enable rapid development of control methods for different space related tasks. One method of developing autonomous control is Reinforcement Learning (RL), which has become increasingly popular after demonstrating promising performance and success across many complex tasks. While it is common for RL agents to learn bounded continuous control values, this may not be realistic or practical for many space tasks that traditionally prefer an on/off approach for control. This paper analyzes using discrete action spaces, where the agent must choose from a predefined list of actions. The experiments explore how the number of choices provided to the agents affects their measured performance during and after training. This analysis is conducted for an inspection task, where the agent must circumnavigate an object to inspect points on its surface, and a docking task, where the agent must move into proximity of another spacecraft and "dock" with a low relative speed. A common objective of both tasks, and most space tasks in general, is to minimize fuel usage, which motivates the agent to regularly choose an action that uses no fuel. Our results show that a limited number of discrete choices leads to optimal performance for the inspection task, while continuous control leads to optimal performance for the docking task.