Empowering Small-Scale Knowledge Graphs: A Strategy of Leveraging General-Purpose Knowledge Graphs for Enriched Embeddings

作者: Albert Sawczyn, Jakub Binkowski, Piotr Bielak, Tomasz Kajdanowicz

分类: cs.LG, cs.AI, cs.CL

发布日期: 2024-05-17

备注: Accepted for LREC-COLING 2024

💡 一句话要点

提出一种利用通用知识图谱增强小规模知识图谱嵌入的策略

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 知识图谱 知识图谱补全 实体对齐 表示学习 机器学习 知识图谱嵌入 通用知识图谱

📋 核心要点

- 大型语言模型在知识密集型任务中存在局限性,而知识图谱的构建成本高昂,限制了其应用。

- 该论文提出利用通用知识图谱来增强小规模领域特定知识图谱的嵌入,从而提升下游任务性能。

- 实验结果表明,该方法能够显著提升知识图谱补全任务的性能,Hits@10指标提升高达44%。

📝 摘要(中文)

知识密集型任务对机器学习技术提出了重大挑战。常用的方法,如大型语言模型(LLMs),在应用于此类任务时常常表现出局限性。尽管如此,人们已经做出了显著的努力来缓解这些挑战,其中一个重要的方向是通过知识图谱(KGs)来增强LLMs。虽然KGs为知识表示提供了许多优势,但其开发成本可能会阻碍广泛的研究和应用。为了解决这个限制,我们提出了一个框架,用于利用完善的通用知识图谱来丰富小规模领域特定知识图谱的嵌入。采用我们的方法,一个适度的领域特定KG可以通过链接到大型通用KG,从而在下游任务中获得性能提升。实验评估表明,性能得到了显著提高,在Hits@10指标上观察到高达44%的提升。这种相对未被探索的研究方向可以促进KGs更频繁地应用于知识密集型任务,从而产生比流行的LLM解决方案更强大、更可靠的ML实现,并减少幻觉。

🔬 方法详解

问题定义:论文旨在解决小规模领域特定知识图谱在知识密集型任务中表现不佳的问题。现有方法要么依赖于大型语言模型,但容易产生幻觉,要么需要构建大型知识图谱,但成本高昂。因此,如何利用已有的通用知识图谱来提升小规模知识图谱的性能是一个关键问题。

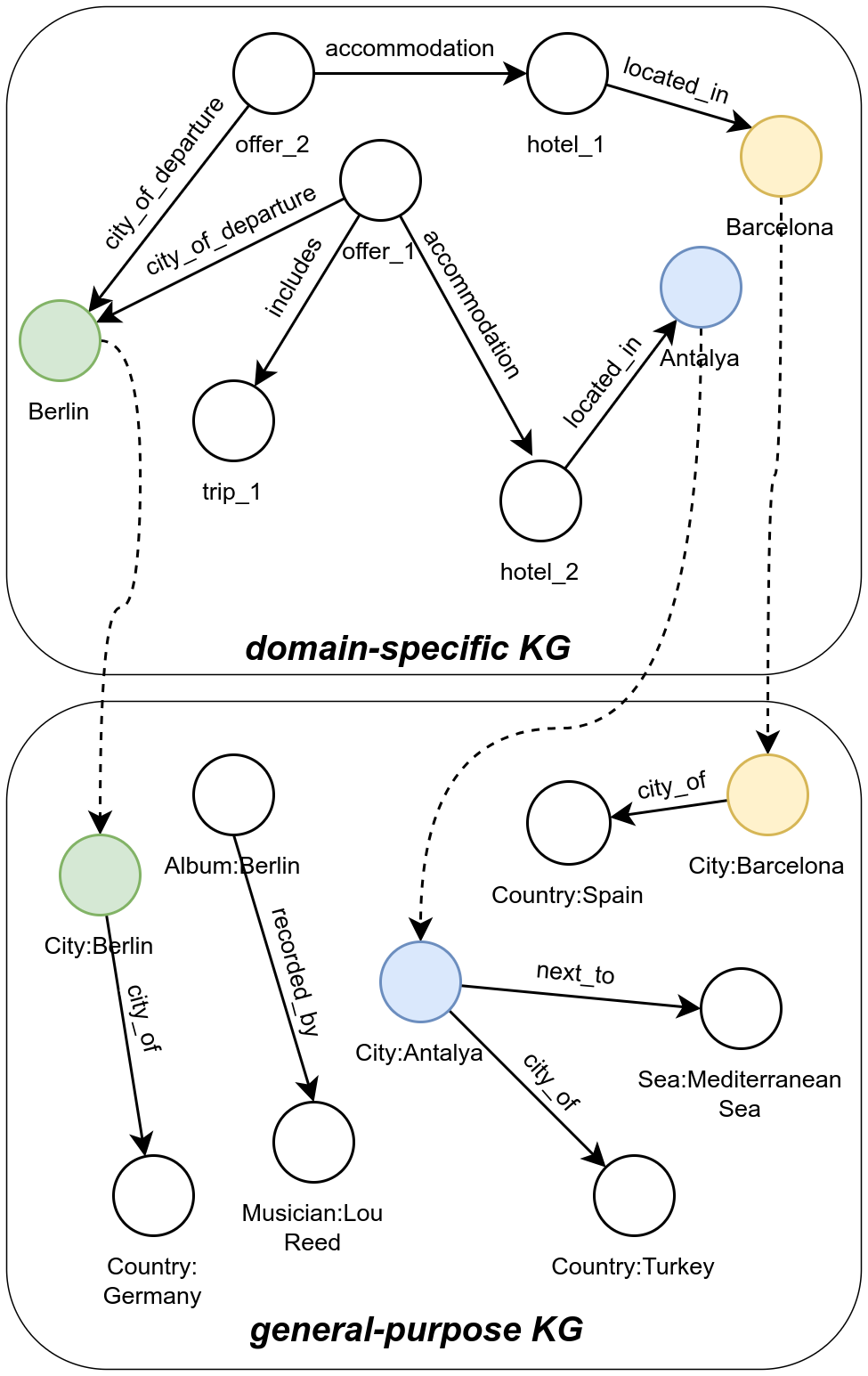

核心思路:论文的核心思路是将小规模领域特定知识图谱与大规模通用知识图谱进行链接,从而利用通用知识图谱中丰富的知识来增强领域特定知识图谱的实体嵌入表示。通过这种方式,小规模知识图谱可以获得更全面的知识,从而提升下游任务的性能。

技术框架:该框架主要包含以下几个阶段:1) 实体对齐:将领域特定知识图谱中的实体与通用知识图谱中的实体进行对齐,建立实体之间的对应关系。2) 嵌入增强:利用对齐的实体信息,将通用知识图谱中的知识融入到领域特定知识图谱的实体嵌入中。3) 下游任务评估:在知识图谱补全等下游任务上评估增强后的知识图谱的性能。

关键创新:该论文的关键创新在于提出了一种利用通用知识图谱来增强小规模领域特定知识图谱嵌入的策略。与传统的知识图谱嵌入方法不同,该方法不需要从头开始构建大型知识图谱,而是利用已有的通用知识图谱来提升小规模知识图谱的性能。

关键设计:论文中可能涉及的关键设计包括:实体对齐算法的选择(例如,基于嵌入相似度的对齐方法),嵌入增强的具体方法(例如,利用图神经网络进行信息传播),以及下游任务的损失函数设计等。具体的参数设置和网络结构等细节在论文中应该会有更详细的描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法能够显著提升知识图谱补全任务的性能,在Hits@10指标上观察到高达44%的提升。这表明利用通用知识图谱来增强小规模领域特定知识图谱是一种有效的策略,可以显著提升知识图谱的质量和应用价值。具体的实验设置和对比基线需要在论文中进一步查阅。

🎯 应用场景

该研究成果可应用于各种知识密集型任务,例如问答系统、推荐系统、信息检索等。通过利用通用知识图谱来增强领域特定知识图谱,可以提升这些系统的性能和可靠性,减少幻觉现象,从而为用户提供更准确、更全面的信息服务。未来,该方法有望在医疗、金融、法律等领域得到广泛应用。

📄 摘要(原文)

Knowledge-intensive tasks pose a significant challenge for Machine Learning (ML) techniques. Commonly adopted methods, such as Large Language Models (LLMs), often exhibit limitations when applied to such tasks. Nevertheless, there have been notable endeavours to mitigate these challenges, with a significant emphasis on augmenting LLMs through Knowledge Graphs (KGs). While KGs provide many advantages for representing knowledge, their development costs can deter extensive research and applications. Addressing this limitation, we introduce a framework for enriching embeddings of small-scale domain-specific Knowledge Graphs with well-established general-purpose KGs. Adopting our method, a modest domain-specific KG can benefit from a performance boost in downstream tasks when linked to a substantial general-purpose KG. Experimental evaluations demonstrate a notable enhancement, with up to a 44% increase observed in the Hits@10 metric. This relatively unexplored research direction can catalyze more frequent incorporation of KGs in knowledge-intensive tasks, resulting in more robust, reliable ML implementations, which hallucinates less than prevalent LLM solutions. Keywords: knowledge graph, knowledge graph completion, entity alignment, representation learning, machine learning