Interpretable Tensor Fusion

作者: Saurabh Varshneya, Antoine Ledent, Philipp Liznerski, Andriy Balinskyy, Purvanshi Mehta, Waleed Mustafa, Marius Kloft

分类: cs.LG

发布日期: 2024-05-07

💡 一句话要点

提出InTense,用于可解释的多模态数据融合与表示学习

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 可解释性 张量融合 数据表示学习 神经网络 模态交互 相关性分析

📋 核心要点

- 传统机器学习方法主要针对单一数据类型进行预测,而实际应用常涉及文本、图像、音频等多种数据类型。

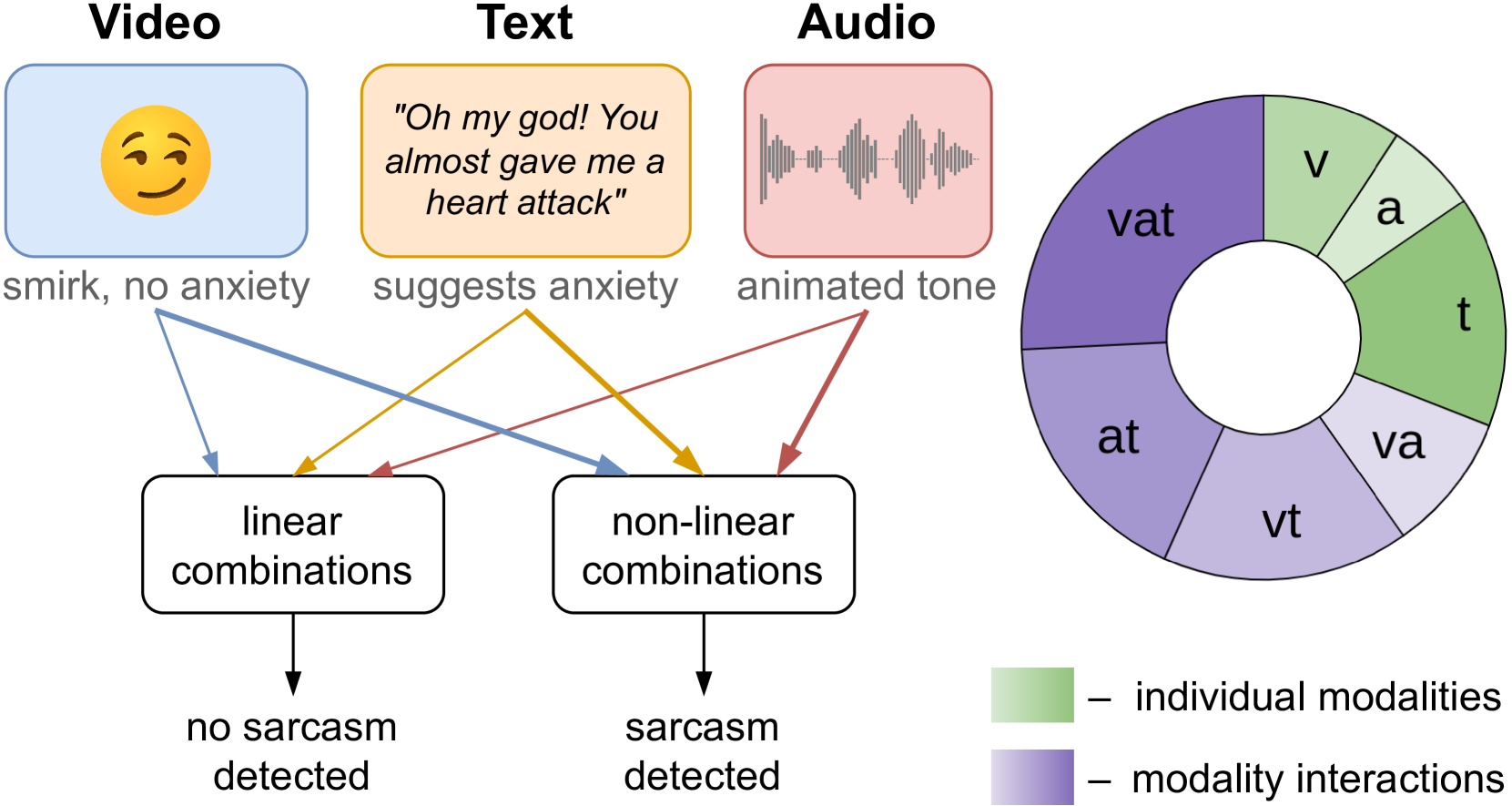

- InTense旨在同时学习多模态数据的表示和可解释的融合,通过张量分解分离线性组合和乘性交互。

- 实验表明,InTense在多个真实数据集上,相比现有方法,在准确性和可解释性方面均有提升。

📝 摘要(中文)

本文提出了一种可解释的张量融合方法(InTense),用于训练神经网络以同时学习多模态数据表示及其可解释的融合。InTense能够分别捕获不同数据类型的线性组合和乘性交互,从而将高阶交互从每个模态的个体效应中解耦。InTense通过为模态及其关联分配相关性得分,从而提供开箱即用的可解释性。该方法具有理论基础,并在多个合成和真实世界的数据集上产生有意义的相关性得分。在六个真实世界数据集上的实验表明,InTense在准确性和可解释性方面优于现有的最先进的多模态可解释方法。

🔬 方法详解

问题定义:现有的多模态学习方法在融合不同类型数据时,往往缺乏可解释性,难以理解不同模态之间的交互关系以及每个模态对最终预测结果的贡献。此外,现有方法难以有效区分模态间的线性组合和高阶交互作用,导致模型解释性不足。

核心思路:InTense的核心思路是通过张量分解的方式,将多模态数据的融合过程分解为线性组合和乘性交互两部分,并为每个模态及其交互关系赋予可解释的相关性得分。通过这种方式,模型能够清晰地揭示不同模态对预测结果的贡献,并量化模态间的交互作用。

技术框架:InTense的整体框架包括以下几个主要模块:1) 多模态数据表示学习模块:用于学习每个模态的有效表示;2) 张量融合模块:利用张量分解技术,将不同模态的表示进行融合,捕获线性组合和乘性交互;3) 相关性得分计算模块:为每个模态及其交互关系计算相关性得分,用于解释模型预测结果。

关键创新:InTense的关键创新在于其可解释的张量融合机制,能够同时学习多模态数据表示和可解释的融合。与现有方法相比,InTense能够更有效地分离模态间的线性组合和高阶交互作用,并提供开箱即用的可解释性。

关键设计:InTense的关键设计包括:1) 使用张量分解技术,将多模态数据的融合过程分解为线性组合和乘性交互两部分;2) 设计相关性得分计算方法,为每个模态及其交互关系赋予可解释的权重;3) 通过损失函数约束,鼓励模型学习具有可解释性的数据表示和融合方式。

🖼️ 关键图片

📊 实验亮点

在六个真实世界数据集上的实验结果表明,InTense在准确性和可解释性方面均优于现有的最先进的多模态可解释方法。具体而言,InTense在多个数据集上取得了显著的性能提升,同时提供了清晰的模态相关性得分,有助于理解模型的预测行为。

🎯 应用场景

InTense可应用于需要多模态数据融合和可解释性的场景,例如医疗诊断(结合影像、文本病历等)、金融风险评估(结合财务数据、新闻报道等)、情感分析(结合文本、语音、面部表情等)。该研究有助于提升模型的可信度和透明度,为决策者提供更可靠的依据。

📄 摘要(原文)

Conventional machine learning methods are predominantly designed to predict outcomes based on a single data type. However, practical applications may encompass data of diverse types, such as text, images, and audio. We introduce interpretable tensor fusion (InTense), a multimodal learning method for training neural networks to simultaneously learn multimodal data representations and their interpretable fusion. InTense can separately capture both linear combinations and multiplicative interactions of diverse data types, thereby disentangling higher-order interactions from the individual effects of each modality. InTense provides interpretability out of the box by assigning relevance scores to modalities and their associations. The approach is theoretically grounded and yields meaningful relevance scores on multiple synthetic and real-world datasets. Experiments on six real-world datasets show that InTense outperforms existing state-of-the-art multimodal interpretable approaches in terms of accuracy and interpretability.