Functional Latent Dynamics for Irregularly Sampled Time Series Forecasting

作者: Christian Klötergens, Vijaya Krishna Yalavarthi, Maximilian Stubbemann, Lars Schmidt-Thieme

分类: cs.LG

发布日期: 2024-05-06 (更新: 2024-10-03)

💡 一句话要点

提出函数潜在动力学(FLD)模型,高效解决不规则采样时间序列预测问题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 时间序列预测 不规则采样 缺失值处理 函数潜在动力学 常微分方程 深度学习

📋 核心要点

- 传统深度学习模型难以处理具有缺失值的不规则采样时间序列,现有基于ODE的方法计算成本高昂。

- FLD模型通过学习简单曲线的系数来表示连续潜在状态,避免了求解复杂ODE的过程。

- 实验表明,FLD在预测精度上优于最佳ODE模型,同时显著降低了运行时间和内存占用。

📝 摘要(中文)

本文提出了一种名为函数潜在动力学(FLD)的模型家族,用于解决具有缺失值的不规则采样时间序列预测问题。这类时间序列常见于医疗、气候和天文等领域,对只能处理完整且规则采样时间序列的标准深度学习模型构成了挑战。许多模型依赖于在隐藏状态中求解常微分方程(ODE)来捕捉不规则时间序列的连续动态,但这些基于ODE的模型由于顺序操作和复杂的ODE求解器,往往速度慢且需要大量内存。作为复杂ODE模型的替代方案,FLD使用简单的曲线来指定模型中的连续潜在状态,这些曲线在所有时间点都存在。曲线的系数仅从时间序列中的观测值学习,忽略缺失值。大量实验表明,FLD在降低运行时间和内存开销的同时,比最佳的基于ODE的模型实现了更好的性能。具体而言,与性能最佳的预测模型相比,FLD推断预测所需的时间减少了一个数量级。

🔬 方法详解

问题定义:论文旨在解决不规则采样时间序列的预测问题,这类时间序列在实际应用中普遍存在,例如医疗、气候和天文等领域。现有基于常微分方程(ODE)的方法虽然能够捕捉时间序列的连续动态,但由于需要求解复杂的ODE,计算量大,速度慢,且需要消耗大量内存,难以满足实际应用的需求。

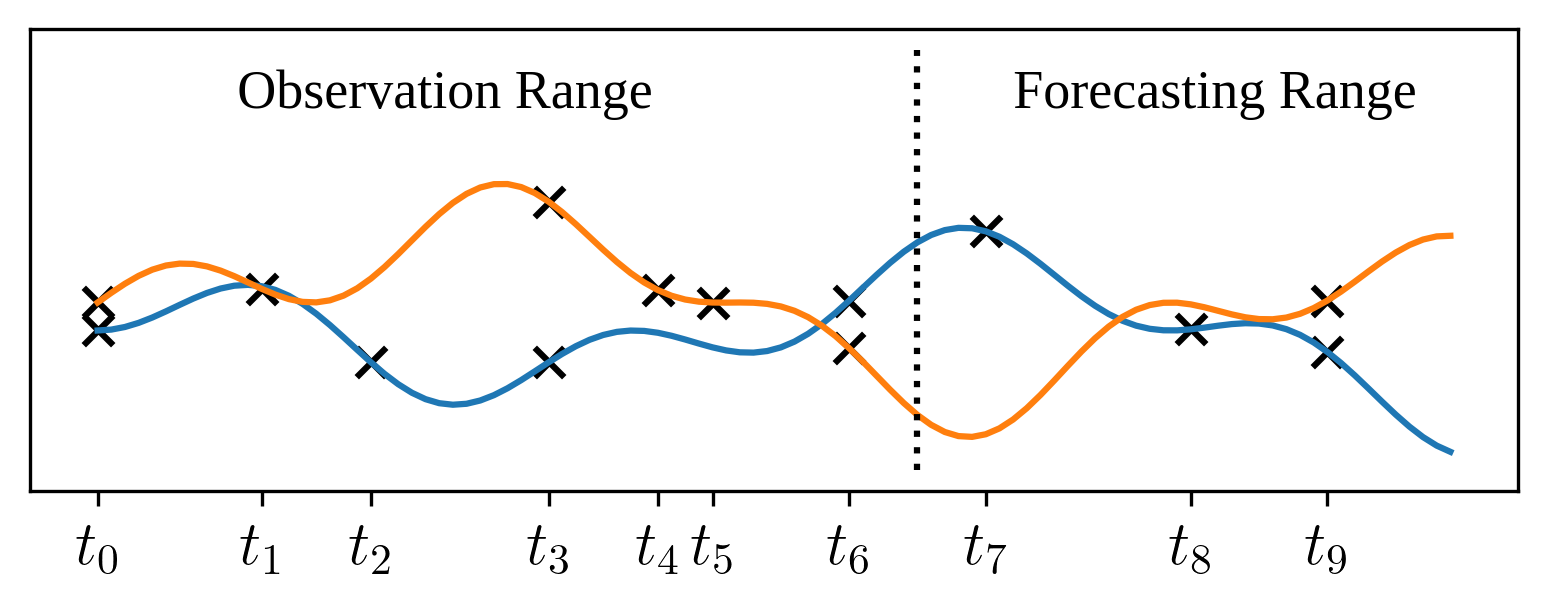

核心思路:FLD的核心思路是使用简单的曲线函数来表示潜在状态的连续动态,而不是求解ODE。这些曲线在所有时间点都存在,即使在数据缺失的时间点也能提供潜在状态的估计。通过学习这些曲线的系数,模型可以从观测数据中提取时间序列的动态特征,并用于未来的预测。

技术框架:FLD模型主要包含以下几个模块:1) 编码器:将观测到的不规则时间序列编码为潜在状态的曲线系数。2) 潜在状态表示:使用学习到的曲线系数构建连续的潜在状态表示。3) 解码器:将潜在状态解码为未来的时间序列预测值。整个框架通过端到端的方式进行训练,目标是最小化预测值与真实值之间的差异。

关键创新:FLD的关键创新在于使用函数来表示潜在状态的动态,避免了求解ODE的复杂过程。与传统的ODE方法相比,FLD更加高效,计算成本更低,且更容易训练。此外,FLD能够直接处理不规则采样的时间序列,无需进行插值或填充等预处理操作。

关键设计:FLD模型中,曲线函数可以选择多种形式,例如多项式、样条函数等。论文中具体使用的曲线函数类型未知。损失函数通常采用均方误差(MSE)或类似的回归损失函数,用于衡量预测值与真实值之间的差异。编码器和解码器可以使用循环神经网络(RNN)、Transformer等序列模型,具体网络结构未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,FLD模型在不规则采样时间序列预测任务上优于现有的基于ODE的模型。具体而言,FLD在预测精度上取得了显著提升,同时将推理时间缩短了一个数量级,并显著降低了内存占用。这些结果表明,FLD是一种更高效、更实用的不规则采样时间序列预测方法。

🎯 应用场景

FLD模型可广泛应用于需要处理不规则采样时间序列的领域,如医疗健康(患者生理指标预测)、气候预测(气象数据分析)、金融分析(股票价格预测)和工业监控(设备状态预测)等。该模型能够提高预测精度,降低计算成本,为相关领域的实际应用提供更高效的解决方案,并促进更准确的决策。

📄 摘要(原文)

Irregularly sampled time series with missing values are often observed in multiple real-world applications such as healthcare, climate and astronomy. They pose a significant challenge to standard deep learning models that operate only on fully observed and regularly sampled time series. In order to capture the continuous dynamics of the irregular time series, many models rely on solving an Ordinary Differential Equation (ODE) in the hidden state. These ODE-based models tend to perform slow and require large memory due to sequential operations and a complex ODE solver. As an alternative to complex ODE-based models, we propose a family of models called Functional Latent Dynamics (FLD). Instead of solving the ODE, we use simple curves which exist at all time points to specify the continuous latent state in the model. The coefficients of these curves are learned only from the observed values in the time series ignoring the missing values. Through extensive experiments, we demonstrate that FLD achieves better performance compared to the best ODE-based model while reducing the runtime and memory overhead. Specifically, FLD requires an order of magnitude less time to infer the forecasts compared to the best performing forecasting model.