MetaRM: Shifted Distributions Alignment via Meta-Learning

作者: Shihan Dou, Yan Liu, Enyu Zhou, Tianlong Li, Haoxiang Jia, Limao Xiong, Xin Zhao, Junjie Ye, Rui Zheng, Tao Gui, Qi Zhang, Xuanjing Huang

分类: cs.LG, cs.CL

发布日期: 2024-05-01

备注: 11 pages, 6 figures. arXiv admin note: text overlap with arXiv:2401.06080

💡 一句话要点

MetaRM:通过元学习对齐奖励模型与漂移分布,提升RLHF性能

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 奖励模型 元学习 强化学习 人类反馈 分布漂移 语言模型对齐 RLHF

📋 核心要点

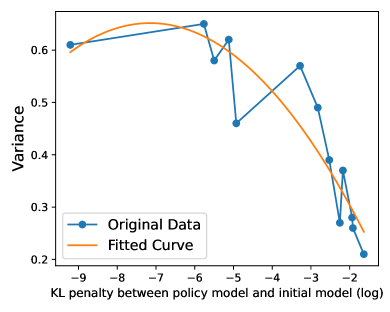

- 强化学习从人类反馈中学习(RLHF)依赖奖励模型(RM),但策略模型输出分布漂移会降低RM的区分能力。

- MetaRM利用元学习,通过最小化数据损失,使RM适应漂移的环境分布,提升对新分布样本的区分能力。

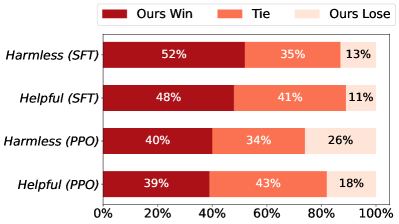

- 实验表明,MetaRM显著提升了RM在迭代RLHF优化中的区分能力,并能识别分布外样本的细微差异。

📝 摘要(中文)

奖励模型(RM)在语言模型对齐中的成功,依赖于其区分响应的能力。然而,随着训练过程的进行,策略模型的输出分布发生漂移,导致RM区分响应的能力下降。此外,在特定数据分布上训练的RM难以泛化到该分布之外的样本。这两个问题可以归结为环境分布漂移带来的挑战。为了克服这一挑战,我们引入了MetaRM,一种利用元学习将RM与漂移的环境分布对齐的方法。MetaRM旨在通过最小化数据损失来训练RM,特别是对于那些可以提高区分漂移目标分布样本能力的数据。大量实验表明,MetaRM显著提高了RM在迭代RLHF优化中的区分能力,并且能够识别分布外样本中的细微差异。

🔬 方法详解

问题定义:论文旨在解决RLHF中奖励模型(RM)因策略模型输出分布漂移而导致的区分能力下降问题。现有RM在特定数据分布上训练,难以泛化到新的分布,导致在迭代优化过程中性能下降。这种分布漂移问题是RLHF中的一个关键挑战。

核心思路:论文的核心思路是利用元学习,使RM能够快速适应新的数据分布。通过元学习,RM可以学习到一种通用的学习策略,使其能够有效地利用少量的新数据来调整自身,从而适应策略模型输出分布的漂移。

技术框架:MetaRM的整体框架包含两个主要阶段:元训练阶段和适应阶段。在元训练阶段,RM在一个模拟的分布漂移环境中进行训练,学习如何快速适应新的分布。在适应阶段,RM利用少量来自当前策略模型输出的数据进行微调,从而适应当前的分布。该框架旨在使RM能够持续地跟踪策略模型的输出分布,保持其区分能力。

关键创新:MetaRM的关键创新在于将元学习引入到RLHF的奖励模型训练中。与传统的RM训练方法不同,MetaRM不是简单地在静态数据集上训练RM,而是通过元学习使RM具备了适应分布漂移的能力。这种方法能够有效地解决RLHF中因策略模型输出分布漂移而导致的RM性能下降问题。

关键设计:MetaRM的关键设计包括:1) 元学习任务的构建,需要设计合适的任务来模拟分布漂移;2) 元学习算法的选择,需要选择一种能够有效学习通用学习策略的元学习算法;3) 损失函数的设计,需要设计一种能够促进RM适应新分布的损失函数。具体而言,论文可能采用了基于梯度优化的元学习算法,并设计了一种基于数据损失的损失函数,以促进RM对新分布的适应。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MetaRM在迭代RLHF优化中显著提高了RM的区分能力。具体而言,MetaRM能够更好地识别分布外样本中的细微差异,从而提升了整体的对齐效果。相较于传统方法,MetaRM在面对策略模型输出分布漂移时表现出更强的鲁棒性和适应性,验证了元学习在解决该问题上的有效性。

🎯 应用场景

MetaRM具有广泛的应用前景,可应用于各种需要从人类反馈中学习的语言模型对齐任务。该方法可以提高RLHF的稳定性和效率,减少对大量人工标注数据的依赖。此外,MetaRM还可以应用于其他机器学习领域,例如领域自适应和持续学习,以解决模型在不同分布上的泛化问题。

📄 摘要(原文)

The success of Reinforcement Learning from Human Feedback (RLHF) in language model alignment is critically dependent on the capability of the reward model (RM). However, as the training process progresses, the output distribution of the policy model shifts, leading to the RM's reduced ability to distinguish between responses. This issue is further compounded when the RM, trained on a specific data distribution, struggles to generalize to examples outside of that distribution. These two issues can be united as a challenge posed by the shifted distribution of the environment. To surmount this challenge, we introduce MetaRM, a method leveraging meta-learning to align the RM with the shifted environment distribution. MetaRM is designed to train the RM by minimizing data loss, particularly for data that can improve the differentiation ability to examples of the shifted target distribution. Extensive experiments demonstrate that MetaRM significantly improves the RM's distinguishing ability in iterative RLHF optimization, and also provides the capacity to identify subtle differences in out-of-distribution samples.