EAG-PT: Emission-Aware Gaussians and Path Tracing for Indoor Scene Reconstruction and Editing

作者: Xijie Yang, Mulin Yu, Changjian Jiang, Kerui Ren, Tao Lu, Jiangmiao Pang, Dahua Lin, Bo Dai, Linning Xu

分类: cs.GR, cs.CV

发布日期: 2026-01-30

备注: project page: https://eag-pt.github.io

💡 一句话要点

EAG-PT:基于高斯分布和路径追踪的室内场景重建与编辑方法

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 室内场景重建 场景编辑 高斯分布 路径追踪 逆向渲染

📋 核心要点

- 现有基于辐射场的重建方法(如NeRF)虽然视觉效果好,但光照信息被烘焙,缺乏显式光传输,难以进行场景编辑。

- EAG-PT使用2D高斯分布作为场景表示,显式分离发光和非发光组件,并解耦重建和渲染,实现基于物理的光传输。

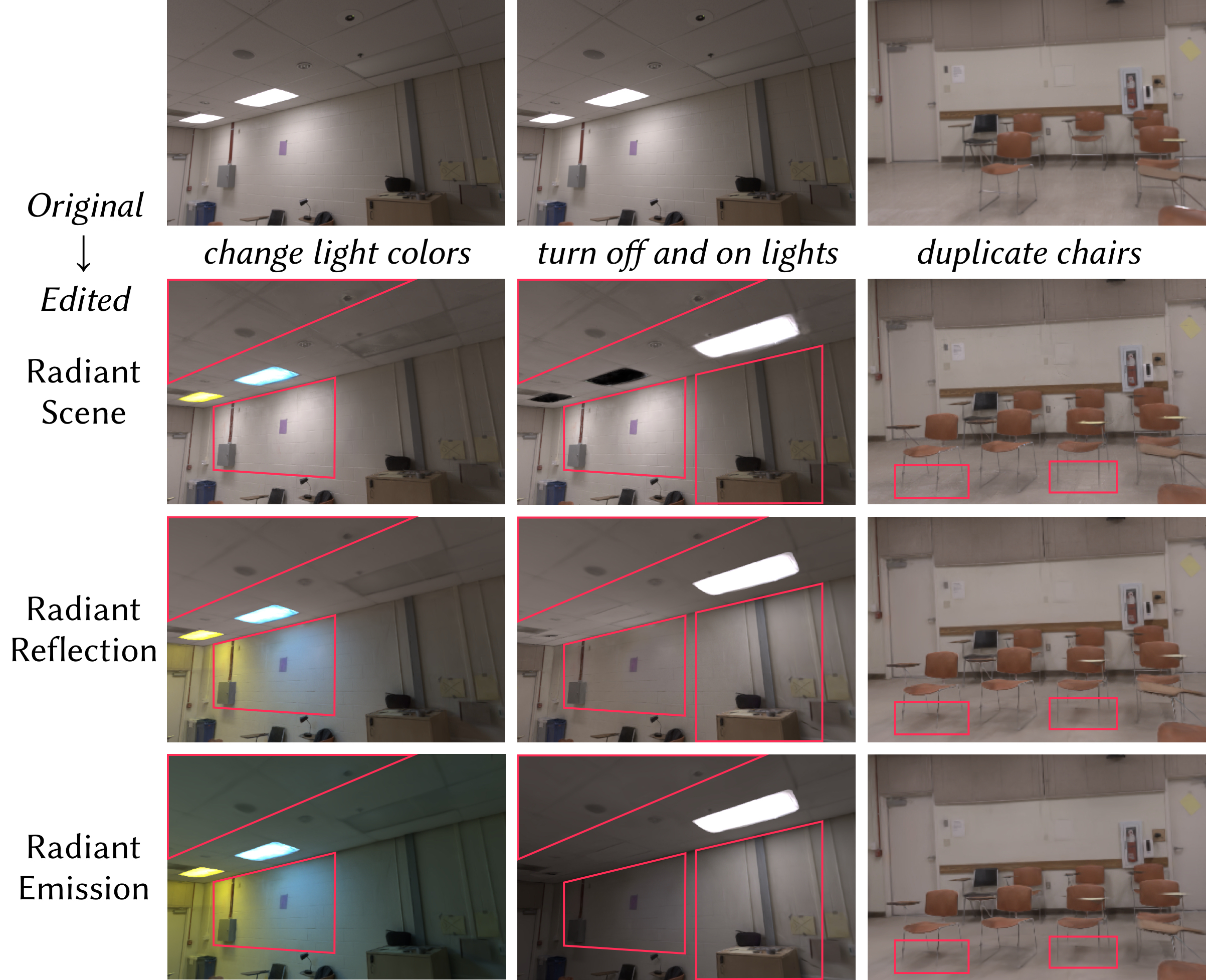

- 实验表明,EAG-PT在场景编辑后能生成更自然、物理一致的渲染结果,同时保留精细几何细节,避免网格伪影。

📝 摘要(中文)

本文提出了一种名为Emission-Aware Gaussians and Path Tracing (EAG-PT) 的方法,用于室内场景的重建和编辑,旨在实现基于物理的、具有统一2D高斯表示的光传输。该方法包含三个核心部分:(1) 使用2D高斯分布作为统一的场景表示和易于传输的几何代理,避免重建网格;(2) 在重建过程中显式地分离发光和非发光组件,以便进一步进行场景编辑;(3) 通过使用高效的单次反弹优化和高质量的多次反弹路径追踪,将重建与最终渲染解耦。在合成和真实室内场景上的实验表明,与辐射场景重建相比,EAG-PT在编辑后产生更自然和物理上一致的渲染效果,同时保留了更精细的几何细节,并避免了基于网格的逆向路径追踪中出现的伪影。这些结果表明,该方法在室内设计、XR内容创作和具身智能方面具有广阔的应用前景。

🔬 方法详解

问题定义:现有基于辐射场的室内场景重建方法,如NeRF,虽然能生成高视觉质量的场景,但由于光照信息被烘焙在场景表示中,缺乏显式的光传输建模,因此难以进行场景编辑。而基于网格的逆向渲染方法虽然能保证光照的物理正确性,但对几何质量要求很高,在复杂的真实室内场景中容易出现问题。

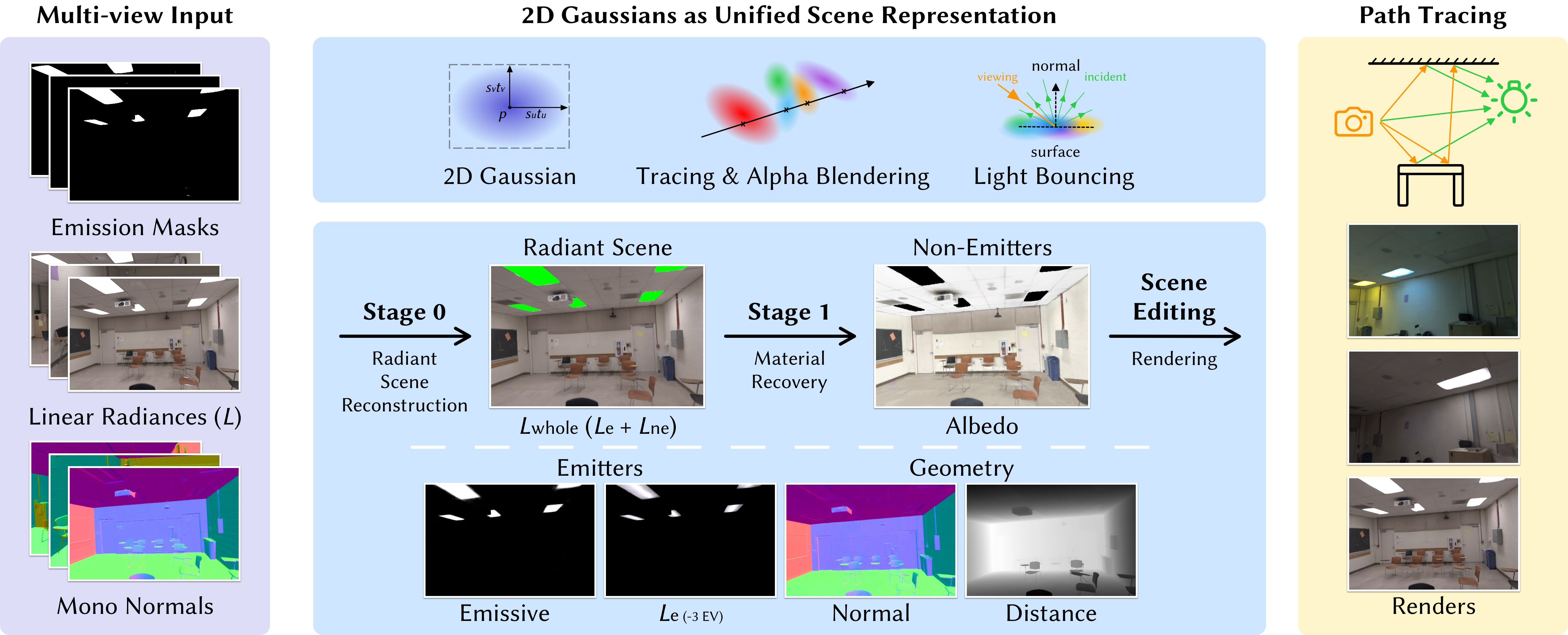

核心思路:EAG-PT的核心思路是使用2D高斯分布作为场景的统一表示,并将其作为光线传输的几何代理,从而避免了对高质量网格的需求。同时,该方法显式地分离场景中的发光和非发光组件,使得在场景编辑后可以独立地调整光照。此外,EAG-PT将场景重建和最终渲染解耦,通过高效的单次反弹优化进行场景重建,然后使用高质量的多次反弹路径追踪进行最终渲染。

技术框架:EAG-PT的整体框架包含三个主要阶段:1) 基于图像的2D高斯分布场景重建,同时分离发光和非发光组件;2) 场景编辑,可以修改场景的几何、材质和光照;3) 基于路径追踪的渲染,利用重建的场景和编辑后的信息,生成最终的渲染图像。其中,场景重建阶段使用单次反弹优化,以提高效率;渲染阶段使用多次反弹路径追踪,以保证渲染质量。

关键创新:EAG-PT的关键创新在于使用2D高斯分布作为场景的统一表示,并将其作为光线传输的几何代理。这与传统的基于网格的逆向渲染方法不同,避免了对高质量网格的需求,从而更容易处理复杂的真实室内场景。同时,显式地分离发光和非发光组件,使得场景编辑更加灵活。

关键设计:EAG-PT的关键设计包括:1) 使用可微分的渲染器,将2D高斯分布投影到图像平面上,并计算渲染损失;2) 设计损失函数,鼓励场景重建的几何和光照的准确性;3) 使用高效的单次反弹优化进行场景重建,以提高效率;4) 使用高质量的多次反弹路径追踪进行最终渲染,以保证渲染质量。具体的参数设置和网络结构等细节未在摘要中详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

EAG-PT在合成和真实室内场景上的实验表明,与辐射场景重建方法相比,EAG-PT在场景编辑后能生成更自然和物理一致的渲染结果。同时,EAG-PT保留了更精细的几何细节,并避免了基于网格的逆向路径追踪中出现的伪影。具体的性能数据和提升幅度未在摘要中详细说明,属于未知信息。

🎯 应用场景

EAG-PT在室内设计、XR内容创作和具身智能等领域具有广阔的应用前景。在室内设计中,设计师可以使用EAG-PT快速创建和编辑虚拟室内场景,并实时预览渲染效果。在XR内容创作中,EAG-PT可以用于生成高质量的虚拟现实和增强现实内容。在具身智能中,EAG-PT可以用于构建虚拟环境,训练机器人在虚拟环境中进行导航和交互。

📄 摘要(原文)

Recent reconstruction methods based on radiance field such as NeRF and 3DGS reproduce indoor scenes with high visual fidelity, but break down under scene editing due to baked illumination and the lack of explicit light transport. In contrast, physically based inverse rendering relies on mesh representations and path tracing, which enforce correct light transport but place strong requirements on geometric fidelity, becoming a practical bottleneck for real indoor scenes. In this work, we propose Emission-Aware Gaussians and Path Tracing (EAG-PT), aiming for physically based light transport with a unified 2D Gaussian representation. Our design is based on three cores: (1) using 2D Gaussians as a unified scene representation and transport-friendly geometry proxy that avoids reconstructed mesh, (2) explicitly separating emissive and non-emissive components during reconstruction for further scene editing, and (3) decoupling reconstruction from final rendering by using efficient single-bounce optimization and high-quality multi-bounce path tracing after scene editing. Experiments on synthetic and real indoor scenes show that EAG-PT produces more natural and physically consistent renders after editing than radiant scene reconstructions, while preserving finer geometric detail and avoiding mesh-induced artifacts compared to mesh-based inverse path tracing. These results suggest promising directions for future use in interior design, XR content creation, and embodied AI.