ClipGS-VR: Immersive and Interactive Cinematic Visualization of Volumetric Medical Data in Mobile Virtual Reality

作者: Yuqi Tong, Ruiyang Li, Chengkun Li, Qixuan Liu, Shi Qiu, Pheng-Ann Heng

分类: cs.GR, cs.HC

发布日期: 2026-01-27

备注: IEEE VR 2026 Posters

💡 一句话要点

ClipGS-VR:移动VR中用于容积医学数据沉浸式交互电影级可视化

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 虚拟现实 医学可视化 容积数据 高斯溅射 实时渲染

📋 核心要点

- 现有ClipGS方法在消费级VR设备上缺乏任意角度切片能力,限制了医学数据的交互式探索。

- ClipGS-VR将预计算切片状态的高保真层整合到统一渲染结构中,并通过梯度调制实现任意角度切片。

- 实验表明,ClipGS-VR在保持视觉保真度的同时,显著提升了VR环境下的可用性和交互效率。

📝 摘要(中文)

在移动虚拟现实(VR)上实现高保真电影级医学可视化仍然具有挑战性。虽然ClipGS通过3D高斯溅射实现了横截面探索,但它缺乏在消费级VR头显上的任意角度切片功能。为了实现实时交互性能,我们引入了ClipGS-VR,并将ClipGS的神经推理重构为统一的数据集,将多个预先计算的切片状态中的高保真层集成到统一的渲染结构中。我们的框架进一步支持基于梯度的不透明度调制来实现任意角度切片,从而实现平滑、视觉连贯的渲染。评估结果证实,我们的方法在提供卓越的可用性和交互效率的同时,保持了与离线结果相当的视觉保真度。

🔬 方法详解

问题定义:论文旨在解决移动VR设备上医学容积数据高保真、交互式可视化的问题。现有方法,如ClipGS,虽然能进行横截面探索,但无法在消费级VR头显上实现任意角度的切片,导致交互体验受限,难以满足医生对三维医学影像的观察需求。

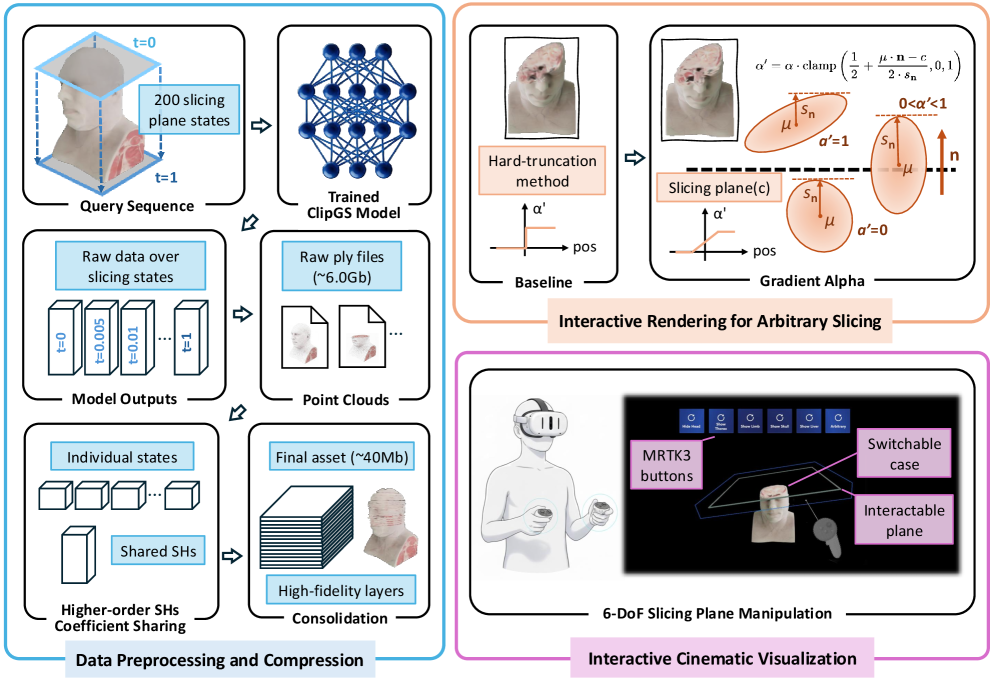

核心思路:论文的核心思路是将预先计算好的多个切片状态的高保真信息整合到一个统一的数据结构中,从而避免实时进行复杂的神经渲染计算。同时,利用基于梯度的不透明度调制方法,实现任意角度切片的平滑过渡和视觉连贯性。这种方法旨在平衡渲染质量和实时交互性能,使其能够在移动VR设备上运行。

技术框架:ClipGS-VR框架主要包含两个阶段:预处理阶段和渲染阶段。在预处理阶段,首先对原始医学数据进行预处理,生成多个不同角度的切片图像,并提取高保真特征层。然后,将这些特征层整合到一个统一的数据集中。在渲染阶段,根据用户的视角和交互操作,利用梯度调制方法对数据集进行采样和渲染,生成最终的VR可视化图像。

关键创新:该论文的关键创新在于将预计算的切片信息整合到统一的数据结构中,并通过梯度调制实现任意角度的平滑切片。与传统的实时神经渲染方法相比,该方法避免了在VR设备上进行复杂的神经推理计算,从而显著提高了渲染速度和交互性能。

关键设计:梯度调制是实现任意角度切片的关键。具体来说,论文利用视角方向与切片平面的夹角计算梯度,并根据梯度值调整切片的不透明度。这种方法可以保证在切换切片角度时,图像的过渡平滑自然,避免出现明显的视觉跳变。此外,数据集的组织方式也至关重要,需要保证能够高效地访问和采样不同角度的切片信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ClipGS-VR在移动VR设备上实现了实时交互的医学影像可视化,同时保持了与离线渲染结果相当的视觉保真度。与传统的基于体绘制的方法相比,ClipGS-VR在渲染速度和交互性能方面有显著提升。用户体验评估也表明,ClipGS-VR具有更高的可用性和交互效率。

🎯 应用场景

ClipGS-VR在医学影像诊断、手术规划、医学教育等领域具有广泛的应用前景。医生可以利用该技术在VR环境中沉浸式地观察和分析医学影像数据,从而提高诊断的准确性和效率。此外,该技术还可以用于手术规划,帮助医生更好地了解患者的解剖结构,制定更安全有效的手术方案。在医学教育方面,学生可以通过VR体验更直观地学习人体解剖知识。

📄 摘要(原文)

High-fidelity cinematic medical visualization on mobile virtual reality (VR) remains challenging. Although ClipGS enables cross-sectional exploration via 3D Gaussian Splatting, it lacks arbitrary-angle slicing on consumer-grade VR headsets. To achieve real-time interactive performance, we introduce ClipGS-VR and restructure ClipGS's neural inference into a consolidated dataset, integrating high-fidelity layers from multiple pre-computed slicing states into a unified rendering structure. Our framework further supports arbitrary-angle slicing via gradient-based opacity modulation for smooth, visually coherent rendering. Evaluations confirm our approach maintains visual fidelity comparable to offline results while offering superior usability and interaction efficiency.