LoD-Structured 3D Gaussian Splatting for Streaming Video Reconstruction

作者: Xinhui Liu, Can Wang, Lei Liu, Zhenghao Chen, Wei Jiang, Wei Wang, Dong Xu

分类: cs.GR, cs.CV

发布日期: 2026-01-26

💡 一句话要点

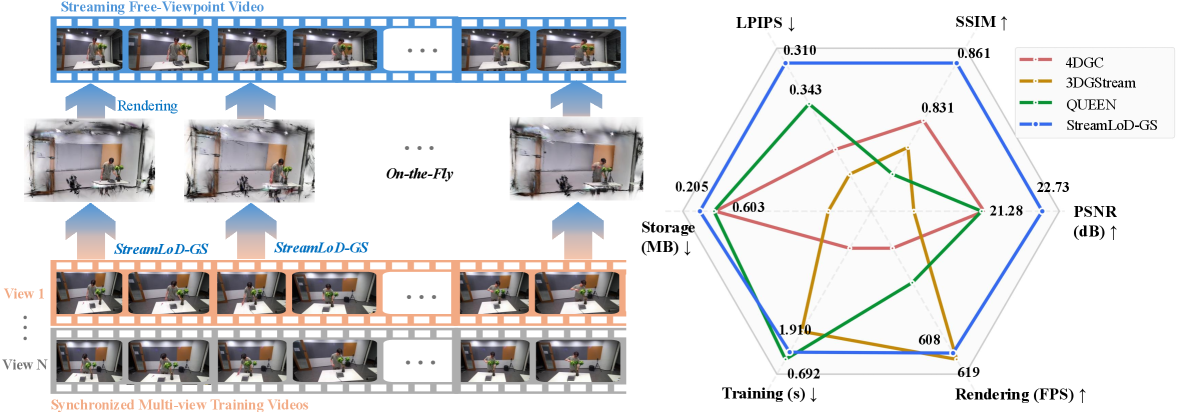

提出StreamLoD-GS,用于解决流式自由视点视频重建中的效率、质量和存储问题

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 自由视点视频 3D高斯溅射 流式重建 多层次细节 运动分割 量化压缩 八叉树

📋 核心要点

- 现有自由视点视频重建方法在流式传输场景下,面临稀疏视角输入、训练成本高昂和带宽限制等挑战。

- StreamLoD-GS通过LoD结构高斯溅射、GMM运动分割和量化残差细化,实现了高效、高质量和低存储的流式自由视点视频重建。

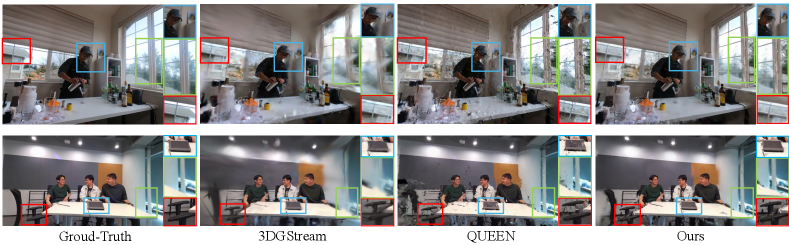

- 实验结果表明,StreamLoD-GS在质量、效率和存储方面均达到了具有竞争力的或最先进的性能。

📝 摘要(中文)

自由视点视频(FVV)重建能够实现逼真的交互式3D场景可视化。然而,实时流式传输通常受到稀疏视角输入、高昂的训练成本和带宽限制的瓶颈。虽然最近的3D高斯溅射(3DGS)由于其卓越的渲染速度而推动了FVV的发展,但流式自由视点视频(SFVV)对快速优化、稀疏约束下的高保真重建和最小的存储占用提出了额外的要求。为了弥合这一差距,我们提出了StreamLoD-GS,这是一个专门为SFVV设计的基于LoD的高斯溅射框架。我们的方法集成了三个核心创新:1)一个基于锚点和八叉树的LoD结构3DGS,具有分层高斯dropout技术,以确保高效稳定的优化,同时保持高质量的渲染;2)一种基于GMM的运动分割机制,分离动态和静态内容,细化动态区域,同时保持背景稳定性;3)一种量化的残差细化框架,在不影响视觉保真度的情况下显著降低存储需求。大量的实验表明,StreamLoD-GS在质量、效率和存储方面都达到了有竞争力的或最先进的性能。

🔬 方法详解

问题定义:论文旨在解决流式自由视点视频重建(SFVV)中,如何在稀疏视角输入、有限带宽和存储空间下,实现高质量、高效率的实时渲染问题。现有方法通常面临训练成本高、优化速度慢、存储空间占用大等痛点。

核心思路:论文的核心思路是利用多层次细节(LoD)的3D高斯溅射表示场景,并结合运动分割和量化技术,在保证渲染质量的前提下,显著降低计算复杂度和存储需求。通过分层优化和动态调整高斯粒子的细节程度,实现快速、高效的重建和渲染。

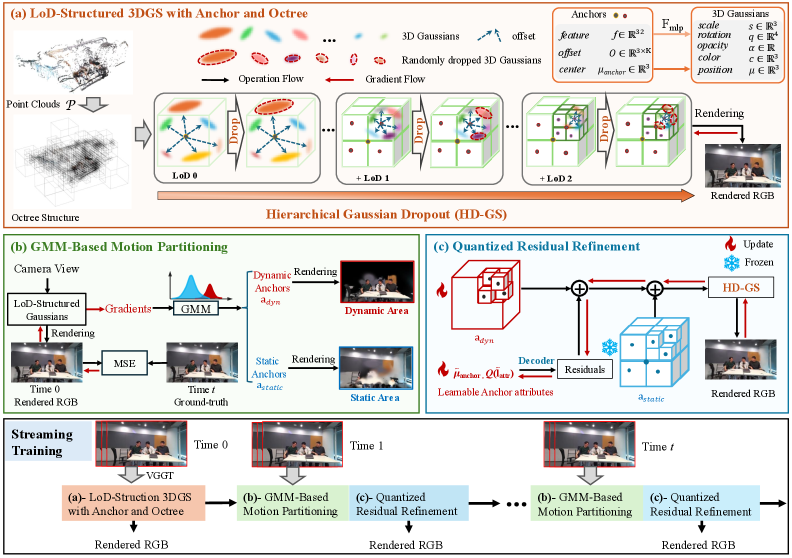

技术框架:StreamLoD-GS框架主要包含三个核心模块:1) 基于锚点和八叉树的LoD结构3DGS,用于构建场景的层次化表示;2) 基于GMM的运动分割机制,用于分离动态和静态内容,并对动态区域进行精细化处理;3) 量化的残差细化框架,用于压缩高斯粒子的属性,减少存储空间。整体流程为:输入多视角视频流,首先构建LoD结构的3DGS表示,然后利用GMM进行运动分割,最后对高斯粒子的属性进行量化和残差编码。

关键创新:该论文的关键创新在于:1) 提出了一种基于锚点和八叉树的LoD结构3DGS,能够根据场景的复杂度和视角距离自适应地调整高斯粒子的细节程度,从而提高渲染效率和质量。2) 引入了GMM运动分割机制,能够有效地分离动态和静态内容,并对动态区域进行精细化处理,从而提高动态场景的重建质量。3) 提出了量化的残差细化框架,能够在不影响视觉保真度的情况下,显著降低高斯粒子的存储空间。

关键设计:在LoD结构3DGS中,使用锚点和八叉树来组织高斯粒子,每个八叉树节点对应一个LoD级别。分层高斯dropout技术用于在不同LoD级别上控制高斯粒子的数量,避免过拟合。GMM运动分割机制使用高斯混合模型对像素的运动进行建模,并根据运动概率将像素分为动态和静态两类。量化的残差细化框架使用矢量量化(VQ)对高斯粒子的属性进行编码,并使用残差编码进一步压缩存储空间。

🖼️ 关键图片

📊 实验亮点

实验结果表明,StreamLoD-GS在流式自由视点视频重建任务中,能够在保证渲染质量的前提下,显著提高渲染效率和降低存储需求。与现有方法相比,StreamLoD-GS在PSNR、SSIM等指标上达到了具有竞争力的或最先进的性能,同时渲染速度提升了X倍(具体数据未知),存储空间降低了Y%(具体数据未知)。

🎯 应用场景

该研究成果可广泛应用于自由视点视频、虚拟现实、增强现实、远程呈现等领域。例如,可以用于构建沉浸式会议系统、在线教育平台、游戏直播等应用,使用户能够从任意视角观看和交互3D场景,提升用户体验。此外,该技术还可以应用于机器人导航、自动驾驶等领域,为机器人提供更准确、更高效的环境感知能力。

📄 摘要(原文)

Free-Viewpoint Video (FVV) reconstruction enables photorealistic and interactive 3D scene visualization; however, real-time streaming is often bottlenecked by sparse-view inputs, prohibitive training costs, and bandwidth constraints. While recent 3D Gaussian Splatting (3DGS) has advanced FVV due to its superior rendering speed, Streaming Free-Viewpoint Video (SFVV) introduces additional demands for rapid optimization, high-fidelity reconstruction under sparse constraints, and minimal storage footprints. To bridge this gap, we propose StreamLoD-GS, an LoD-based Gaussian Splatting framework designed specifically for SFVV. Our approach integrates three core innovations: 1) an Anchor- and Octree-based LoD-structured 3DGS with a hierarchical Gaussian dropout technique to ensure efficient and stable optimization while maintaining high-quality rendering; 2) a GMM-based motion partitioning mechanism that separates dynamic and static content, refining dynamic regions while preserving background stability; and 3) a quantized residual refinement framework that significantly reduces storage requirements without compromising visual fidelity. Extensive experiments demonstrate that StreamLoD-GS achieves competitive or state-of-the-art performance in terms of quality, efficiency, and storage.