Learning to Control Physically-simulated 3D Characters via Generating and Mimicking 2D Motions

作者: Jianan Li, Xiao Chen, Tao Huang, Tien-Tsin Wong

分类: cs.GR, cs.CV

发布日期: 2025-12-09

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出Mimic2DM,通过生成和模仿2D运动,学习控制物理模拟3D角色。

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion) 支柱五:交互与反应 (Interaction & Reaction) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 物理模拟 3D角色控制 2D运动模仿 Transformer 运动生成

📋 核心要点

- 现有方法依赖3D运动重建技术,但这些技术泛化性差,需要3D训练数据或无法生成物理上合理的姿势,限制了其应用。

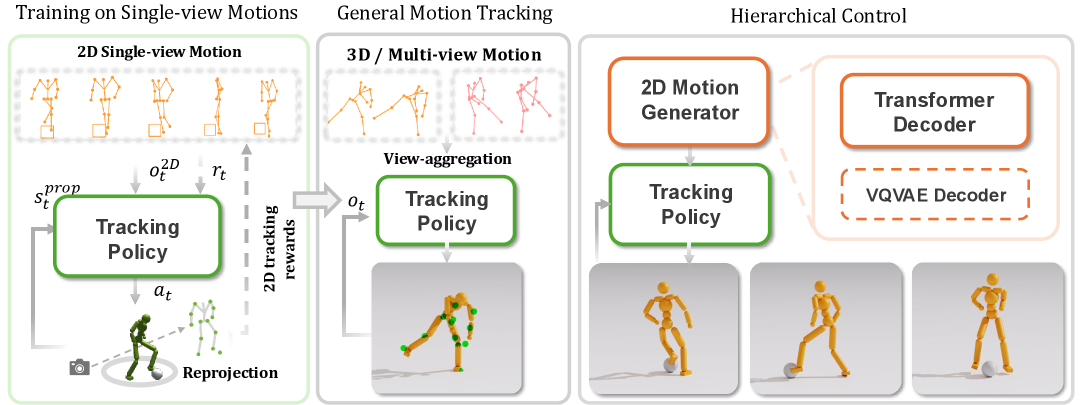

- Mimic2DM通过最小化重投影误差,直接从2D关键点轨迹学习控制策略,无需3D数据,并能聚合多视角信息提升3D运动跟踪能力。

- 该方法集成了Transformer的2D运动生成器,形成分层控制框架,能生成高质量的2D参考轨迹,有效合成各种物理上合理且多样的运动。

📝 摘要(中文)

本文提出了一种名为Mimic2DM的运动模仿框架,该框架仅从视频中提取的2D关键点轨迹学习控制策略,从而控制物理模拟的3D角色。与以往依赖3D运动重建技术的方法不同,Mimic2DM通过最小化重投影误差,训练一个通用的单视角2D运动跟踪策略,该策略能够跟踪物理模拟中任意的2D参考运动。通过在不同或略有不同的视角下捕获的各种2D运动上进行训练,该策略可以通过聚合多个视图来进一步获得3D运动跟踪能力。此外,本文还开发了一个基于Transformer的自回归2D运动生成器,并将其集成到分层控制框架中,生成高质量的2D参考轨迹来指导跟踪策略。实验结果表明,该方法具有通用性,能够有效地合成各种领域中物理上合理且多样的运动,包括舞蹈、足球运球和动物运动,而无需依赖显式的3D运动数据。

🔬 方法详解

问题定义:现有方法在学习控制物理模拟3D角色时,依赖于从视频数据中重建3D运动轨迹。然而,这些3D重建方法通常需要大量的3D训练数据,或者无法生成物理上合理的姿势,导致其泛化能力较差,难以应用于复杂场景,例如人与物体的交互或非人类角色的控制。

核心思路:Mimic2DM的核心思路是直接从2D关键点轨迹学习控制策略,避免了对3D运动数据的依赖。通过训练一个2D运动跟踪策略,使其能够跟踪物理模拟中任意的2D参考运动,从而实现对3D角色的控制。这种方法利用了广泛可用的2D视频数据,并能够通过聚合多视角信息来提升3D运动跟踪能力。

技术框架:Mimic2DM的整体框架是一个分层控制结构。首先,使用一个基于Transformer的自回归2D运动生成器生成高质量的2D参考轨迹。然后,将这些2D轨迹输入到一个2D运动跟踪策略中,该策略负责控制3D角色在物理模拟环境中跟踪这些2D轨迹。整个框架通过最小化重投影误差进行训练,使得3D角色的运动能够尽可能地逼近2D参考轨迹。

关键创新:Mimic2DM的关键创新在于它直接从2D运动数据学习控制策略,避免了对3D运动数据的依赖。此外,通过聚合多视角信息,该方法能够提升3D运动跟踪能力。与现有方法相比,Mimic2DM具有更好的泛化能力和更强的适应性,能够应用于更广泛的场景。

关键设计:2D运动生成器采用Transformer架构,能够生成高质量的2D参考轨迹。2D运动跟踪策略通过最小化重投影误差进行训练,重投影误差衡量了3D角色在物理模拟环境中的投影与2D参考轨迹之间的差异。损失函数中还包含正则化项,以保证3D角色的运动平滑性和物理合理性。具体参数设置(如Transformer层数、学习率等)根据不同任务进行调整。

🖼️ 关键图片

📊 实验亮点

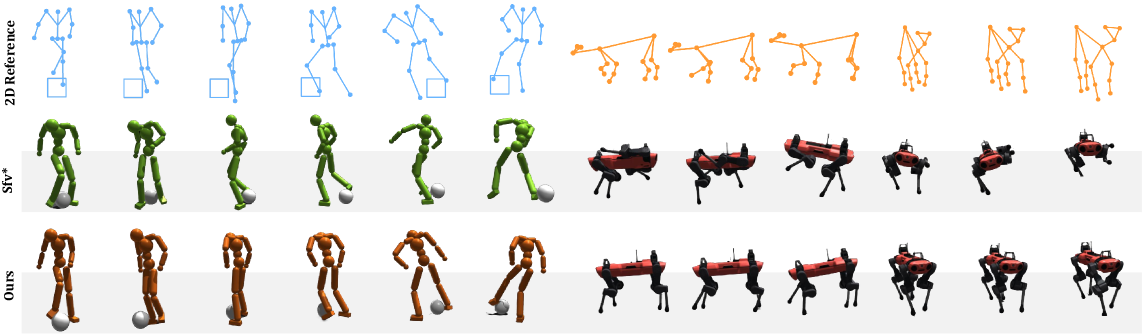

实验结果表明,Mimic2DM能够有效地合成各种领域中物理上合理且多样的运动,包括舞蹈、足球运球和动物运动。与现有方法相比,Mimic2DM在运动质量和多样性方面均有显著提升,并且无需依赖显式的3D运动数据。例如,在舞蹈动作生成任务中,Mimic2DM生成的动作更加流畅自然,更符合人类的审美。

🎯 应用场景

Mimic2DM具有广泛的应用前景,可用于游戏开发、电影制作、虚拟现实等领域。例如,可以利用该方法生成逼真的角色动画,或者控制虚拟角色进行各种复杂的运动。此外,该方法还可以应用于机器人控制领域,例如控制机器人模仿人类的动作。

📄 摘要(原文)

Video data is more cost-effective than motion capture data for learning 3D character motion controllers, yet synthesizing realistic and diverse behaviors directly from videos remains challenging. Previous approaches typically rely on off-the-shelf motion reconstruction techniques to obtain 3D trajectories for physics-based imitation. These reconstruction methods struggle with generalizability, as they either require 3D training data (potentially scarce) or fail to produce physically plausible poses, hindering their application to challenging scenarios like human-object interaction (HOI) or non-human characters. We tackle this challenge by introducing Mimic2DM, a novel motion imitation framework that learns the control policy directly and solely from widely available 2D keypoint trajectories extracted from videos. By minimizing the reprojection error, we train a general single-view 2D motion tracking policy capable of following arbitrary 2D reference motions in physics simulation, using only 2D motion data. The policy, when trained on diverse 2D motions captured from different or slightly different viewpoints, can further acquire 3D motion tracking capabilities by aggregating multiple views. Moreover, we develop a transformer-based autoregressive 2D motion generator and integrate it into a hierarchical control framework, where the generator produces high-quality 2D reference trajectories to guide the tracking policy. We show that the proposed approach is versatile and can effectively learn to synthesize physically plausible and diverse motions across a range of domains, including dancing, soccer dribbling, and animal movements, without any reliance on explicit 3D motion data. Project Website: https://jiann-li.github.io/mimic2dm/