Benchmarking Humanoid Imitation Learning with Motion Difficulty

作者: Zhaorui Meng, Lu Yin, Xinrui Chen, Anjun Chen, Shihui Guo, Yipeng Qin

分类: cs.GR

发布日期: 2025-12-08

💡 一句话要点

提出运动难度评分(MDS)以评估和改进人形模仿学习

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 人形机器人 模仿学习 运动难度评估 刚体动力学 运动技能学习

📋 核心要点

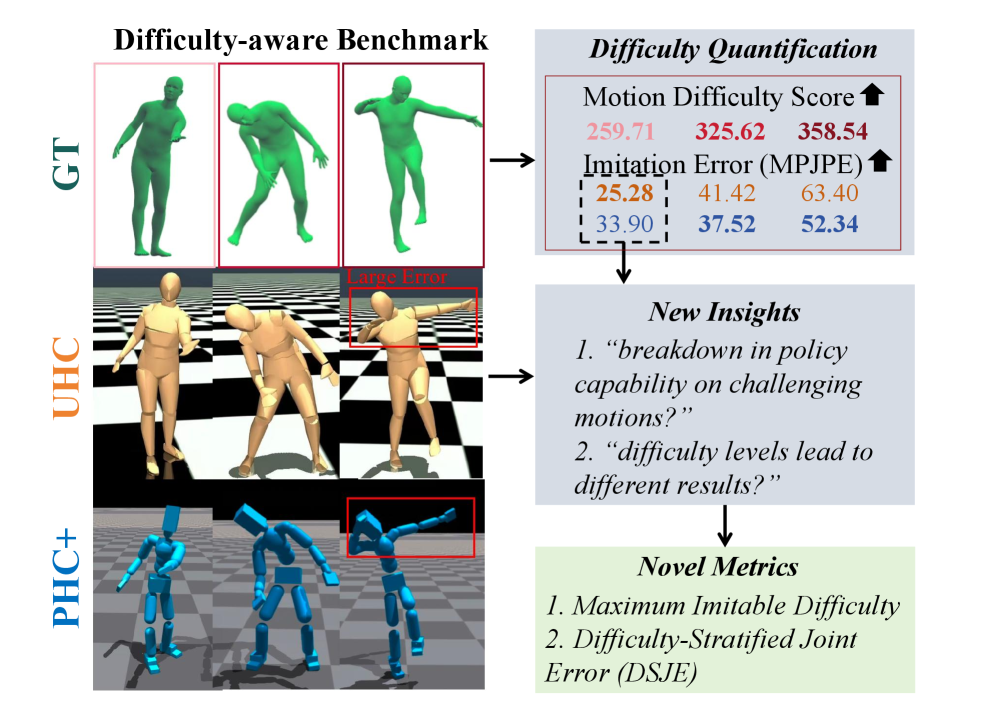

- 现有运动模仿学习评估指标忽略了运动本身的难度,导致策略性能评估不准确。

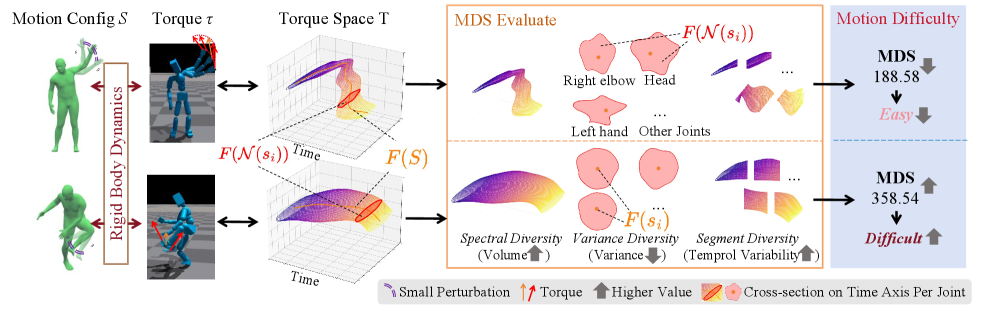

- 论文提出运动难度评分(MDS),通过分析姿势扰动引起的扭矩变化来量化运动难度。

- 实验验证了MDS的有效性,并基于MDS提出了最大可模仿难度(MID)和难度分层关节误差(DSJE)等新指标。

📝 摘要(中文)

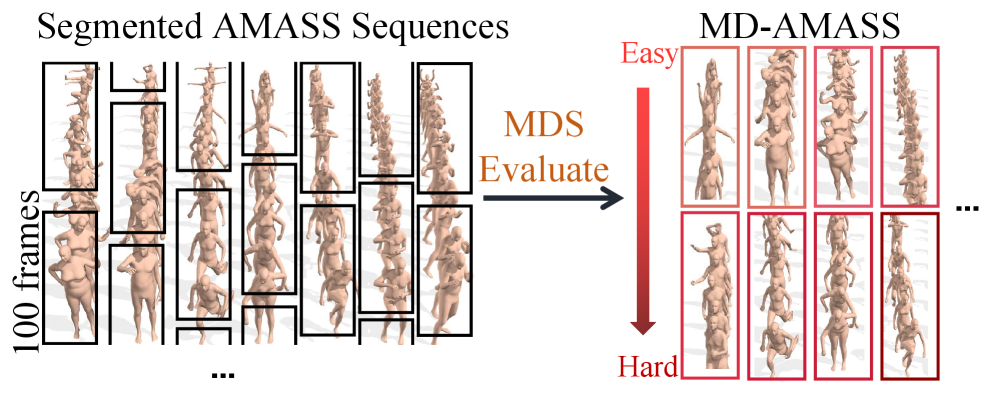

基于物理的运动模仿是人形控制的核心,但目前的评估指标(例如,关节位置误差)仅衡量策略模仿的程度,而没有衡量运动本身的难度。这会将策略性能与运动难度混淆,从而模糊了失败是源于学习效果不佳还是运动本身具有挑战性。为了解决这个问题,我们提出了运动难度评分(MDS),这是一种新颖的指标,它定义并量化了独立于策略性能的模仿难度。MDS基于刚体动力学,将难度解释为由小的姿势扰动引起的扭矩变化:较大的扭矩-姿势变化产生更平坦的奖励景观,因此学习难度更高。MDS通过扰动引起的扭矩空间的三个属性来捕获这一点:体积、方差和时间可变性。我们还使用它来构建MD-AMASS,这是一个具有难度意识的AMASS数据集重新划分。经验表明,我们通过展示MDS对最先进的运动模仿策略性能的解释能力,严格验证了MDS。我们通过两个新的基于MDS的指标进一步展示了MDS的效用:最大可模仿难度(MID)和难度分层关节误差(DSJE),从而为模仿学习提供了新的见解。

🔬 方法详解

问题定义:现有的人形运动模仿学习评估方法,如关节位置误差,仅仅关注策略模仿的精确程度,而忽略了不同运动本身所具有的难度差异。这意味着,一个策略在完成一个高难度动作时表现不佳,可能并非策略本身的问题,而是因为该动作本身就难以模仿。这种混淆使得我们难以准确评估策略的优劣,也阻碍了模仿学习的进一步发展。

核心思路:论文的核心思想是将运动难度定义为:在给定运动姿态下,对姿态进行微小扰动所引起的扭矩变化。如果一个运动的姿态对微小扰动非常敏感,即需要很大的扭矩变化才能维持姿态稳定,那么这个运动就被认为是更难模仿的。这是因为更大的扭矩-姿势变化意味着更平坦的奖励函数,从而导致更高的学习难度。

技术框架:论文提出的运动难度评分(MDS)主要通过分析扰动引起的扭矩空间来量化运动难度。具体来说,MDS考虑了扭矩空间的三个关键属性:体积(Volume)、方差(Variance)和时间可变性(Temporal Variability)。体积反映了扭矩空间的大小,方差反映了扭矩分布的离散程度,时间可变性反映了扭矩随时间的变化剧烈程度。这三个属性共同刻画了运动的难度。此外,论文还利用MDS对AMASS数据集进行了重新划分,构建了MD-AMASS,一个具有难度意识的数据集。

关键创新:论文最关键的创新在于提出了一个与策略性能无关的、基于刚体动力学的运动难度量化方法。与以往仅仅关注模仿误差的评估方法不同,MDS能够独立地评估运动本身的难度,从而更准确地评估模仿学习策略的性能。此外,基于MDS,论文还提出了最大可模仿难度(MID)和难度分层关节误差(DSJE)等新指标,为模仿学习提供了新的分析视角。

关键设计:MDS的计算涉及到对运动姿态进行微小扰动,并计算相应的扭矩变化。扰动的大小和方向需要仔细选择,以保证能够有效地反映运动的难度。扭矩空间的体积、方差和时间可变性的计算也需要采用合适的统计方法。此外,MD-AMASS数据集的构建需要根据MDS对运动进行排序和划分,以保证数据集的难度分布合理。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了MDS与最先进的运动模仿策略的性能之间存在显著的相关性,证明了MDS能够有效地预测运动的模仿难度。此外,基于MDS提出的MID和DSJE指标,能够更深入地分析模仿学习策略的性能,例如,可以发现策略在不同难度级别的运动上的表现差异。

🎯 应用场景

该研究成果可应用于人形机器人的运动技能学习、运动康复、游戏动画等领域。通过MDS可以更好地评估和选择适合机器人学习的运动,提高模仿学习的效率和质量。在运动康复领域,可以利用MDS评估患者的运动能力,并制定个性化的康复计划。在游戏动画领域,可以利用MDS生成更自然、更逼真的角色动画。

📄 摘要(原文)

Physics-based motion imitation is central to humanoid control, yet current evaluation metrics (e.g., joint position error) only measure how well a policy imitates but not how difficult the motion itself is. This conflates policy performance with motion difficulty, obscuring whether failures stem from poor learning or inherently challenging motions. In this work, we address this gap with Motion Difficulty Score (MDS), a novel metric that defines and quantifies imitation difficulty independent of policy performance. Grounded in rigid-body dynamics, MDS interprets difficulty as the torque variation induced by small pose perturbations: larger torque-to-pose variation yields flatter reward landscapes and thus higher learning difficulty. MDS captures this through three properties of the perturbation-induced torque space: volume, variance, and temporal variability. We also use it to construct MD-AMASS, a difficulty-aware repartitioning of the AMASS dataset. Empirically, we rigorously validate MDS by demonstrating its explanatory power on the performance of state-of-the-art motion imitation policies. We further demonstrate the utility of MDS through two new MDS-based metrics: Maximum Imitable Difficulty (MID) and Difficulty-Stratified Joint Error (DSJE), providing fresh insights into imitation learning.