DepthScape: Authoring 2.5D Designs via Depth Estimation, Semantic Understanding, and Geometry Extraction

作者: Xia Su, Cuong Nguyen, Matheus A. Gadelha, Jon E. Froehlich

分类: cs.HC, cs.GR

发布日期: 2025-12-01

💡 一句话要点

DepthScape:通过深度估计、语义理解和几何提取实现2.5D设计创作

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 2.5D设计 深度估计 语义理解 人机协作 视觉-语言模型

📋 核心要点

- 现有2D设计缺乏深度信息,难以实现逼真的遮挡和透视效果,导致创作过程复杂且耗时。

- DepthScape利用单目深度估计将2D图像转换为3D场景,并结合视觉-语言模型提取关键视觉元素作为锚点。

- 实验结果表明,DepthScape能够有效简化2.5D效果的创作流程,并生成高质量的设计作品。

📝 摘要(中文)

2.5D效果,例如遮挡和透视缩短,通过将3D深度线索融入2D设计中,增强了视觉动态性和真实感。然而,由于深度感知的复杂性,创建此类效果仍然具有挑战性且劳动密集。我们介绍了DepthScape,这是一种人机协作系统,通过直接将设计元素放置到3D重建中,来促进2.5D效果的创建。利用单目深度重建,DepthScape将图像转换为3D重建,视觉内容被放置其中以自动实现逼真的遮挡和透视缩短。为了进一步简化通过2D视口进行的3D放置,DepthScape使用视觉-语言模型来分析源图像,并将关键视觉组件提取为内容锚点,以进行直接操作编辑。我们通过九名具有不同设计背景的参与者评估了DepthScape,证实了我们创作流程的有效性。我们还在100张专业图库图像上进行了测试以评估鲁棒性,并进行了专家评估,证实了DepthScape结果的质量。

🔬 方法详解

问题定义:论文旨在解决2.5D设计创作中,由于缺乏深度信息而导致的设计困难问题。现有方法通常需要手动调整设计元素以模拟遮挡和透视效果,过程繁琐且需要专业技能。这使得非专业人士难以创作出具有真实感的2.5D设计作品。

核心思路:DepthScape的核心思路是利用单目深度估计技术,将2D图像转换为包含深度信息的3D场景。然后,用户可以直接在3D场景中放置设计元素,系统自动处理遮挡和透视效果,从而简化2.5D设计创作流程。同时,引入视觉-语言模型,辅助用户快速定位和操作关键视觉元素。

技术框架:DepthScape系统主要包含以下几个模块:1) 单目深度估计模块:用于将2D图像转换为3D重建;2) 视觉-语言模型模块:用于分析图像并提取关键视觉组件作为内容锚点;3) 3D场景编辑模块:允许用户在3D场景中放置和操作设计元素;4) 2.5D效果渲染模块:根据3D场景中的深度信息,自动渲染遮挡和透视效果。整个流程从输入2D图像开始,经过深度估计和语义理解,最终生成具有2.5D效果的设计作品。

关键创新:DepthScape的关键创新在于将单目深度估计和视觉-语言模型相结合,实现了一种直观、高效的2.5D设计创作流程。与传统方法相比,DepthScape无需手动调整设计元素,而是通过在3D场景中直接操作,自动生成逼真的2.5D效果。此外,视觉-语言模型的引入,使得用户可以更加方便地定位和操作图像中的关键视觉元素。

关键设计:DepthScape使用预训练的单目深度估计模型,例如DPT (Depth Prediction Transformer),来预测输入图像的深度图。视觉-语言模型采用CLIP (Contrastive Language-Image Pre-training) 或类似的模型,用于提取图像的语义信息和关键视觉组件。3D场景编辑模块采用常见的3D建模软件的交互方式,例如拖拽、缩放和旋转。2.5D效果渲染模块根据深度图和设计元素的位置,计算遮挡关系和透视缩短比例,并进行渲染。

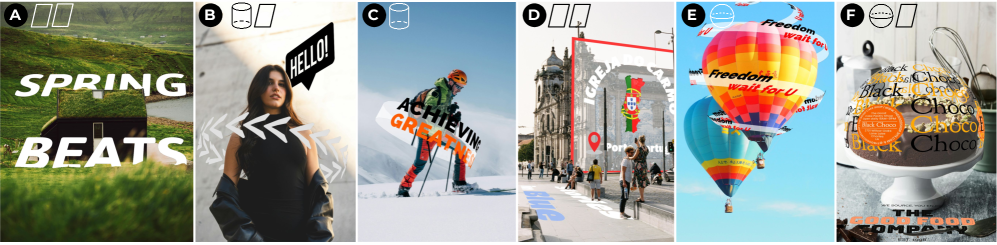

🖼️ 关键图片

📊 实验亮点

用户研究表明,DepthScape能够显著提高2.5D设计创作的效率和质量。在100张专业图库图像上的测试表明,DepthScape具有良好的鲁棒性。专家评估结果表明,DepthScape生成的2.5D设计作品具有较高的视觉质量和真实感。这些实验结果充分验证了DepthScape的有效性和实用性。

🎯 应用场景

DepthScape可应用于广告设计、游戏开发、教育内容创作等领域。它降低了2.5D设计创作的门槛,使得非专业人士也能轻松创建具有视觉冲击力的作品。未来,该技术有望集成到各种设计软件中,成为一种常用的设计工具,并促进2.5D设计在更多领域的应用。

📄 摘要(原文)

2.5D effects, such as occlusion and perspective foreshortening, enhance visual dynamics and realism by incorporating 3D depth cues into 2D designs. However, creating such effects remains challenging and labor-intensive due to the complexity of depth perception. We introduce DepthScape, a human-AI collaborative system that facilitates 2.5D effect creation by directly placing design elements into 3D reconstructions. Using monocular depth reconstruction, DepthScape transforms images into 3D reconstructions where visual contents are placed to automatically achieve realistic occlusion and perspective foreshortening. To further simplify 3D placement through a 2D viewport, DepthScape uses a vision-language model to analyze source images and extract key visual components as content anchors for direct manipulation editing. We evaluate DepthScape with nine participants of varying design backgrounds, confirming the effectiveness of our creation pipeline. We also test on 100 professional stock images to assess robustness, and conduct an expert evaluation that confirms the quality of DepthScape's results.