Procedural Scene Programs for Open-Universe Scene Generation: LLM-Free Error Correction via Program Search

作者: Maxim Gumin, Do Heon Han, Seung Jean Yoo, Aditya Ganeshan, R. Kenny Jones, Kailiang Fu, Rio Aguina-Kang, Stewart Morris, Daniel Ritchie

分类: cs.GR

发布日期: 2025-10-17

备注: To appear in SIGGRAPH Asia 2025

💡 一句话要点

提出基于程序搜索的场景程序,用于开放域场景生成,无需大型语言模型进行错误校正。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D场景生成 程序化生成 命令式编程 误差校正 开放域 场景布局 大型语言模型

📋 核心要点

- 现有3D场景布局生成方法依赖大型语言模型生成约束,计算成本高且泛化性受限。

- 提出一种命令式场景生成方法,通过迭代放置对象并计算其位置和方向来构建场景。

- 引入误差校正机制,迭代优化场景有效性,实验表明该方法优于声明式方法。

📝 摘要(中文)

本文研究了从开放词汇文本描述中合成3D场景这一具有挑战性且重要的应用。其关键子问题之一是布局生成:给定一组对象,如何布置它们以生成与输入描述匹配的场景。与近期几乎所有采用声明式范式的工作不同(使用LLM生成对象间约束规范,然后求解约束以生成最终布局),本文探索了一种替代的命令式范式,其中LLM迭代地放置对象,每个对象的位置和方向都计算为先前放置对象的函数。命令式方法允许更简单的场景规范语言,同时处理更广泛和更复杂的场景。本文还开发了一种误差校正机制,迭代地改进场景的有效性,同时尽可能接近LLM生成的原始布局,从而提高了命令式方案的鲁棒性。在强制选择感知研究中,与两种声明式布局生成方法相比,参与者更喜欢本文的命令式方法生成的布局,偏好率分别为82%和94%。本文还提出了一种简单的、自动化的3D场景布局生成评估指标,该指标与人类偏好高度一致。

🔬 方法详解

问题定义:现有3D场景布局生成方法主要采用声明式范式,即使用大型语言模型(LLM)生成对象之间的约束规范,然后通过求解这些约束来生成最终布局。这种方法依赖于LLM的强大能力,但同时也带来了计算成本高昂、泛化能力受限等问题。此外,声明式方法在处理复杂场景时,约束的定义和求解也变得非常困难。

核心思路:本文提出了一种命令式范式,其核心思想是迭代地放置对象,并将每个对象的位置和方向计算为先前放置对象的函数。这种方法避免了直接生成和求解约束,而是通过逐步构建场景的方式来实现布局生成。命令式方法允许使用更简单的场景规范语言,并且能够处理更广泛和更复杂的场景。

技术框架:该方法的技术框架主要包括以下几个阶段:1) 使用LLM生成场景描述的初始布局;2) 迭代地放置对象,每个对象的位置和方向都基于先前放置的对象进行计算;3) 引入误差校正机制,迭代地改进场景的有效性,例如避免对象之间的碰撞;4) 使用提出的自动化评估指标评估生成的场景布局。

关键创新:本文最重要的技术创新点在于提出了命令式场景生成范式,并结合误差校正机制来提高场景的有效性和鲁棒性。与现有的声明式方法相比,命令式方法避免了直接生成和求解约束,从而降低了计算成本,提高了泛化能力。此外,误差校正机制能够有效地纠正LLM生成的初始布局中的错误,从而提高场景的质量。

关键设计:误差校正机制是该方法的一个关键设计。该机制通过迭代地调整对象的位置和方向,来消除场景中的错误,例如对象之间的碰撞。为了保证误差校正过程不会过度改变原始布局,该机制在优化过程中会尽量保持对象的位置和方向与LLM生成的初始布局一致。具体的优化目标函数未知,但可以推测其包含两部分:一是场景有效性(例如,无碰撞),二是与原始布局的相似度。

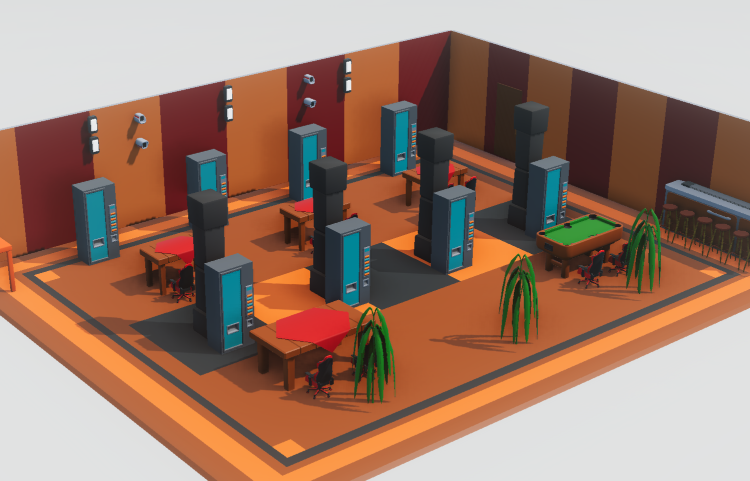

🖼️ 关键图片

📊 实验亮点

实验结果表明,与两种声明式布局生成方法相比,参与者更喜欢本文的命令式方法生成的布局,偏好率分别为82%和94%。此外,本文还提出了一种简单的、自动化的3D场景布局生成评估指标,该指标与人类偏好高度一致。这些结果表明,本文提出的方法在场景生成质量和用户体验方面都优于现有的方法。

🎯 应用场景

该研究成果可应用于虚拟现实、游戏开发、机器人导航等领域。通过文本描述自动生成逼真的3D场景,可以降低场景创建的成本,提高效率。例如,在虚拟现实游戏中,可以根据玩家的描述动态生成游戏场景,从而提供更加个性化的游戏体验。在机器人导航领域,可以利用该技术生成各种复杂的环境,用于训练机器人的导航能力。

📄 摘要(原文)

Synthesizing 3D scenes from open-vocabulary text descriptions is a challenging, important, and recently-popular application. One of its critical subproblems is layout generation: given a set of objects, lay them out to produce a scene matching the input description. Nearly all recent work adopts a declarative paradigm for this problem: using an LLM to generate a specification of constraints between objects, then solving those constraints to produce the final layout. In contrast, we explore an alternative imperative paradigm, in which an LLM iteratively places objects, with each object's position and orientation computed as a function of previously-placed objects. The imperative approach allows for a simpler scene specification language while also handling a wider variety and larger complexity of scenes. We further improve the robustness of our imperative scheme by developing an error correction mechanism that iteratively improves the scene's validity while staying as close as possible to the original layout generated by the LLM. In forced-choice perceptual studies, participants preferred layouts generated by our imperative approach 82% and 94% of the time when compared against two declarative layout generation methods. We also present a simple, automated evaluation metric for 3D scene layout generation that aligns well with human preferences.