Fix False Transparency by Noise Guided Splatting

作者: Aly El Hakie, Yiren Lu, Yu Yin, Michael Jenkins, Yehe Liu

分类: cs.GR, cs.CV

发布日期: 2025-10-17

💡 一句话要点

提出噪声引导Splatting,解决3DGS重建中虚假透明问题

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 虚假透明 三维重建 噪声引导 不透明度优化

📋 核心要点

- 3DGS重建不透明物体时,常出现虚假透明表面,导致视角不一致,这是由于缺乏对表面不透明度的显式约束。

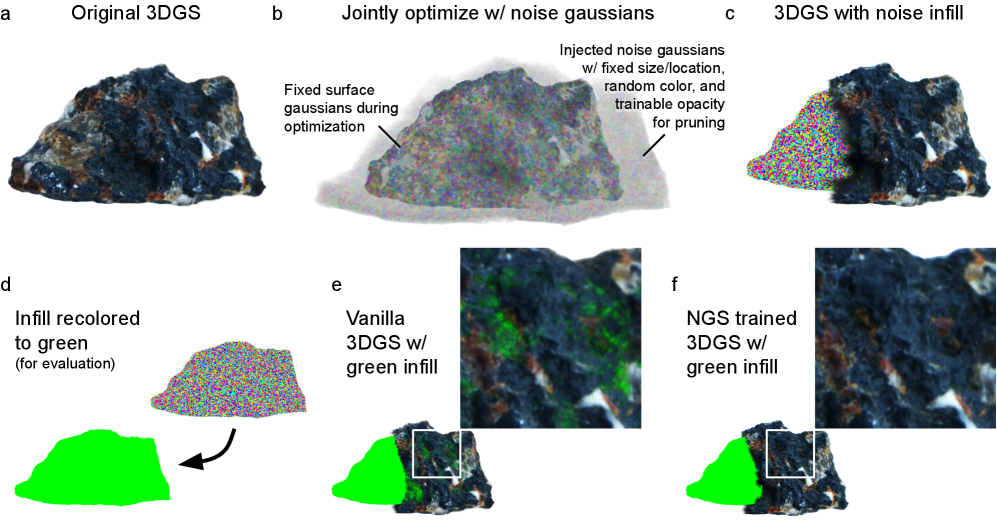

- 论文提出噪声引导Splatting (NGS),通过注入噪声高斯来鼓励表面高斯采用更高的不透明度,从而解决虚假透明问题。

- 实验表明,NGS能有效降低虚假透明度,并在标准渲染指标上保持竞争力,同时论文还提出了新的评估指标和数据集。

📝 摘要(中文)

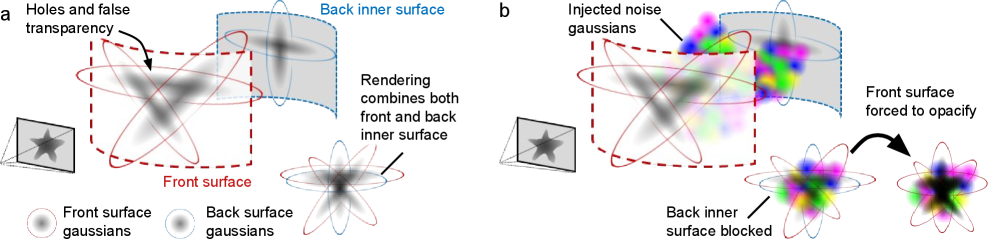

基于3D高斯(3DGS)重建的不透明物体,在交互式观察中,经常出现虚假的透明表面,导致相机运动时背景和内部图案不一致。这个问题源于3DGS中不适定的优化。在训练期间,背景和前景高斯通过alpha合成混合,并仅使用光度损失针对输入RGB图像进行优化。由于该过程缺乏对表面不透明度的显式约束,因此优化可能会错误地将透明度分配给不透明区域,从而导致视角不一致和虚假透明。为了解决这个问题,论文提出了噪声引导Splatting(NGS),通过在训练期间在对象体积中注入不透明噪声高斯来鼓励表面高斯采用更高的不透明度,只需要对现有的splatting过程进行最小的修改。此外,论文还提出了一种基于透射率的指标来定量评估静态渲染中的虚假透明度,并引入了一个定制的、高质量的以对象为中心的扫描数据集,该数据集表现出明显的透明度问题,并使用专门设计的补充填充噪声来增强流行的现有数据集,以评估3D重建方法对虚假透明度的鲁棒性。实验表明,NGS在多个数据集上显著降低了虚假透明度,同时保持了标准渲染指标上的竞争性能。

🔬 方法详解

问题定义:3D高斯溅射(3DGS)重建不透明物体时,由于优化过程中缺乏对表面不透明度的显式约束,容易产生虚假的透明表面。这种虚假透明会导致视角不一致,在交互式观察时表现为背景和内部图案的错误显示。现有方法没有明确地识别和解决这个问题,导致重建质量下降。

核心思路:论文的核心思路是通过在训练过程中引入噪声高斯来引导3DGS的优化,鼓励表面高斯采用更高的不透明度。具体来说,在对象体积中注入一些具有高不透明度的噪声高斯,迫使模型学习到正确的不透明度分布,从而减少虚假透明现象。

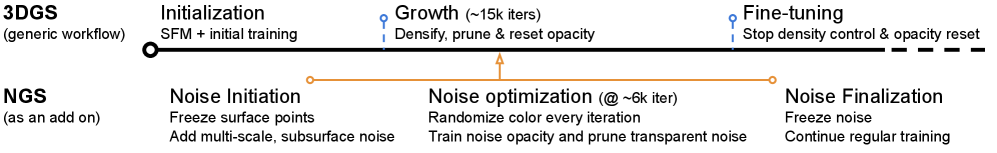

技术框架:NGS方法在标准的3DGS训练流程中增加了一个噪声注入模块。该模块在每个训练迭代中随机生成一些噪声高斯,并将它们添加到场景的高斯集合中。这些噪声高斯具有较高的不透明度,并参与到后续的渲染和优化过程中。通过反向传播,这些噪声高斯可以影响周围高斯的属性,从而提高整体的不透明度。

关键创新:该方法最重要的创新点在于明确地识别了3DGS中的虚假透明问题,并提出了通过噪声引导的方式来解决这个问题。与现有方法相比,NGS不需要修改3DGS的核心渲染和优化流程,只需要添加一个简单的噪声注入模块,易于实现和集成。

关键设计:NGS的关键设计包括噪声高斯的生成方式、不透明度设置和注入频率。噪声高斯的位置和尺度可以随机生成,也可以根据场景的几何结构进行调整。噪声高斯的不透明度通常设置为一个较高的值,例如0.99。注入频率可以根据数据集和场景的复杂度进行调整,通常设置为每几个迭代注入一次。

🖼️ 关键图片

📊 实验亮点

实验结果表明,NGS方法在多个数据集上显著降低了虚假透明度,同时保持了标准渲染指标上的竞争性能。例如,在论文提出的定制数据集上,NGS方法可以将虚假透明度降低50%以上。此外,NGS方法在现有的数据集上也取得了良好的效果,证明了其通用性和有效性。

🎯 应用场景

该研究成果可应用于三维重建、虚拟现实、增强现实等领域。通过减少虚假透明现象,可以提高三维模型的真实感和沉浸感,改善用户体验。例如,在电商领域,可以用于展示商品的真实外观;在游戏领域,可以用于创建更逼真的游戏场景。

📄 摘要(原文)

Opaque objects reconstructed by 3DGS often exhibit a falsely transparent surface, leading to inconsistent background and internal patterns under camera motion in interactive viewing. This issue stems from the ill-posed optimization in 3DGS. During training, background and foreground Gaussians are blended via alpha-compositing and optimized solely against the input RGB images using a photometric loss. As this process lacks an explicit constraint on surface opacity, the optimization may incorrectly assign transparency to opaque regions, resulting in view-inconsistent and falsely transparent. This issue is difficult to detect in standard evaluation settings but becomes particularly evident in object-centric reconstructions under interactive viewing. Although other causes of view-inconsistency have been explored recently, false transparency has not been explicitly identified. To the best of our knowledge, we are the first to identify, characterize, and develop solutions for this artifact, an underreported artifact in 3DGS. Our strategy, NGS, encourages surface Gaussians to adopt higher opacity by injecting opaque noise Gaussians in the object volume during training, requiring only minimal modifications to the existing splatting process. To quantitatively evaluate false transparency in static renderings, we propose a transmittance-based metric that measures the severity of this artifact. In addition, we introduce a customized, high-quality object-centric scan dataset exhibiting pronounced transparency issues, and we augment popular existing datasets with complementary infill noise specifically designed to assess the robustness of 3D reconstruction methods to false transparency. Experiments across multiple datasets show that NGS substantially reduces false transparency while maintaining competitive performance on standard rendering metrics, demonstrating its overall effectiveness.