Two-Stage Gaussian Splatting Optimization for Outdoor Scene Reconstruction

作者: Deborah Pintani, Ariel Caputo, Noah Lewis, Marc Stamminger, Fabio Pellacini, Andrea Giachetti

分类: cs.GR

发布日期: 2025-10-10

💡 一句话要点

提出双阶段高斯溅射优化框架,提升户外场景重建质量。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 高斯溅射 户外场景重建 新视角合成 双阶段优化 背景分离 几何正则化 环境地图估计

📋 核心要点

- 现有户外场景重建方法难以处理远近景细节差异大、光照不均等问题。

- 提出双阶段高斯溅射优化框架,分别优化背景和前景,提升重建质量。

- 实验表明,该方法能有效减少背景伪影,提升感知质量,并可用于环境地图估计。

📝 摘要(中文)

户外场景重建面临着近处纹理丰富区域与远处低细节背景、不均匀光照和天空效果之间的巨大对比挑战。本文提出了一种双阶段高斯溅射框架,显式地分离和优化这些区域,从而实现更高保真度的新视角合成。在第一阶段,背景图元在球形壳内初始化,并使用结合了仅背景光度项与两个几何正则化项的损失函数进行优化:一个约束高斯保持在壳内,另一个使其与局部切平面对齐。在第二阶段,前景高斯从运动结构重建中初始化,添加并使用标准渲染损失进行细化,而背景集保持固定但对最终图像形成做出贡献。在各种户外数据集上的实验表明,与最先进的基线相比,该方法减少了背景伪影并提高了感知质量。此外,显式的背景分离能够实现自动的、无对象的环境地图估计,为逼真的户外渲染和混合现实应用开辟了新的可能性。

🔬 方法详解

问题定义:户外场景重建,特别是新视角合成,面临着远近景细节差异巨大、光照不均匀以及天空效果等挑战。现有的方法难以有效地处理这些问题,导致重建质量下降,尤其是在背景区域容易出现伪影。这些问题限制了户外场景重建在真实感渲染和混合现实等领域的应用。

核心思路:本文的核心思路是将户外场景显式地分离为前景和背景,并采用双阶段优化策略。通过分别优化背景和前景,可以更好地处理它们各自的特点,从而提高整体的重建质量。背景使用球形壳初始化并进行几何约束,前景则从SfM结果初始化并进行渲染优化。这种分离优化策略能够更有效地利用数据,减少伪影,并提高感知质量。

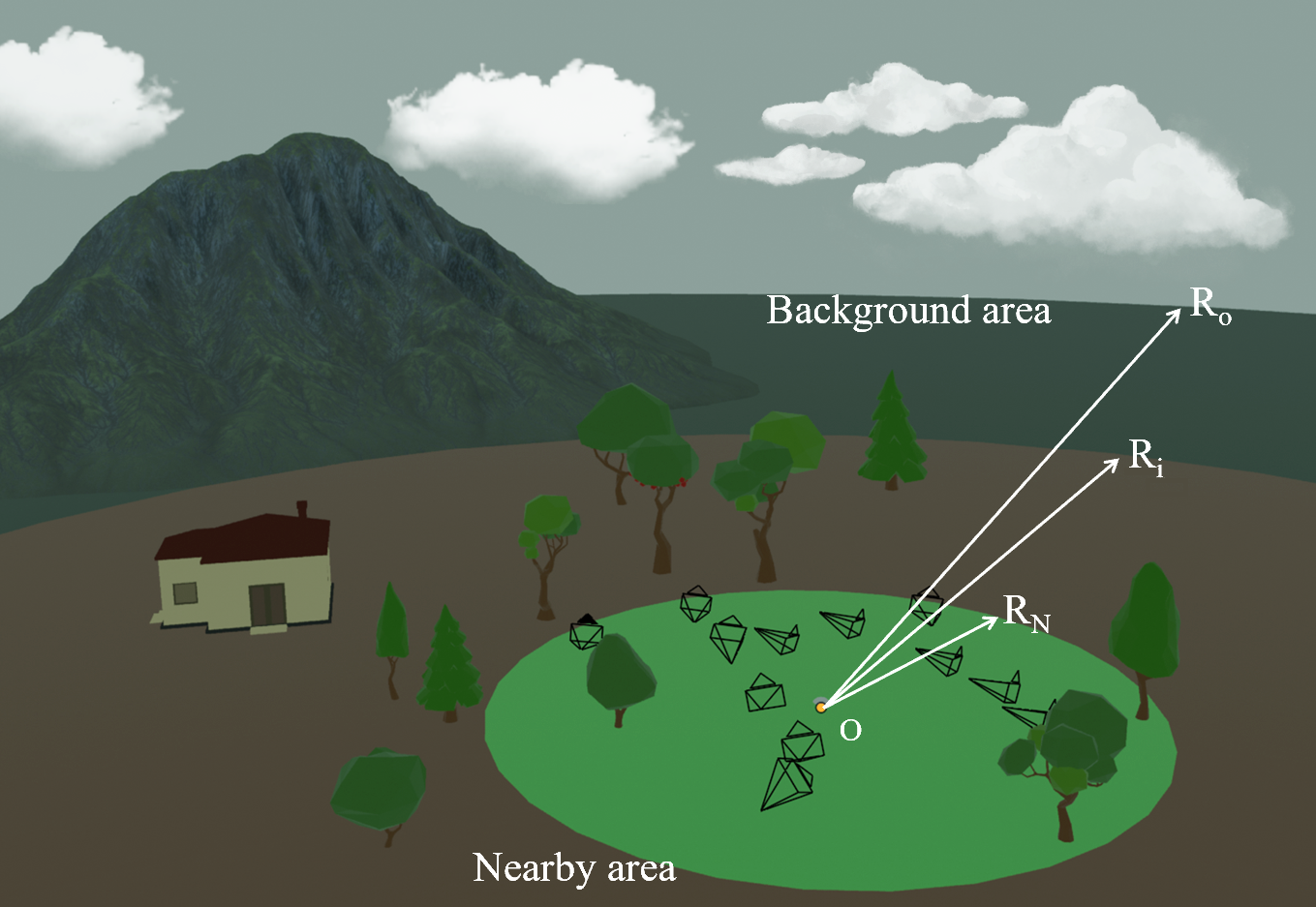

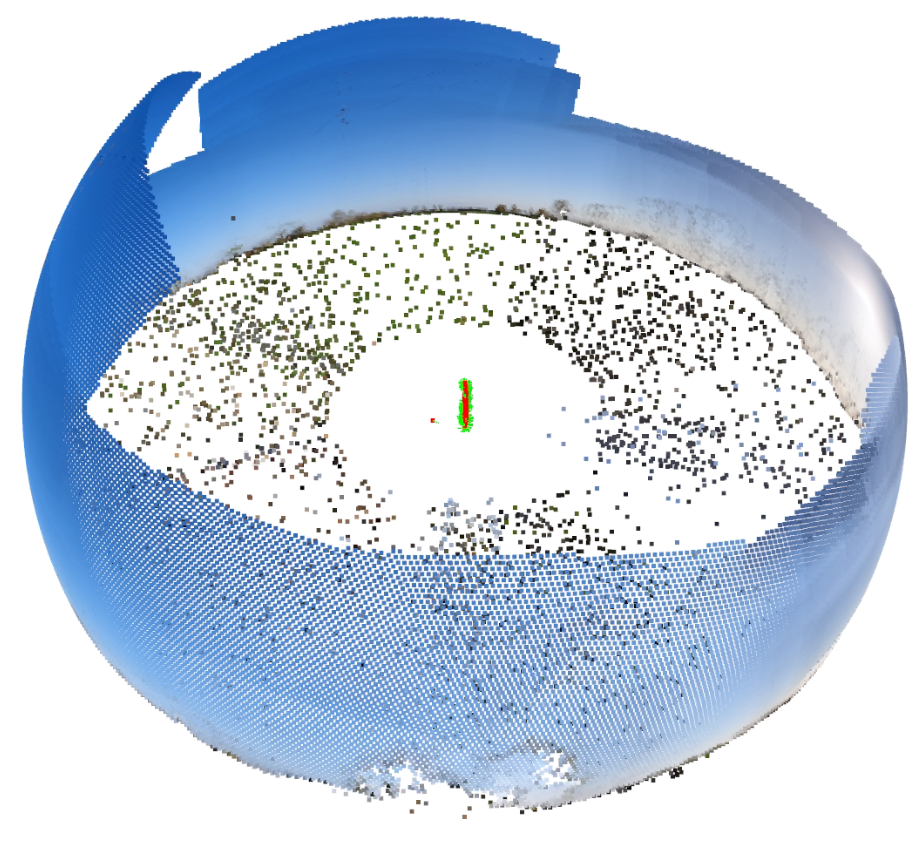

技术框架:该方法包含两个主要阶段: 1. 背景优化阶段:首先,在球形壳内初始化背景高斯图元。然后,使用一个损失函数来优化这些图元,该损失函数结合了仅背景光度项以及两个几何正则化项。这两个几何正则化项分别用于约束高斯保持在球形壳内,以及使其与局部切平面对齐。 2. 前景优化阶段:从运动结构(Structure-from-Motion, SfM)重建中初始化前景高斯图元。然后,添加这些图元并使用标准的渲染损失进行细化。在这个阶段,背景高斯图元保持固定,但仍然参与最终图像的渲染。

关键创新:该方法最重要的创新点在于显式地分离和优化背景和前景。这种分离优化策略能够更有效地处理户外场景中远近景细节差异大、光照不均匀等问题。此外,通过对背景进行几何约束,可以减少背景伪影,提高重建质量。显式背景分离还使得自动环境光照估计成为可能。

关键设计: * 背景初始化:使用球形壳初始化背景高斯图元,能够有效地覆盖整个背景区域。 * 几何正则化:使用两个几何正则化项来约束背景高斯图元,分别保证其位于球形壳内,并与局部切平面对齐。这有助于减少背景伪影。 * 损失函数:损失函数结合了仅背景光度项以及几何正则化项,能够有效地优化背景高斯图元。 * 双阶段优化:通过双阶段优化,分别优化背景和前景,能够更好地处理它们各自的特点。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在多个户外数据集上均优于现有技术,能够有效减少背景伪影,提高感知质量。与现有方法相比,该方法在重建质量和渲染效果上均有显著提升。此外,该方法还能够自动估计环境地图,为户外场景渲染提供了新的可能性。

🎯 应用场景

该研究成果可广泛应用于户外场景的真实感渲染、混合现实、虚拟现实、自动驾驶等领域。通过高质量的户外场景重建,可以为这些应用提供更逼真的环境和更准确的场景理解,从而提升用户体验和系统性能。此外,自动环境地图估计功能可以进一步简化户外场景的渲染流程,降低开发成本。

📄 摘要(原文)

Outdoor scene reconstruction remains challenging due to the stark contrast between well-textured, nearby regions and distant backgrounds dominated by low detail, uneven illumination, and sky effects. We introduce a two-stage Gaussian Splatting framework that explicitly separates and optimizes these regions, yielding higher-fidelity novel view synthesis. In stage one, background primitives are initialized within a spherical shell and optimized using a loss that combines a background-only photometric term with two geometric regularizers: one constraining Gaussians to remain inside the shell, and another aligning them with local tangential planes. In stage two, foreground Gaussians are initialized from a Structure-from-Motion reconstruction, added and refined using the standard rendering loss, while the background set remains fixed but contributes to the final image formation. Experiments on diverse outdoor datasets show that our method reduces background artifacts and improves perceptual quality compared to state-of-the-art baselines. Moreover, the explicit background separation enables automatic, object-free environment map estimation, opening new possibilities for photorealistic outdoor rendering and mixed-reality applications.