Capture and Interact: Rapid 3D Object Acquisition and Rendering with Gaussian Splatting in Unity

作者: Islomjon Shukhratov, Sergey Gorinsky

分类: cs.GR, cs.CV

发布日期: 2025-10-08

💡 一句话要点

提出基于3D高斯溅射的快速3D物体获取与Unity实时渲染管线

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 实时渲染 移动端扫描 云端重建 Unity引擎 增强现实 数字孪生

📋 核心要点

- 实时捕获和渲染3D物体仍然面临挑战,现有方法在速度和交互性上存在不足,限制了其在AR、数字孪生等领域的应用。

- 论文提出利用3D高斯溅射技术,构建移动端扫描、云端重建和本地实时渲染的端到端管线,实现快速3D物体获取与交互。

- 实验结果表明,该管线能够在10分钟内完成物体扫描和重建,并在笔记本电脑上以150fps的速度进行实时渲染。

📝 摘要(中文)

本文提出了一种端到端的管线,利用3D高斯溅射(3D GS)实现真实世界物体的快速获取和交互式渲染。该管线使用移动设备、云处理和本地计算机,用户通过智能手机视频扫描物体,上传进行自动3D重建,然后在Unity中以平均150帧/秒(fps)的速度进行交互式可视化。该系统集成了移动捕获、基于云的3D GS和Unity渲染,以支持实时远程呈现。实验表明,该管线在图形处理器(GPU)上大约10分钟内处理扫描,并在笔记本电脑上实现实时渲染。

🔬 方法详解

问题定义:现有3D物体重建和渲染方法通常计算复杂度高,难以在移动设备和消费级硬件上实现实时交互。尤其是在增强现实、数字孪生等需要快速反馈的应用场景中,对3D重建和渲染的速度提出了更高的要求。因此,如何快速获取并实时渲染3D物体是一个重要的研究问题。

核心思路:论文的核心思路是利用3D高斯溅射(3D GS)技术,它是一种基于点的表示方法,相比于传统的网格或体素表示,具有更快的渲染速度和更高的渲染质量。通过结合移动端扫描、云端处理和本地渲染,实现端到端的快速3D物体获取与交互。

技术框架:该系统包含三个主要阶段:1) 移动端扫描:使用智能手机或其他移动设备捕获物体的视频序列。2) 云端3D重建:将视频上传到云端服务器,利用3D GS算法进行自动3D重建。3) 本地实时渲染:将重建后的3D模型下载到本地计算机,并在Unity引擎中进行实时渲染和交互。

关键创新:该论文的关键创新在于将3D高斯溅射技术应用于移动端3D物体获取和实时渲染,并构建了一个完整的端到端管线。与传统的基于网格或体素的重建方法相比,3D GS具有更快的渲染速度和更高的渲染质量,能够更好地满足实时交互的需求。

关键设计:论文中没有详细描述具体的参数设置、损失函数或网络结构。但可以推断,3D GS重建过程可能涉及相机位姿估计、高斯参数优化等步骤。在Unity渲染阶段,可能需要针对高斯溅射的特性进行优化,以实现更高的渲染效率。

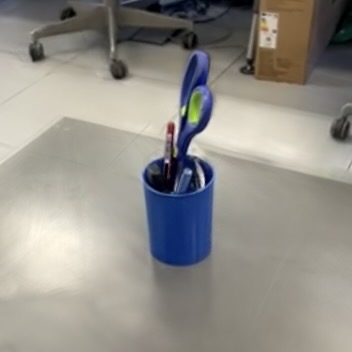

🖼️ 关键图片

📊 实验亮点

实验结果表明,该管线能够在GPU上大约10分钟内处理扫描数据,并在笔记本电脑上实现平均150帧/秒的实时渲染。这一性能表现优于传统的基于网格或体素的重建和渲染方法,为实时3D物体获取和交互提供了有力的支持。该系统在Unity中的实时渲染能力是其关键亮点。

🎯 应用场景

该研究成果可广泛应用于增强现实、数字孪生系统、远程协作和原型设计等领域。例如,用户可以使用手机扫描真实世界的物体,快速生成3D模型,并在AR应用中进行交互。此外,该技术还可以用于远程协作,实现实时3D物体共享和操作,提高协作效率。在原型设计方面,可以快速创建和修改3D模型,加速产品开发过程。

📄 摘要(原文)

Capturing and rendering three-dimensional (3D) objects in real time remain a significant challenge, yet hold substantial potential for applications in augmented reality, digital twin systems, remote collaboration and prototyping. We present an end-to-end pipeline that leverages 3D Gaussian Splatting (3D GS) to enable rapid acquisition and interactive rendering of real-world objects using a mobile device, cloud processing and a local computer. Users scan an object with a smartphone video, upload it for automated 3D reconstruction, and visualize it interactively in Unity at an average of 150 frames per second (fps) on a laptop. The system integrates mobile capture, cloud-based 3D GS and Unity rendering to support real-time telepresence. Our experiments show that the pipeline processes scans in approximately 10 minutes on a graphics processing unit (GPU) achieving real-time rendering on the laptop.