Enhancing Foveated Rendering with Weighted Reservoir Sampling

作者: Ville Cantory, Darya Biparva, Haoyu Tan, Tongyu Nie, John Schroeder, Ruofei Du, Victoria Interrante, Piotr Didyk

分类: cs.GR

发布日期: 2025-10-04

备注: To appear in The 18th ACM SIGGRAPH Conference on Motion, Interaction, and Games (MIG '25), December 03-05, 2025, Zurich, Switzerland

💡 一句话要点

提出加权水库抽样增强注视点渲染,提升视觉质量并降低计算成本

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 注视点渲染 加权水库抽样 时序渲染 VR/AR 低功耗渲染

📋 核心要点

- 传统注视点渲染在高注视程度下会损失大量高频信息,导致视觉质量下降,且忽略了帧间信息。

- 利用人眼扫视特性,将帧间像素呈现视为数据流的随机抽样问题,采用加权水库抽样维护高质量像素样本。

- 该方法高效且易于集成,能在保证视觉质量的同时,进一步降低注视点渲染的计算成本,适用于VR/AR。

📝 摘要(中文)

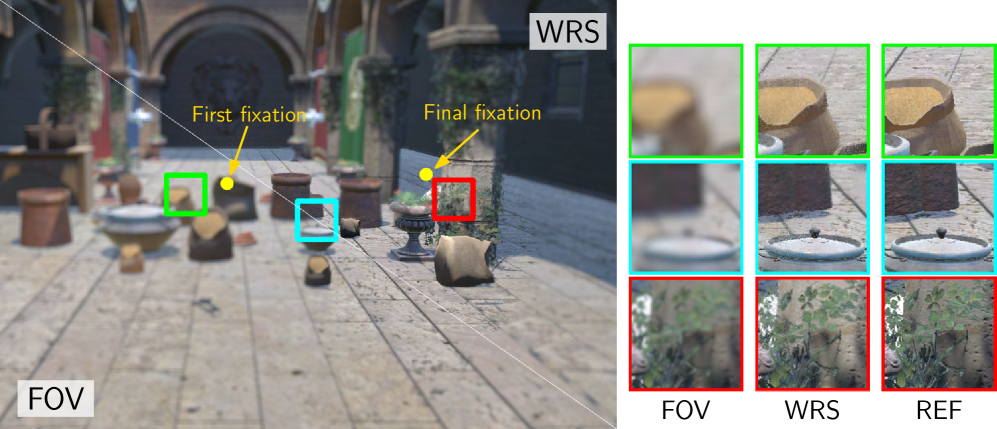

本文提出了一种利用加权水库抽样技术来增强注视点渲染的方法。注视点渲染通过降低周边视觉区域的分辨率来减少渲染成本。然而,随着注视程度的增加,渲染质量会降低,且传统方法无法保留先前帧中以高分辨率渲染的样本。考虑到人眼扫视的特性,以及帧间像素呈现的随机抽样特性,我们利用加权水库抽样来维护一个高质量像素样本库,并将其融入当前帧的计算中。这使得渲染器能够通过时序复用像素样本来重建更高质量的图像,同时允许更高的注视程度。该方法在4K分辨率下运行时间小于1毫秒,易于与实时VR和AR注视点渲染系统集成。

🔬 方法详解

问题定义:注视点渲染旨在通过降低周边视觉区域的分辨率来减少计算负担。然而,当注视程度较高时,图像质量会显著下降,尤其是在快速运动或复杂场景中。此外,传统的注视点渲染方法通常不考虑时间上的连贯性,即无法有效地利用先前帧中渲染的高质量像素信息,导致信息丢失和闪烁等问题。

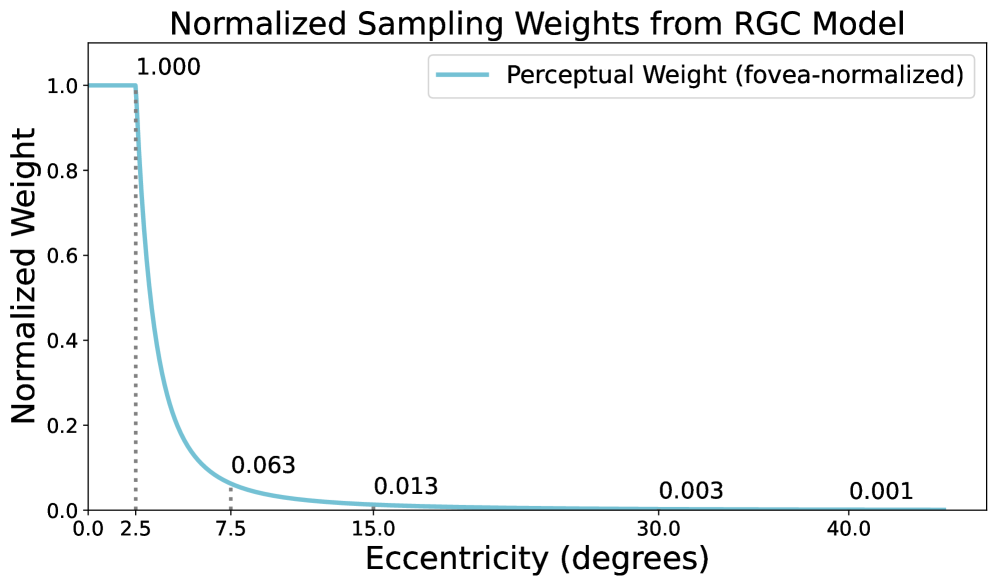

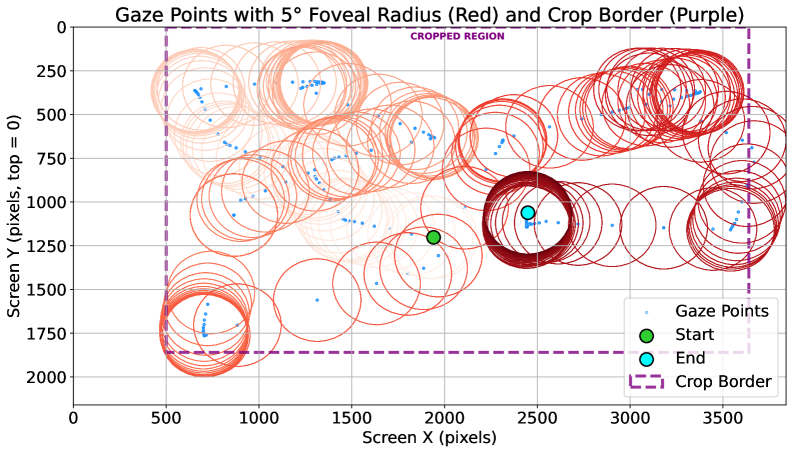

核心思路:论文的核心思路是将帧间像素的呈现过程视为一个数据流的随机抽样问题。利用人眼扫视的特性,即使在注视期间,眼睛也会进行微小的扫视运动,这意味着在相邻帧中,注视点的位置略有不同。因此,可以从时间相邻的帧中采样,以减少当前帧需要渲染的注视区域的大小,同时提高感知图像质量。通过维护一个包含高质量像素样本的“水库”,并在每一帧中根据像素的重要性进行加权抽样,可以有效地利用历史信息来重建当前帧的图像。

技术框架:该方法主要包含以下几个阶段:1) 现有的注视点渲染器生成初始的低分辨率图像。2) 加权水库抽样模块,该模块维护一个像素样本库,并根据像素的质量(例如,分辨率、清晰度)和时间衰减因子进行加权。3) 在每一帧中,该模块从水库中抽取一定数量的像素样本,并将其与当前帧的像素进行融合,以提高图像质量。4) 最后,将融合后的图像显示给用户。

关键创新:该方法的关键创新在于将加权水库抽样技术应用于注视点渲染。与传统的注视点渲染方法相比,该方法能够有效地利用时间上的连贯性,保留先前帧中渲染的高质量像素信息,从而提高图像质量。此外,通过加权抽样,可以优先选择更重要的像素样本,进一步提高渲染效率。

关键设计:加权水库抽样的权重计算是关键。权重通常基于像素的分辨率、清晰度以及时间衰减因子。时间衰减因子用于降低旧像素样本的权重,以反映场景的变化。具体来说,可以使用指数衰减函数,例如 w(t) = exp(-λt),其中 λ 是衰减率,t 是像素样本的年龄。此外,水库的大小也是一个重要的参数,需要根据具体的应用场景进行调整。更大的水库可以存储更多的像素样本,但也会增加计算负担。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法能够在4K分辨率下以小于1毫秒的运行时间实现,并且能够显著提高注视点渲染的图像质量。与传统的注视点渲染方法相比,该方法能够在相同的渲染预算下,提供更清晰、更逼真的视觉体验。具体的性能提升数据(如PSNR、SSIM等)在论文中进行了详细的展示。

🎯 应用场景

该技术可广泛应用于VR/AR头显、移动设备等需要低功耗、高画质渲染的场景。通过降低渲染负担,可以延长移动设备的电池续航时间,并提高VR/AR应用的沉浸感。此外,该技术还可应用于云游戏、远程渲染等领域,通过降低传输带宽需求,提高用户体验。

📄 摘要(原文)

Spatiotemporal sensitivity to high frequency information declines with increased peripheral eccentricity. Foveated rendering exploits this by decreasing the spatial resolution of rendered images in peripheral vision, reducing the rendering cost by omitting high frequency details. As foveation levels increase, the rendering quality is reduced, and traditional foveated rendering systems tend not to preserve samples that were previously rendered at high spatial resolution in previous frames. Additionally, prior research has shown that saccade landing positions are distributed around a target location rather than landing at a single point, and that even during fixations, eyes perform small microsaccades around a fixation point. This creates an opportunity for sampling from temporally neighbouring frames with differing foveal locations to reduce the required rendered size of the foveal region while achieving a higher perceived image quality. We further observe that the temporal presentation of pixels frame-to-frame can be viewed as a data stream, presenting a random sampling problem. Following this intuition, we propose a Weighted Reservoir Sampling technique to efficiently maintain a reservoir of the perceptually relevant high quality pixel samples from previous frames and incorporate them into the computation of the current frame. This allows the renderer to render a smaller region of foveal pixels per frame by temporally reusing pixel samples that are still relevant to reconstruct a higher perceived image quality, while allowing for higher levels of foveation. Our method operates on the output of foveated rendering, and runs in under 1\,ms at 4K resolution, making it highly efficient and integrable with real-time VR and AR foveated rendering systems.