GaussEdit: Adaptive 3D Scene Editing with Text and Image Prompts

作者: Zhenyu Shu, Junlong Yu, Kai Chao, Shiqing Xin, Ligang Liu

分类: cs.GR, cs.CV, cs.LG

发布日期: 2025-09-30

期刊: IEEE Transactions on Visualization and Computer Graphics. 2025

DOI: 10.1109/TVCG.2025.3556745

💡 一句话要点

GaussEdit:基于文本和图像提示的自适应3D场景编辑框架

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D场景编辑 高斯溅射 文本图像提示 自适应优化 图像合成

📋 核心要点

- 现有3D场景编辑方法在精度、真实性和效率方面存在不足,难以实现用户精确控制和高质量编辑。

- GaussEdit利用3D高斯溅射表示场景,结合自适应优化策略和图像合成技术,实现高效、精确和真实的3D场景编辑。

- 实验表明,GaussEdit在编辑精度、视觉保真度和处理速度上超越现有方法,能够有效嵌入用户指定的概念。

📝 摘要(中文)

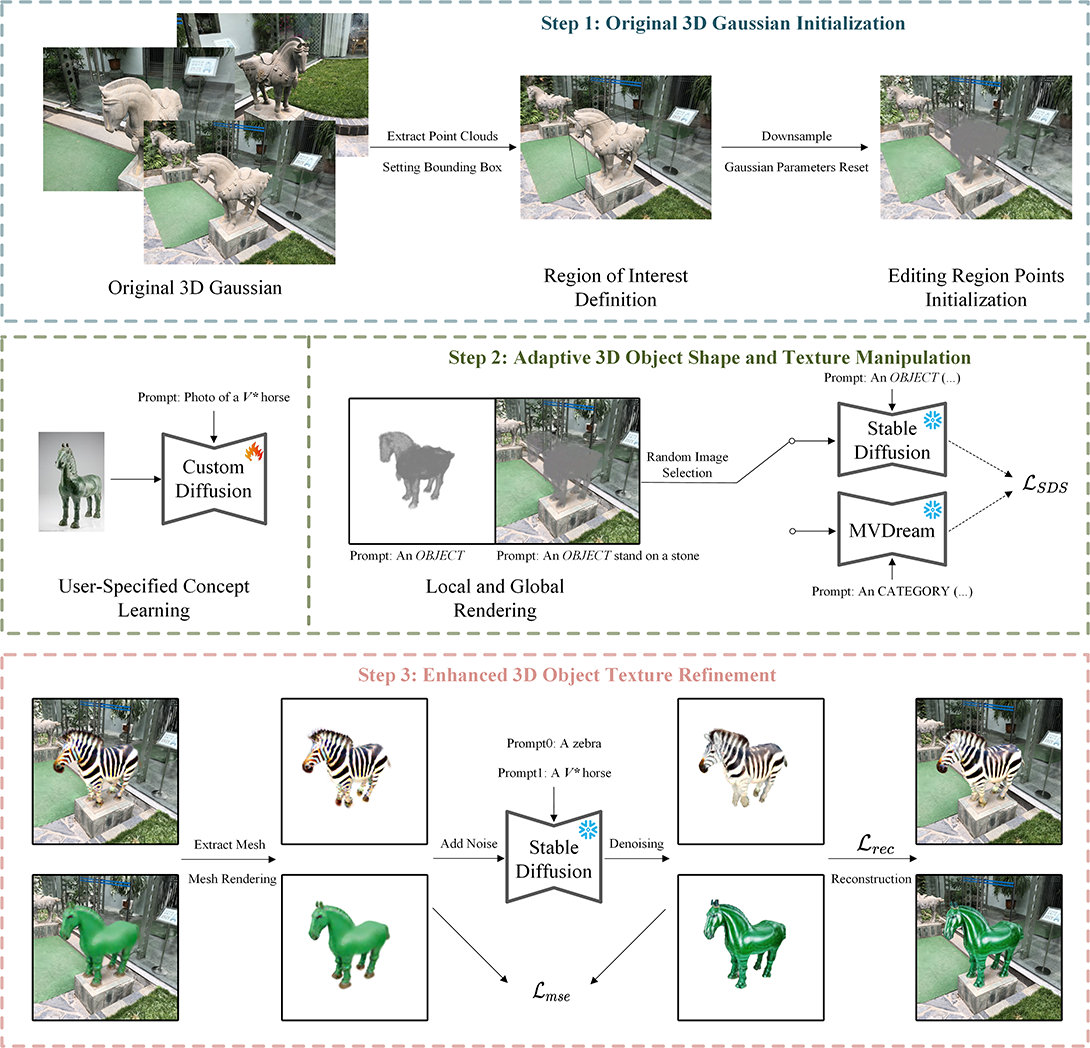

本文提出了一种名为GaussEdit的框架,用于在文本和图像提示的引导下进行自适应3D场景编辑。GaussEdit利用3D高斯溅射作为场景表示的骨干,从而能够方便地选择感兴趣区域,并通过一个三阶段过程实现高效编辑。第一阶段涉及初始化3D高斯,以确保高质量的编辑效果。第二阶段采用自适应全局-局部优化策略,以平衡全局场景一致性和详细的局部编辑,并采用类别引导的正则化技术来缓解Janus问题。最后阶段使用复杂的图像到图像合成技术来增强编辑对象的纹理,确保结果在视觉上逼真,并与给定的提示紧密对齐。实验结果表明,GaussEdit在编辑精度、视觉保真度和处理速度方面均优于现有方法。通过成功地将用户指定的概念嵌入到3D场景中,GaussEdit成为一个强大的工具,用于详细的、用户驱动的3D场景编辑,与传统方法相比有了显著的改进。

🔬 方法详解

问题定义:现有3D场景编辑方法通常难以在保持全局场景一致性的同时,实现对局部区域的精细编辑。此外,如何根据用户提供的文本或图像提示,准确地将目标概念融入3D场景,并保证编辑结果的视觉真实性,也是一个挑战。现有方法在编辑精度、视觉保真度和处理速度上存在局限性。

核心思路:GaussEdit的核心思路是利用3D高斯溅射(3D Gaussian Splatting)作为场景表示的骨干,因为它具有可微渲染的特性,能够实现高效的优化和编辑。同时,采用自适应全局-局部优化策略,平衡全局场景的一致性和局部编辑的细节。此外,利用图像到图像的合成技术,增强编辑对象的纹理,提高视觉真实性。

技术框架:GaussEdit的整体框架包含三个主要阶段:1) 初始化阶段:初始化3D高斯参数,为后续编辑提供良好的基础。2) 自适应优化阶段:采用自适应全局-局部优化策略,根据用户提供的文本或图像提示,对场景进行编辑。该阶段还包括类别引导的正则化,以缓解Janus问题。3) 纹理增强阶段:使用图像到图像的合成技术,增强编辑对象的纹理,提高视觉真实性。

关键创新:GaussEdit的关键创新在于:1) 提出了一种自适应全局-局部优化策略,能够在保持全局场景一致性的同时,实现对局部区域的精细编辑。2) 采用类别引导的正则化技术,有效缓解了Janus问题。3) 结合3D高斯溅射和图像到图像合成技术,实现了高效且视觉真实的3D场景编辑。

关键设计:自适应全局-局部优化策略通过动态调整全局和局部优化的权重,平衡场景一致性和编辑细节。类别引导的正则化利用预训练的分类器,对编辑区域进行类别约束,防止出现不合理的形变。图像到图像合成技术采用Stable Diffusion等模型,根据文本或图像提示,生成高质量的纹理细节。

🖼️ 关键图片

📊 实验亮点

GaussEdit在编辑精度、视觉保真度和处理速度方面均优于现有方法。实验结果表明,GaussEdit能够生成与用户提供的文本和图像提示高度一致的3D场景编辑结果。相较于现有方法,GaussEdit在定量指标和视觉效果上均有显著提升,能够更真实地反映用户的编辑意图。

🎯 应用场景

GaussEdit可应用于游戏开发、虚拟现实、增强现实、室内设计、电影制作等领域。它能够帮助用户快速、高效地编辑3D场景,将用户指定的概念融入场景中,创造出更具创意和个性化的3D内容。该研究的潜在价值在于降低3D内容创作的门槛,提高创作效率,并为用户提供更强大的3D场景编辑工具。

📄 摘要(原文)

This paper presents GaussEdit, a framework for adaptive 3D scene editing guided by text and image prompts. GaussEdit leverages 3D Gaussian Splatting as its backbone for scene representation, enabling convenient Region of Interest selection and efficient editing through a three-stage process. The first stage involves initializing the 3D Gaussians to ensure high-quality edits. The second stage employs an Adaptive Global-Local Optimization strategy to balance global scene coherence and detailed local edits and a category-guided regularization technique to alleviate the Janus problem. The final stage enhances the texture of the edited objects using a sophisticated image-to-image synthesis technique, ensuring that the results are visually realistic and align closely with the given prompts. Our experimental results demonstrate that GaussEdit surpasses existing methods in editing accuracy, visual fidelity, and processing speed. By successfully embedding user-specified concepts into 3D scenes, GaussEdit is a powerful tool for detailed and user-driven 3D scene editing, offering significant improvements over traditional methods.