Generating Detailed Character Motion from Blocking Poses

作者: Purvi Goel, Guy Tevet, C. K. Liu, Kayvon Fatahalian

分类: cs.GR

发布日期: 2025-09-19

💡 一句话要点

提出一种基于扩散模型的运动细节生成方法,从粗略姿势生成精细动画

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 运动细节生成 扩散模型 角色动画 关键帧姿势 运动重定时

📋 核心要点

- 现有方法难以利用扩散模型先验知识,从稀疏的关键帧姿势中生成具有丰富细节的角色动画。

- 提出一种推理时融合策略,在扩散过程中巧妙地结合无条件扩散模型的输出和关键帧姿势约束。

- 实验表明,该方法能有效生成高质量的角色动画,优于现有基于混合或指导的方法。

📝 摘要(中文)

本文关注运动细节生成问题,即如何将粗略的角色动画(由稀疏、粗略且时间不精确的关键帧姿势表示)转换为精细、自然的动画。现有扩散模型可以校正姿势的时间,但无法有效利用扩散先验来增强稀疏的关键帧姿势,添加细节。本文提出一种简单的推理时技巧来解决此问题:在特定扩散步骤中,使用每个关键帧姿势的容差权重,将无条件扩散模型的输出与输入的关键帧姿势约束融合,并将结果作为条件输入到现有的运动重定时模型。实验表明,该方法显著优于通过混合模型输出或将关键帧姿势约束表达为指导的现有方法。该方法是第一个能够稳健地将关键帧级别的姿势转换为合理的精细角色动画的扩散模型。

🔬 方法详解

问题定义:论文旨在解决从粗略的关键帧姿势生成精细角色动画的问题。现有方法要么无法有效利用扩散模型的先验知识来填充细节,要么在融合关键帧约束时效果不佳,导致生成的动画不够自然和精细。现有方法在处理稀疏和时间不精确的关键帧姿势时存在局限性。

核心思路:论文的核心思路是在扩散模型的推理过程中,通过一种巧妙的融合策略,将无条件扩散模型的输出与输入的关键帧姿势约束相结合。这种融合不是简单地混合,而是根据每个关键帧姿势的容差权重进行加权,从而允许模型在满足关键帧约束的同时,自由地生成细节。

技术框架:整体框架包含以下几个关键步骤:1) 输入粗略的关键帧姿势;2) 使用无条件扩散模型生成初始的运动序列;3) 在扩散过程的特定步骤,根据关键帧姿势的容差权重,将无条件扩散模型的输出与关键帧姿势约束进行融合;4) 将融合后的结果作为条件输入到现有的运动重定时模型中,以校正时间不精确的姿势;5) 迭代执行扩散和融合步骤,最终生成精细的角色动画。

关键创新:最重要的创新点在于推理时融合策略。与直接混合模型输出或将关键帧姿势约束作为指导信号不同,该方法在扩散过程的中间步骤进行融合,允许模型在满足约束的同时,利用扩散模型的先验知识生成自然的运动细节。这种方法能够更有效地平衡约束和生成,从而产生更逼真的动画。

关键设计:关键设计包括:1) 每个关键帧姿势的容差权重,用于控制约束的强度;2) 融合步骤的选择,需要在扩散过程的适当阶段进行,以平衡约束和生成;3) 使用现有的运动重定时模型,以校正时间不精确的姿势。具体的参数设置和网络结构细节可能依赖于所使用的扩散模型和运动重定时模型。

🖼️ 关键图片

📊 实验亮点

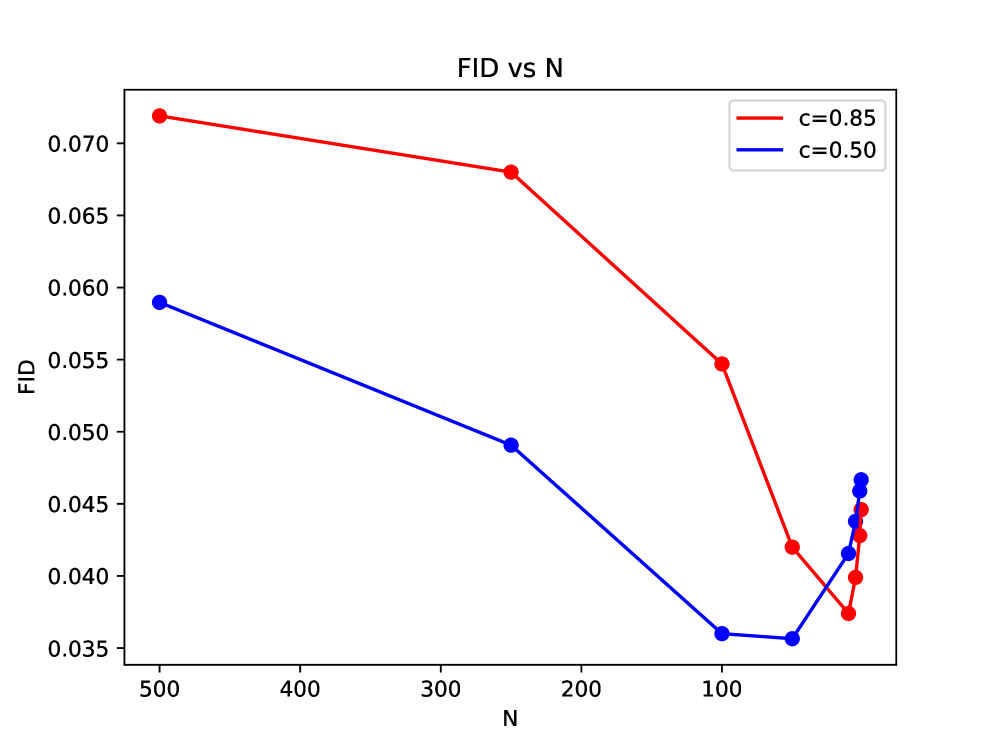

该方法在生成精细角色动画方面取得了显著的性能提升,优于现有的基于混合或指导的方法。实验结果表明,该方法能够从稀疏的关键帧姿势生成高质量的角色动画,具有更好的自然性和细节丰富度。具体性能数据和对比基线的提升幅度在论文中进行了详细的量化评估。

🎯 应用场景

该研究成果可应用于游戏开发、电影制作、虚拟现实等领域,能够显著提升角色动画的制作效率和质量。通过从粗略姿势自动生成精细动画,可以减少动画师的手工工作量,并为角色赋予更生动自然的表现力。未来,该技术有望进一步扩展到更复杂的角色和场景,实现更高级的动画生成。

📄 摘要(原文)

We focus on the problem of using generative diffusion models for the task of motion detailing: converting a rough version of a character animation, represented by a sparse set of coarsely posed, and imprecisely timed blocking poses, into a detailed, natural looking character animation. Current diffusion models can address the problem of correcting the timing of imprecisely timed poses, but we find that no good solution exists for leveraging the diffusion prior to enhance a sparse set of blocking poses with additional pose detail. We overcome this challenge using a simple inference-time trick. At certain diffusion steps, we blend the outputs of an unconditioned diffusion model with input blocking pose constraints using per-blocking-pose tolerance weights, and pass this result in as the input condition to an pre-existing motion retiming model. We find this approach works significantly better than existing approaches that attempt to add detail by blending model outputs or via expressing blocking pose constraints as guidance. The result is the first diffusion model that can robustly convert blocking-level poses into plausible detailed character animations.