CraftMesh: High-Fidelity Generative Mesh Manipulation via Poisson Seamless Fusion

作者: James Jincheng, Yuxiao Wu, Youcheng Cai, Ligang Liu

分类: cs.GR, cs.AI

发布日期: 2025-09-17 (更新: 2025-12-26)

💡 一句话要点

CraftMesh:通过泊松无缝融合实现高保真生成式网格操作

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 生成式网格编辑 泊松融合 3D内容创作 几何融合 纹理协调

📋 核心要点

- 现有生成式网格编辑方法难以处理复杂几何,且生成结果细节不足,限制了3D内容创作。

- CraftMesh分解编辑流程,先编辑2D图像,再生成局部3D网格,最后无缝融合,兼顾2D和3D优势。

- CraftMesh提出泊松几何融合与纹理协调,实现几何与纹理的无缝集成,实验结果优于现有方法。

📝 摘要(中文)

可控的高保真网格编辑仍然是3D内容创作中的一个重大挑战。现有的生成方法通常难以处理复杂的几何形状,并且无法产生精细的结果。我们提出了CraftMesh,这是一个通过泊松无缝融合实现高保真生成式网格操作的新框架。我们的核心思想是将网格编辑分解为一个利用2D和3D生成模型优势的流程:我们编辑2D参考图像,然后生成特定区域的3D网格,并将其无缝融合到原始模型中。我们引入了两项核心技术:泊松几何融合,它利用混合SDF/网格表示与法线混合来实现和谐的几何集成;以及泊松纹理协调,用于实现视觉上一致的纹理混合。实验结果表明,CraftMesh优于最先进的方法,在复杂的编辑任务中提供了卓越的全局一致性和局部细节。

🔬 方法详解

问题定义:现有生成式网格编辑方法在处理复杂几何形状时,难以保证生成结果的细节和质量。直接在3D空间进行编辑往往面临优化困难,而基于2D图像的生成方法又难以精确控制3D几何形状。因此,如何实现对复杂网格的高保真、可控编辑是一个关键问题。

核心思路:CraftMesh的核心思路是将3D网格编辑问题分解为2D图像编辑和3D网格融合两个步骤。首先,利用成熟的2D生成模型对参考图像进行编辑,从而实现对编辑意图的精确控制。然后,基于编辑后的2D图像生成对应的局部3D网格,最后将该网格无缝融合到原始3D模型中。这种分解策略充分利用了2D和3D生成模型的优势,简化了编辑流程。

技术框架:CraftMesh的整体框架包含以下三个主要阶段:1) 2D图像编辑:使用现有的2D生成模型(如GAN或扩散模型)对参考图像进行编辑,得到编辑后的图像。2) 局部3D网格生成:基于编辑后的2D图像,生成对应的局部3D网格。这一步可以使用各种3D生成方法,例如基于深度图重建或神经渲染的方法。3) 泊松无缝融合:将生成的局部3D网格无缝融合到原始3D模型中,同时保证几何和纹理的连续性。

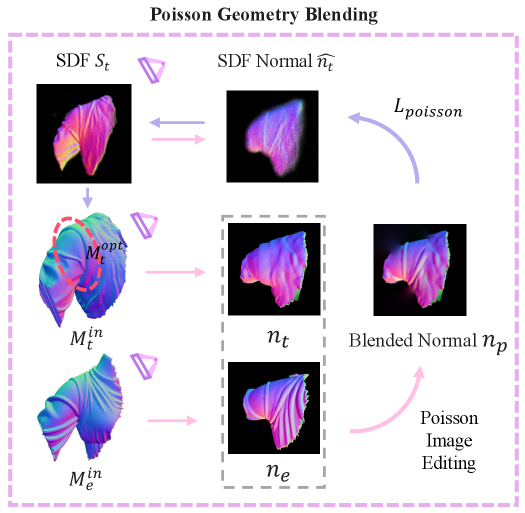

关键创新:CraftMesh的关键创新在于泊松无缝融合技术,包括泊松几何融合和泊松纹理协调。泊松几何融合利用混合SDF/网格表示,通过法线混合实现几何形状的平滑过渡。泊松纹理协调则通过求解泊松方程,实现纹理的无缝融合,保证视觉上的一致性。这种融合方法避免了直接进行网格变形可能导致的失真和不连续性。

关键设计:泊松几何融合的关键在于混合SDF/网格表示和法线混合策略。SDF(Signed Distance Function)可以平滑地表示几何形状,而网格则可以提供精确的表面细节。通过将两者结合,可以实现几何形状的平滑过渡和细节保留。法线混合则通过加权平均的方式,将局部网格和原始模型的法线进行融合,从而保证表面的连续性。泊松纹理协调则通过最小化纹理梯度差异来求解泊松方程,实现纹理的无缝融合。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CraftMesh在复杂的编辑任务中,能够生成具有卓越全局一致性和局部细节的3D模型,优于现有的最先进方法。具体而言,CraftMesh在几何融合和纹理协调方面表现出色,能够避免网格变形导致的失真和不连续性,并保证视觉上的一致性。定量评估和用户研究也证实了CraftMesh的优越性。

🎯 应用场景

CraftMesh在3D内容创作、虚拟现实、游戏开发等领域具有广泛的应用前景。它可以用于快速生成和编辑3D模型,例如角色定制、场景设计、产品原型设计等。通过CraftMesh,用户可以更加方便地对3D模型进行修改和调整,从而提高创作效率和质量。未来,CraftMesh有望成为3D内容创作的重要工具。

📄 摘要(原文)

Controllable, high-fidelity mesh editing remains a significant challenge in 3D content creation. Existing generative methods often struggle with complex geometries and fail to produce detailed results. We propose CraftMesh, a novel framework for high-fidelity generative mesh manipulation via Poisson Seamless Fusion. Our key insight is to decompose mesh editing into a pipeline that leverages the strengths of 2D and 3D generative models: we edit a 2D reference image, then generate a region-specific 3D mesh, and seamlessly fuse it into the original model. We introduce two core techniques: Poisson Geometric Fusion, which utilizes a hybrid SDF/Mesh representation with normal blending to achieve harmonious geometric integration, and Poisson Texture Harmonization for visually consistent texture blending. Experimental results demonstrate that CraftMesh outperforms state-of-the-art methods, delivering superior global consistency and local detail in complex editing tasks.