Chord: Chain of Rendering Decomposition for PBR Material Estimation from Generated Texture Images

作者: Zhi Ying, Boxiang Rong, Jingyu Wang, Maoyuan Xu

分类: cs.GR, cs.CV

发布日期: 2025-09-12

备注: Accepted to SIGGRAPH Asia 2025. Project page: https://ubisoft-laforge.github.io/world/chord

💡 一句话要点

提出Chord:一种链式渲染分解方法,用于从生成纹理图像中估计PBR材质

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: PBR材质估计 SVBRDF 扩散模型 链式分解 纹理生成

📋 核心要点

- 现有PBR材质生成方法在质量、灵活性和用户控制方面存在不足,限制了其在实际应用中的效果。

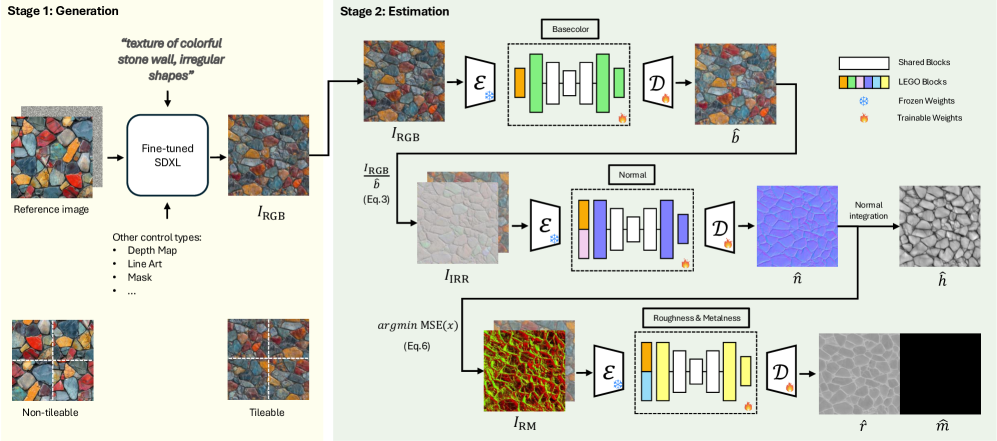

- Chord通过两阶段框架解决上述问题:首先生成高质量纹理图像,然后使用链式分解方案估计SVBRDF通道。

- 实验表明,Chord在材质生成和估计方面优于现有方法,并在各种应用中展现出强大的灵活性和鲁棒性。

📝 摘要(中文)

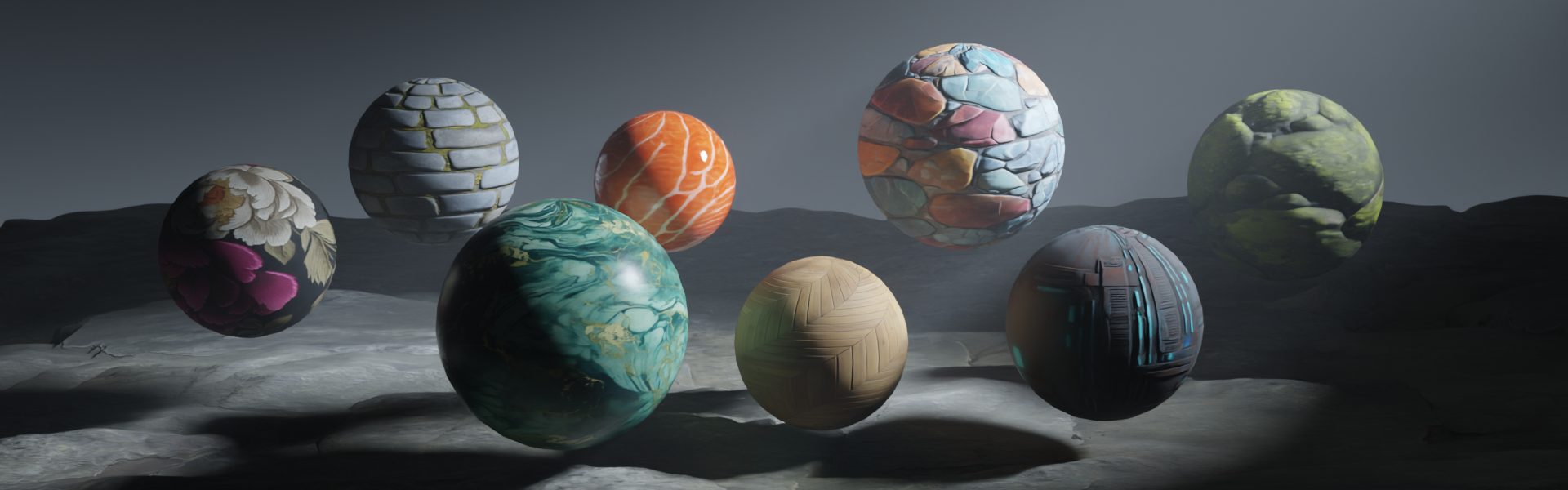

材质创建和重建对于外观建模至关重要,但传统上需要艺术家花费大量时间和专业知识。虽然最近的方法利用视觉基础模型从用户提供的输入合成PBR材质,但它们在质量、灵活性和用户控制方面往往不足。我们提出了一种新颖的两阶段生成和估计框架用于PBR材质生成。在生成阶段,微调的扩散模型合成与用户输入对齐的阴影、可平铺的纹理图像。在估计阶段,我们引入了一种链式分解方案,通过将先前提取的表示作为输入传递到单步图像条件扩散模型中,从而顺序预测SVBRDF通道。我们的方法高效、高质量,并支持灵活的用户控制。我们针对现有的材质生成和估计方法评估了我们的方法,证明了其卓越的性能。我们的材质估计方法在生成的纹理和真实照片上都表现出强大的鲁棒性。此外,我们强调了我们的框架在各种应用中的灵活性,包括文本到材质、图像到材质、结构引导生成和材质编辑。

🔬 方法详解

问题定义:论文旨在解决从生成纹理图像中准确高效地估计PBR材质的问题。现有方法通常需要大量人工干预,且在处理复杂材质时效果不佳,缺乏灵活性和用户控制能力。这些方法难以生成高质量、可控的PBR材质,限制了其在游戏、电影等领域的应用。

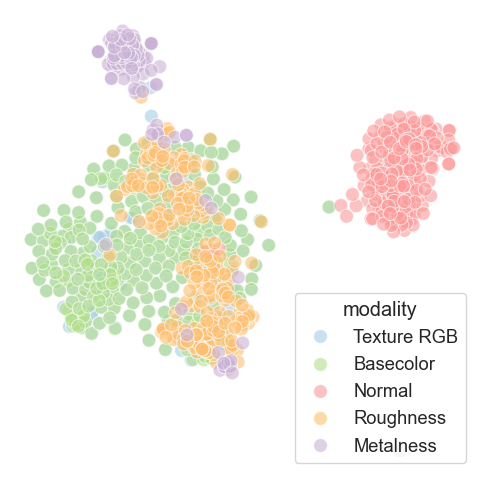

核心思路:论文的核心思路是将PBR材质估计分解为两个阶段:首先,使用扩散模型生成高质量的纹理图像;然后,通过链式分解方案,逐步估计SVBRDF的各个通道。这种分解方法允许模型逐步学习材质的各个属性,从而提高估计的准确性和鲁棒性。此外,通过用户输入引导纹理生成,实现灵活的用户控制。

技术框架:Chord框架包含两个主要阶段:生成阶段和估计阶段。在生成阶段,使用微调的扩散模型,根据用户提供的文本、图像或结构信息,生成具有阴影和可平铺特性的纹理图像。在估计阶段,采用链式分解方案,依次预测SVBRDF的各个通道(例如,漫反射率、法线、粗糙度等)。每个通道的预测都以先前预测的通道作为条件输入,从而实现更准确的估计。

关键创新:论文的关键创新在于链式分解方案。与传统的直接预测SVBRDF的方法不同,Chord通过逐步预测各个通道,并利用通道之间的依赖关系,提高了估计的准确性和鲁棒性。此外,将生成模型和估计模型相结合,实现了端到端的PBR材质生成和估计,简化了流程并提高了效率。

关键设计:在生成阶段,使用Stable Diffusion等预训练扩散模型,并针对PBR材质生成任务进行微调。在估计阶段,使用图像条件扩散模型,以生成的纹理图像和先前预测的SVBRDF通道作为输入,预测下一个通道。损失函数包括L1损失、感知损失等,用于保证生成和估计的质量。网络结构采用U-Net等常用的图像生成网络。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Chord在材质生成和估计方面均优于现有方法。在材质生成方面,Chord生成的纹理图像质量更高,细节更丰富。在材质估计方面,Chord估计的SVBRDF通道更准确,与真实材质更接近。此外,Chord在处理真实照片时也表现出强大的鲁棒性。定量指标和视觉效果均表明,Chord具有显著的优势。

🎯 应用场景

该研究成果可广泛应用于游戏开发、电影制作、虚拟现实等领域。通过Chord,艺术家可以更快速、更便捷地创建高质量的PBR材质,从而提高工作效率并降低成本。此外,该方法还可以用于材质编辑和风格迁移,为用户提供更大的创作自由。未来,该技术有望进一步发展,实现更加智能化的材质生成和编辑。

📄 摘要(原文)

Material creation and reconstruction are crucial for appearance modeling but traditionally require significant time and expertise from artists. While recent methods leverage visual foundation models to synthesize PBR materials from user-provided inputs, they often fall short in quality, flexibility, and user control. We propose a novel two-stage generate-and-estimate framework for PBR material generation. In the generation stage, a fine-tuned diffusion model synthesizes shaded, tileable texture images aligned with user input. In the estimation stage, we introduce a chained decomposition scheme that sequentially predicts SVBRDF channels by passing previously extracted representation as input into a single-step image-conditional diffusion model. Our method is efficient, high quality, and enables flexible user control. We evaluate our approach against existing material generation and estimation methods, demonstrating superior performance. Our material estimation method shows strong robustness on both generated textures and in-the-wild photographs. Furthermore, we highlight the flexibility of our framework across diverse applications, including text-to-material, image-to-material, structure-guided generation, and material editing.