Noise-Coded Illumination for Forensic and Photometric Video Analysis

作者: Peter F. Michael, Zekun Hao, Serge Belongie, Abe Davis

分类: cs.GR, cs.CR, cs.CV

发布日期: 2025-07-30

备注: ACM Transactions on Graphics (2025), presented at SIGGRAPH 2025

期刊: ACM Trans. Graph. 44, 5, Article 165 (October 2025), 16 pages

DOI: 10.1145/3742892

💡 一句话要点

提出噪声编码照明技术,用于取证和光度视频分析,增强视频真伪验证能力。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 视频取证 光度分析 噪声编码照明 信息不对称 视频真伪验证

📋 核心要点

- 现有视频篡改工具日益强大,真假视频难以区分,媒体操控者在获取真实视频资源方面具有优势。

- 该论文提出噪声编码照明方法,将细微噪声调制嵌入场景照明中,为视频添加时间水印,编码未篡改场景图像。

- 即使攻击者知晓该技术,伪造视频也面临更严峻的对抗性内容生成挑战,为视频验证创造信息不对称优势。

📝 摘要(中文)

本文提出了一种利用场景照明中细微的、类噪声调制进行视频取证的方法。通过将时间水印有效地嵌入到在编码照明下录制的视频中,该水印编码了未被篡改的场景图像。即使攻击者知晓该技术,创建逼真的伪造视频也需要解决一个更困难的对抗性内容生成问题,从而形成信息不对称,有利于视频验证。该方法适用于公共活动和访谈等高风险场景,在这些场景中,展示的内容容易被篡改,且照明可控但摄像机不可控。

🔬 方法详解

问题定义:当前视频篡改技术日益成熟,使得鉴别真假视频变得越来越困难。现有的视频取证方法难以应对攻击者利用大量真实视频数据进行学习和模仿的情况,攻击者可以轻易获取并利用这些数据,从而制造出难以辨别的虚假视频。因此,如何打破这种攻防双方的信息对称性,成为视频取证领域的一个重要挑战。

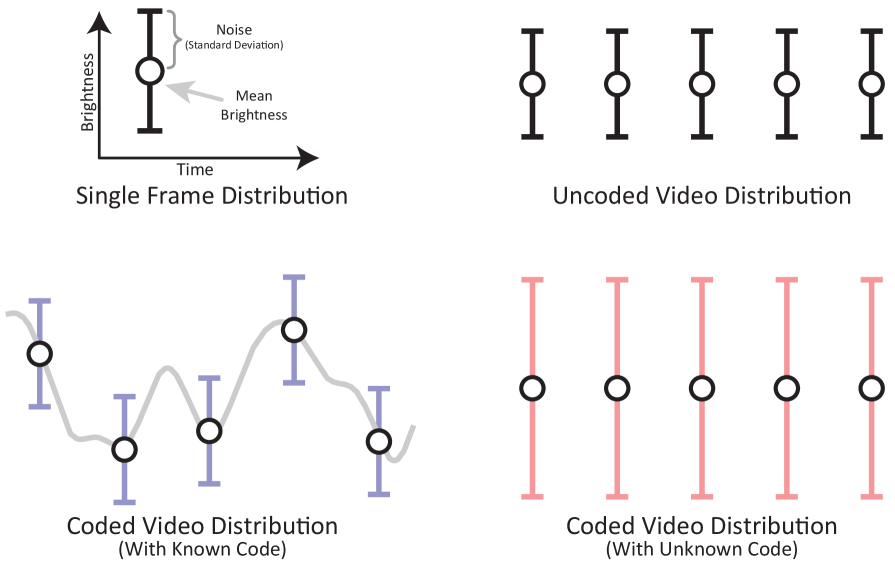

核心思路:该论文的核心思路是通过主动控制场景的照明,引入一种难以被攻击者复制的“噪声编码”,从而在视频中嵌入一种特殊的“水印”。这种水印不是传统意义上的消息,而是场景在特定照明条件下的光度信息。即使攻击者知道存在这种编码,也难以在伪造视频中完美地重现这种光照效果,从而为视频的真伪鉴别提供依据。

技术框架:该方法的核心在于使用特定的照明设备,将预先设计的噪声模式投射到场景中。这些噪声模式在时间上是变化的,但又是可控的。摄像机记录下带有这些噪声编码的视频。在验证阶段,通过分析视频中的光照变化,可以提取出嵌入的水印信息,并与原始场景在编码照明下的预期光照进行比较。如果视频被篡改,其光照信息将与预期不符,从而可以检测出篡改行为。

关键创新:该方法的关键创新在于将视频取证问题转化为一个信息不对称的问题。传统的视频取证方法往往依赖于对视频内容的分析,而该方法则通过控制视频的拍摄环境,引入了只有验证者才能掌握的信息。这种信息不对称使得攻击者在伪造视频时面临更大的挑战,因为他们不仅需要伪造视频内容,还需要完美地重现特定的光照效果。

关键设计:论文中关于噪声模式的设计、照明设备的选取以及光照信息的提取和分析算法等技术细节未知。论文可能涉及对照明设备的控制参数进行优化,以保证噪声编码的隐蔽性和鲁棒性。此外,可能还涉及到设计特定的损失函数,用于衡量视频中的光照信息与预期光照之间的差异。

🖼️ 关键图片

📊 实验亮点

由于论文中没有提供具体的实验数据,因此无法总结实验亮点。但是,该方法的核心思想在于通过主动控制照明来引入信息不对称,这为视频取证提供了一个新的思路。未来的研究可以关注如何设计更有效的噪声编码模式,以及如何提高该方法在各种复杂环境下的鲁棒性。

🎯 应用场景

该技术可应用于高风险场景的视频内容保护,例如公共活动、新闻发布会、法庭证据等。通过控制拍摄现场的照明,可以为视频添加难以伪造的“数字指纹”,从而提高视频的真实性和可信度。未来,该技术有望与区块链等技术结合,构建更安全的视频内容认证体系。

📄 摘要(原文)

The proliferation of advanced tools for manipulating video has led to an arms race, pitting those who wish to sow disinformation against those who want to detect and expose it. Unfortunately, time favors the ill-intentioned in this race, with fake videos growing increasingly difficult to distinguish from real ones. At the root of this trend is a fundamental advantage held by those manipulating media: equal access to a distribution of what we consider authentic (i.e., "natural") video. In this paper, we show how coding very subtle, noise-like modulations into the illumination of a scene can help combat this advantage by creating an information asymmetry that favors verification. Our approach effectively adds a temporal watermark to any video recorded under coded illumination. However, rather than encoding a specific message, this watermark encodes an image of the unmanipulated scene as it would appear lit only by the coded illumination. We show that even when an adversary knows that our technique is being used, creating a plausible coded fake video amounts to solving a second, more difficult version of the original adversarial content creation problem at an information disadvantage. This is a promising avenue for protecting high-stakes settings like public events and interviews, where the content on display is a likely target for manipulation, and while the illumination can be controlled, the cameras capturing video cannot.