Temporal Smoothness-Aware Rate-Distortion Optimized 4D Gaussian Splatting

作者: Hyeongmin Lee, Kyungjune Baek

分类: cs.GR

发布日期: 2025-07-23 (更新: 2026-01-13)

备注: 24 pages, 10 figures, NeurIPS 2025

🔗 代码/项目: GITHUB

💡 一句话要点

提出时域平滑感知的率失真优化4D高斯溅射压缩框架,提升动态场景渲染效率。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 4D高斯溅射 率失真优化 动态场景渲染 小波变换 视频压缩

📋 核心要点

- 现有4DGS方法存在高斯数量庞大、时域冗余度高,缺乏熵感知压缩框架等问题,导致存储需求巨大。

- 论文提出一种端到端率失真优化压缩框架,利用小波变换编码运动轨迹,反映时域平滑性先验,提升压缩效率。

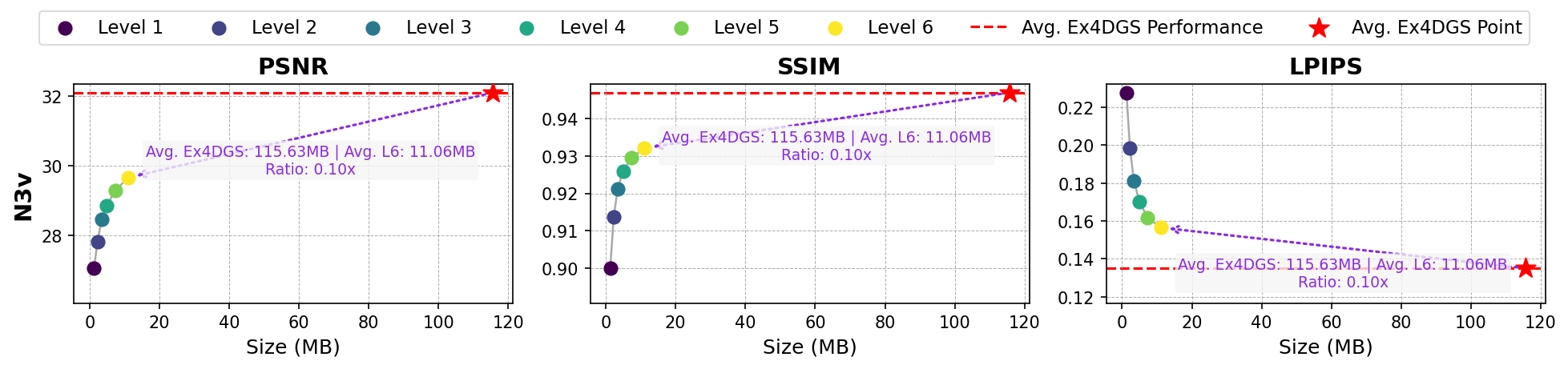

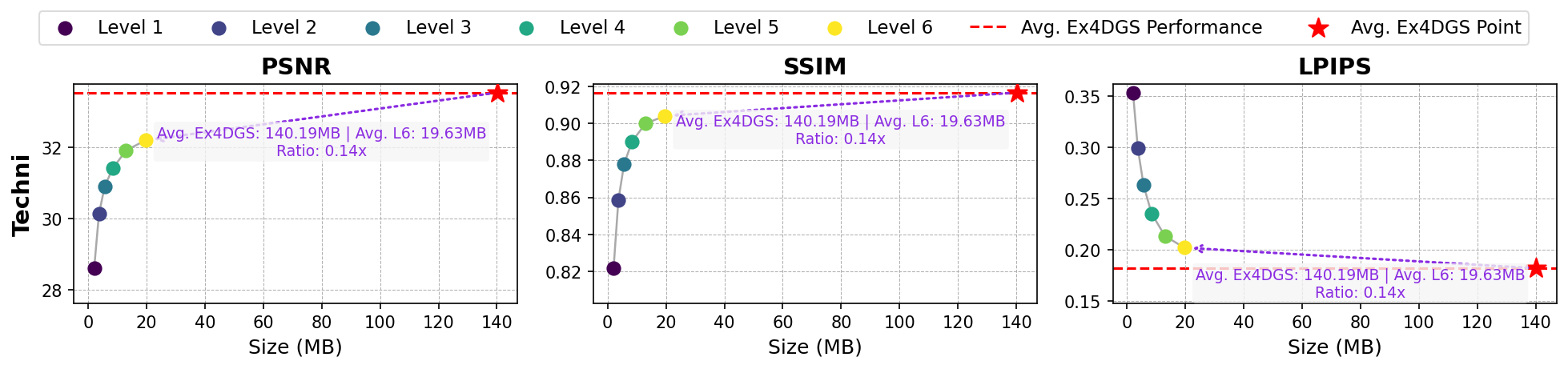

- 实验结果表明,该方法在保持高视觉保真度的前提下,实现了高达91倍的压缩率,适用于多种场景的实时渲染。

📝 摘要(中文)

本文提出了一种新颖的端到端率失真(RD)优化压缩框架,专为4D高斯溅射(4DGS)设计,旨在实现跨不同计算平台的灵活、高保真渲染。该框架以最先进的4DGS方法之一Fully Explicit Dynamic Gaussian Splatting (Ex4DGS)为基线,在兼容现有3DGS压缩方法的基础上,有效解决了时域引入的额外挑战。特别地,该方法没有独立存储每个点的运动轨迹,而是采用小波变换来反映真实世界的平滑性先验,从而显著提高了存储效率。这种方法显著提高了压缩率,并在压缩效率和渲染质量之间提供了用户可控的平衡。大量实验表明了该方法的有效性,与原始Ex4DGS模型相比,实现了高达91倍的压缩,同时保持了较高的视觉保真度。这些结果突出了该框架在各种场景中实时动态场景渲染的适用性,从资源受限的边缘设备到高性能环境。

🔬 方法详解

问题定义:现有的4D高斯溅射方法,例如Ex4DGS,虽然能够实现高质量的动态场景渲染,但由于模型参数量巨大,尤其是时域上的冗余信息,导致存储空间需求过高。这限制了其在边缘设备和数据传输等场景的应用。因此,需要一种高效的压缩方法,能够在保证渲染质量的前提下,显著降低模型大小。

核心思路:论文的核心思路是利用真实世界动态场景的时域平滑性先验知识,设计一种率失真优化的压缩框架。具体来说,不是独立存储每个高斯点的运动轨迹,而是通过小波变换将运动信息分解到不同的频率分量上,并对这些分量进行量化和编码。由于高频分量通常较小,可以采用更激进的量化策略,从而实现更高的压缩率。

技术框架:该框架以Ex4DGS为基础,主要包含以下几个阶段:1) 4DGS模型训练:使用Ex4DGS训练得到初始的动态场景表示。2) 运动轨迹提取:从训练好的模型中提取每个高斯点的运动轨迹。3) 小波变换:对运动轨迹进行小波变换,得到不同频率的分量。4) 率失真优化量化:根据率失真理论,对小波系数进行量化,目标是在给定的码率约束下,最小化渲染质量的损失。5) 熵编码:对量化后的系数进行熵编码,进一步压缩数据。6) 解码与渲染:解码压缩后的数据,恢复高斯点的位置和形状,并使用高斯溅射算法进行渲染。

关键创新:该方法最重要的创新点在于利用小波变换来编码高斯点的运动轨迹,从而有效地利用了时域平滑性先验。与直接存储运动轨迹相比,小波变换可以将能量集中到少数几个系数上,从而更容易进行压缩。此外,该方法还采用了率失真优化的量化策略,可以在压缩率和渲染质量之间进行权衡。

关键设计:在小波变换的选择上,论文可能采用了Daubechies小波或类似的紧支撑小波,以保证计算效率。在率失真优化量化方面,可能使用了拉格朗日乘子法,将码率约束转化为一个惩罚项,并与失真项一起进行优化。具体的损失函数可能包括渲染图像的PSNR或SSIM等指标,以及码率的估计值。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在保持高视觉保真度的情况下,与原始Ex4DGS模型相比,实现了高达91倍的压缩率。这意味着在相同的存储空间下,可以存储更多的动态场景数据,或者在相同的网络带宽下,可以传输更高质量的动态场景内容。此外,该方法还提供了用户可控的压缩率和渲染质量之间的平衡,可以根据不同的应用场景进行灵活调整。

🎯 应用场景

该研究成果可广泛应用于虚拟现实、增强现实、游戏开发、远程呈现等领域。通过高效压缩动态场景数据,可以降低存储和传输成本,提升用户体验,尤其是在移动设备和网络带宽受限的环境下,具有重要的应用价值。未来,该技术有望推动实时动态三维重建和渲染技术的发展。

📄 摘要(原文)

Dynamic 4D Gaussian Splatting (4DGS) effectively extends the high-speed rendering capabilities of 3D Gaussian Splatting (3DGS) to represent volumetric videos. However, the large number of Gaussians, substantial temporal redundancies, and especially the absence of an entropy-aware compression framework result in large storage requirements. Consequently, this poses significant challenges for practical deployment, efficient edge-device processing, and data transmission. In this paper, we introduce a novel end-to-end RD-optimized compression framework tailored for 4DGS, aiming to enable flexible, high-fidelity rendering across varied computational platforms. Leveraging Fully Explicit Dynamic Gaussian Splatting (Ex4DGS), one of the state-of-the-art 4DGS methods, as our baseline, we start from the existing 3DGS compression methods for compatibility while effectively addressing additional challenges introduced by the temporal axis. In particular, instead of storing motion trajectories independently per point, we employ a wavelet transform to reflect the real-world smoothness prior, significantly enhancing storage efficiency. This approach yields significantly improved compression ratios and provides a user-controlled balance between compression efficiency and rendering quality. Extensive experiments demonstrate the effectiveness of our method, achieving up to 91$\times$ compression compared to the original Ex4DGS model while maintaining high visual fidelity. These results highlight the applicability of our framework for real-time dynamic scene rendering in diverse scenarios, from resource-constrained edge devices to high-performance environments. The source code is available at https://github.com/HyeongminLEE/RD4DGS.