VolSegGS: Segmentation and Tracking in Dynamic Volumetric Scenes via Deformable 3D Gaussians

作者: Siyuan Yao, Chaoli Wang

分类: cs.GR

发布日期: 2025-07-16

💡 一句话要点

VolSegGS:通过可变形3D高斯实现动态体数据场景的分割与跟踪

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 体数据可视化 动态场景 3D高斯 分割 跟踪 神经渲染 交互式可视化

📋 核心要点

- 现有神经辐射场方法侧重于重建质量,缺乏对体数据场景中特征提取和跟踪等交互式探索的支持。

- VolSegGS利用可变形3D高斯表示动态体数据场景,并结合视角无关颜色和亲和场网络实现精确分割与跟踪。

- 实验表明,VolSegGS在低计算需求下,能够实时交互动态场景,并提供灵活的分割和跟踪功能。

📝 摘要(中文)

本文提出了一种名为VolSegGS的新型高斯溅射框架,旨在支持动态体数据场景中的交互式分割和跟踪,以用于探索性可视化和分析。该方法利用可变形的3D高斯来表示动态体数据场景,从而实现实时的新视角合成。为了实现精确的分割,该方法利用高斯点的视角无关颜色进行粗略分割,并使用亲和场网络细化结果。此外,通过将分割结果嵌入到高斯点中,确保它们的形变能够实现对分割区域随时间的连续跟踪。通过多个时变数据集验证了VolSegGS的有效性,并与最先进的方法进行了比较。VolSegGS具有实时交互动态场景的能力,并提供灵活的分割和跟踪功能,在低计算需求下提供了一个强大的解决方案,为时变体数据分析和可视化开辟了令人兴奋的新可能性。

🔬 方法详解

问题定义:现有方法在动态体数据场景的可视化中,侧重于重建质量,忽略了交互式探索的需求,例如特征提取和跟踪。这限制了领域科学家对复杂现象的分析能力,尤其是在计算资源有限的情况下。现有方法难以在保证实时性的前提下,提供精确的分割和跟踪功能。

核心思路:VolSegGS的核心思路是使用可变形的3D高斯来表示动态体数据场景。3D高斯具有可微性和高效渲染的特性,使其能够实现实时的新视角合成。通过将分割信息嵌入到高斯点中,并利用高斯点的形变来跟踪分割区域,从而实现动态场景中的连续跟踪。

技术框架:VolSegGS框架主要包含三个阶段:1) 使用可变形3D高斯表示动态体数据场景,并进行新视角合成;2) 利用高斯点的视角无关颜色进行粗略分割,并使用亲和场网络进行细化;3) 将分割结果嵌入到高斯点中,并通过高斯点的形变实现分割区域的跟踪。整体流程是先进行场景表示和渲染,然后进行分割,最后进行跟踪。

关键创新:VolSegGS的关键创新在于将可变形3D高斯与分割和跟踪任务相结合。具体来说,利用高斯点的视角无关颜色进行粗略分割,并使用亲和场网络进行细化,从而提高了分割的精度。此外,通过将分割结果嵌入到高斯点中,并利用高斯点的形变来实现分割区域的跟踪,从而实现了动态场景中的连续跟踪。

关键设计:在分割阶段,使用了亲和场网络来细化粗略分割结果。亲和场网络学习像素之间的相似性关系,从而能够更好地分割出具有相似特征的区域。在跟踪阶段,分割结果被嵌入到高斯点的特征向量中,并通过优化高斯点的形变参数来保持分割区域的一致性。损失函数包括重建损失、分割损失和跟踪损失,用于优化高斯点的参数。

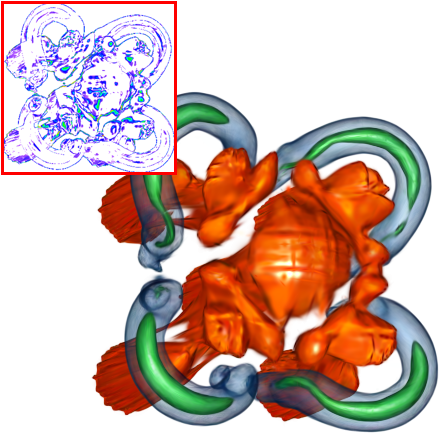

🖼️ 关键图片

📊 实验亮点

论文通过多个时变数据集验证了VolSegGS的有效性,并与最先进的方法进行了比较。实验结果表明,VolSegGS能够在保证实时性的前提下,实现精确的分割和跟踪。具体的性能数据和提升幅度在论文中有详细描述,例如在分割精度和跟踪准确率方面均优于对比方法。

🎯 应用场景

VolSegGS可应用于各种时变体数据分析和可视化领域,例如计算流体力学、医学成像和气候模拟。该框架能够帮助领域科学家更有效地探索和理解复杂现象,并为低计算资源环境下的交互式可视化提供了一种解决方案。未来,该技术可以进一步扩展到支持更复杂的分割和跟踪任务,例如多对象跟踪和语义分割。

📄 摘要(原文)

Visualization of large-scale time-dependent simulation data is crucial for domain scientists to analyze complex phenomena, but it demands significant I/O bandwidth, storage, and computational resources. To enable effective visualization on local, low-end machines, recent advances in view synthesis techniques, such as neural radiance fields, utilize neural networks to generate novel visualizations for volumetric scenes. However, these methods focus on reconstruction quality rather than facilitating interactive visualization exploration, such as feature extraction and tracking. We introduce VolSegGS, a novel Gaussian splatting framework that supports interactive segmentation and tracking in dynamic volumetric scenes for exploratory visualization and analysis. Our approach utilizes deformable 3D Gaussians to represent a dynamic volumetric scene, allowing for real-time novel view synthesis. For accurate segmentation, we leverage the view-independent colors of Gaussians for coarse-level segmentation and refine the results with an affinity field network for fine-level segmentation. Additionally, by embedding segmentation results within the Gaussians, we ensure that their deformation enables continuous tracking of segmented regions over time. We demonstrate the effectiveness of VolSegGS with several time-varying datasets and compare our solutions against state-of-the-art methods. With the ability to interact with a dynamic scene in real time and provide flexible segmentation and tracking capabilities, VolSegGS offers a powerful solution under low computational demands. This framework unlocks exciting new possibilities for time-varying volumetric data analysis and visualization.