MOSPA: Human Motion Generation Driven by Spatial Audio

作者: Shuyang Xu, Zhiyang Dou, Mingyi Shi, Liang Pan, Leo Ho, Jingbo Wang, Yuan Liu, Cheng Lin, Yuexin Ma, Wenping Wang, Taku Komura

分类: cs.GR, cs.CV, cs.RO

发布日期: 2025-07-16 (更新: 2025-11-02)

备注: NeurIPS 2025 (Spotlight)

🔗 代码/项目: GITHUB

💡 一句话要点

提出MOSPA,首个空间音频驱动人体运动生成框架与数据集

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion) 支柱八:物理动画 (Physics-based Animation)

关键词: 人体运动生成 空间音频 扩散模型 多模态融合 数据集 虚拟人 听觉感知

📋 核心要点

- 现有方法主要集中于语音、音频和音乐到人体运动的映射,忽略了空间音频信号中编码的空间特征对人体运动的影响。

- 论文提出了MOSPA框架,利用扩散模型生成人体运动,并设计了有效的融合机制来捕捉身体运动和空间音频之间的关系。

- 实验结果表明,MOSPA在作者构建的SAM数据集上取得了state-of-the-art的性能,验证了该方法的有效性。

📝 摘要(中文)

本文旨在解决虚拟人对不同听觉刺激做出动态和真实反应的关键挑战,特别是空间音频对人体运动的影响。为此,作者构建了首个全面的空间音频驱动人体运动(SAM)数据集,包含多样且高质量的空间音频和运动数据。同时,提出了一个简单而有效的基于扩散的生成框架MOSPA,用于空间音频驱动的人体运动生成,通过有效的融合机制忠实地捕捉身体运动和空间音频之间的关系。实验结果表明,MOSPA在提出的数据集上取得了最先进的性能。

🔬 方法详解

问题定义:现有的人体运动生成方法主要关注语音、音频和音乐等模态,忽略了空间音频中蕴含的空间信息对人体运动的影响。缺乏高质量的空间音频驱动人体运动的数据集,以及有效的模型来捕捉空间音频和人体运动之间的复杂关系。

核心思路:论文的核心思路是利用扩散模型,将空间音频作为条件,生成与之对应的自然人体运动。通过设计有效的融合机制,将空间音频的特征融入到扩散模型的生成过程中,从而使生成的运动能够准确地反映空间音频的空间信息。

技术框架:MOSPA框架主要包含以下几个模块:1) 空间音频特征提取模块,用于提取空间音频中的空间特征;2) 运动特征提取模块,用于提取人体运动的特征;3) 融合模块,将空间音频特征和运动特征进行融合;4) 扩散模型,以融合后的特征为条件,生成人体运动。整体流程是:首先提取空间音频和初始运动的特征,然后通过融合模块将二者融合,最后利用扩散模型逐步去噪,生成最终的人体运动。

关键创新:论文的关键创新在于:1) 构建了首个空间音频驱动人体运动(SAM)数据集,为相关研究提供了数据基础;2) 提出了MOSPA框架,利用扩散模型生成人体运动,并设计了有效的融合机制来捕捉空间音频和人体运动之间的关系。

关键设计:在扩散模型中,作者使用了U-Net结构作为backbone,并设计了专门的注意力机制来融合空间音频特征。损失函数主要包括L1损失和对抗损失,用于保证生成运动的真实性和多样性。具体的参数设置和网络结构细节可以在论文的补充材料中找到。

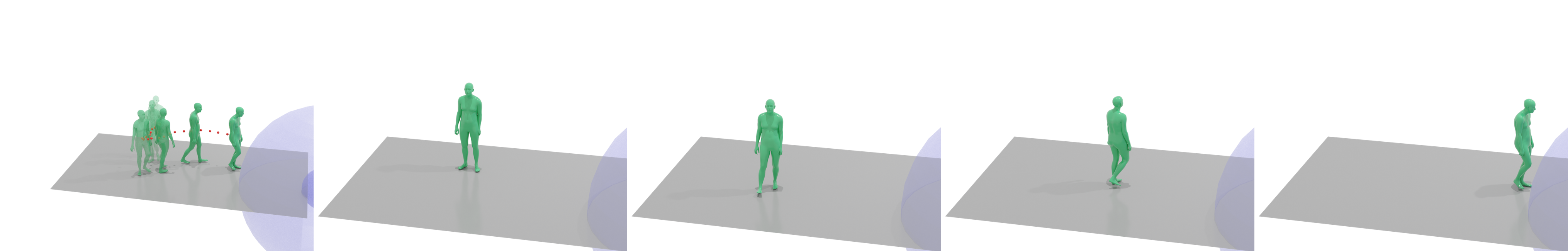

🖼️ 关键图片

📊 实验亮点

论文构建了首个大规模空间音频驱动人体运动数据集SAM,并提出了基于扩散模型的MOSPA框架。实验结果表明,MOSPA在SAM数据集上取得了state-of-the-art的性能。通过消融实验,验证了各个模块的有效性,例如,融合机制对于生成高质量运动至关重要。定性和定量结果均表明,MOSPA能够生成与空间音频相符的自然人体运动。

🎯 应用场景

该研究成果可应用于虚拟现实、游戏、机器人等领域。例如,在虚拟现实中,可以根据用户周围的声音环境,生成与之对应的虚拟人物的自然运动,从而增强用户的沉浸感。在游戏中,可以根据游戏中的音效,生成游戏角色的动作,使游戏更加生动有趣。在机器人领域,可以使机器人能够根据声音的来源和方向,做出相应的反应。

📄 摘要(原文)

Enabling virtual humans to dynamically and realistically respond to diverse auditory stimuli remains a key challenge in character animation, demanding the integration of perceptual modeling and motion synthesis. Despite its significance, this task remains largely unexplored. Most previous works have primarily focused on mapping modalities like speech, audio, and music to generate human motion. As of yet, these models typically overlook the impact of spatial features encoded in spatial audio signals on human motion. To bridge this gap and enable high-quality modeling of human movements in response to spatial audio, we introduce the first comprehensive Spatial Audio-Driven Human Motion (SAM) dataset, which contains diverse and high-quality spatial audio and motion data. For benchmarking, we develop a simple yet effective diffusion-based generative framework for human MOtion generation driven by SPatial Audio, termed MOSPA, which faithfully captures the relationship between body motion and spatial audio through an effective fusion mechanism. Once trained, MOSPA can generate diverse, realistic human motions conditioned on varying spatial audio inputs. We perform a thorough investigation of the proposed dataset and conduct extensive experiments for benchmarking, where our method achieves state-of-the-art performance on this task. Our code and model are publicly available at https://github.com/xsy27/Mospa-Acoustic-driven-Motion-Generation