SD-GS: Structured Deformable 3D Gaussians for Efficient Dynamic Scene Reconstruction

作者: Wei Yao, Shuzhao Xie, Letian Li, Weixiang Zhang, Zhixin Lai, Shiqi Dai, Ke Zhang, Zhi Wang

分类: cs.GR, cs.CV

发布日期: 2025-07-10

💡 一句话要点

SD-GS:用于高效动态场景重建的结构化可变形3D高斯

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱八:物理动画 (Physics-based Animation)

关键词: 动态场景重建 3D高斯splatting 可变形锚点网格 形变感知密度化 高效渲染 神经渲染 计算机视觉

📋 核心要点

- 现有4D高斯方法在动态场景重建中面临存储成本高和难以表征复杂运动的挑战。

- SD-GS通过可变形锚点网格和形变感知密度化策略,实现高效的动态场景重建。

- 实验表明,SD-GS在模型大小和渲染速度上均优于现有方法,同时保持或提升视觉质量。

📝 摘要(中文)

现有的用于动态场景重建的4D高斯框架虽然提供了令人印象深刻的视觉保真度和渲染速度,但存储成本和表征复杂物理运动的能力之间的固有权衡,极大地限制了这些方法的实际应用。为了解决这些问题,我们提出了SD-GS,一个紧凑而高效的动态高斯splatting框架,用于复杂的动态场景重建,具有两个关键贡献。首先,我们引入了一个可变形的锚点网格,这是一种分层且内存高效的场景表示,其中每个锚点在其局部时空区域内导出多个3D高斯,并作为3D场景的几何骨干。其次,为了增强复杂运动的建模能力,我们提出了一种感知变形的密度化策略,该策略自适应地在高动态的欠重建区域中增长锚点,同时减少静态区域中的冗余,从而以更少的锚点实现卓越的视觉质量。实验结果表明,与最先进的方法相比,SD-GS在模型大小上平均减少了60%,在FPS上平均提高了100%,从而在保持甚至超过视觉质量的同时,显着提高了计算效率。

🔬 方法详解

问题定义:现有动态场景重建方法,如4D高斯splatting,虽然能实现高视觉质量和快速渲染,但其存储成本高昂,难以有效表征复杂的物理运动。这限制了它们在实际应用中的可行性。因此,需要一种更紧凑、更高效的方法来重建动态场景。

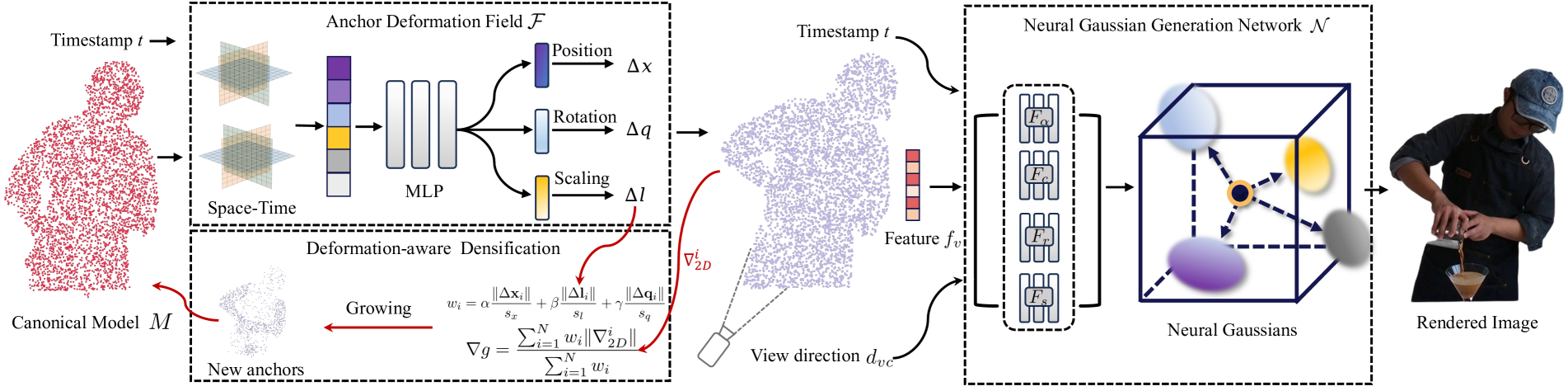

核心思路:SD-GS的核心思路是使用可变形的锚点网格作为场景的几何骨干。每个锚点代表一个局部时空区域,并导出多个3D高斯。通过这种分层结构,可以更有效地表示场景,并减少冗余。此外,采用形变感知密度化策略,自适应地调整锚点数量,从而在保证视觉质量的同时,降低存储成本。

技术框架:SD-GS框架主要包含以下几个阶段:1) 初始化:构建可变形的锚点网格,每个锚点关联多个3D高斯。2) 形变估计:估计每个锚点的形变参数,以捕捉场景的动态变化。3) 渲染:基于锚点网格和形变参数,渲染出最终的场景图像。4) 密度化:根据重建质量和动态程度,自适应地增加或减少锚点数量。

关键创新:SD-GS的关键创新在于:1) 引入了可变形的锚点网格,这是一种内存高效的分层场景表示。2) 提出了形变感知密度化策略,可以自适应地调整锚点数量,从而在保证视觉质量的同时,降低存储成本。与现有方法相比,SD-GS更紧凑、更高效,并且能够更好地表征复杂的动态场景。

关键设计:锚点网格的拓扑结构(例如,立方体网格或四面体网格)会影响重建质量和计算效率。形变参数可以使用线性混合蒙皮(LBS)或其他形变模型进行估计。密度化策略需要仔细设计,以平衡重建质量和锚点数量。损失函数通常包括渲染损失(例如,L1损失或感知损失)和正则化项(例如,形变正则化)。

🖼️ 关键图片

📊 实验亮点

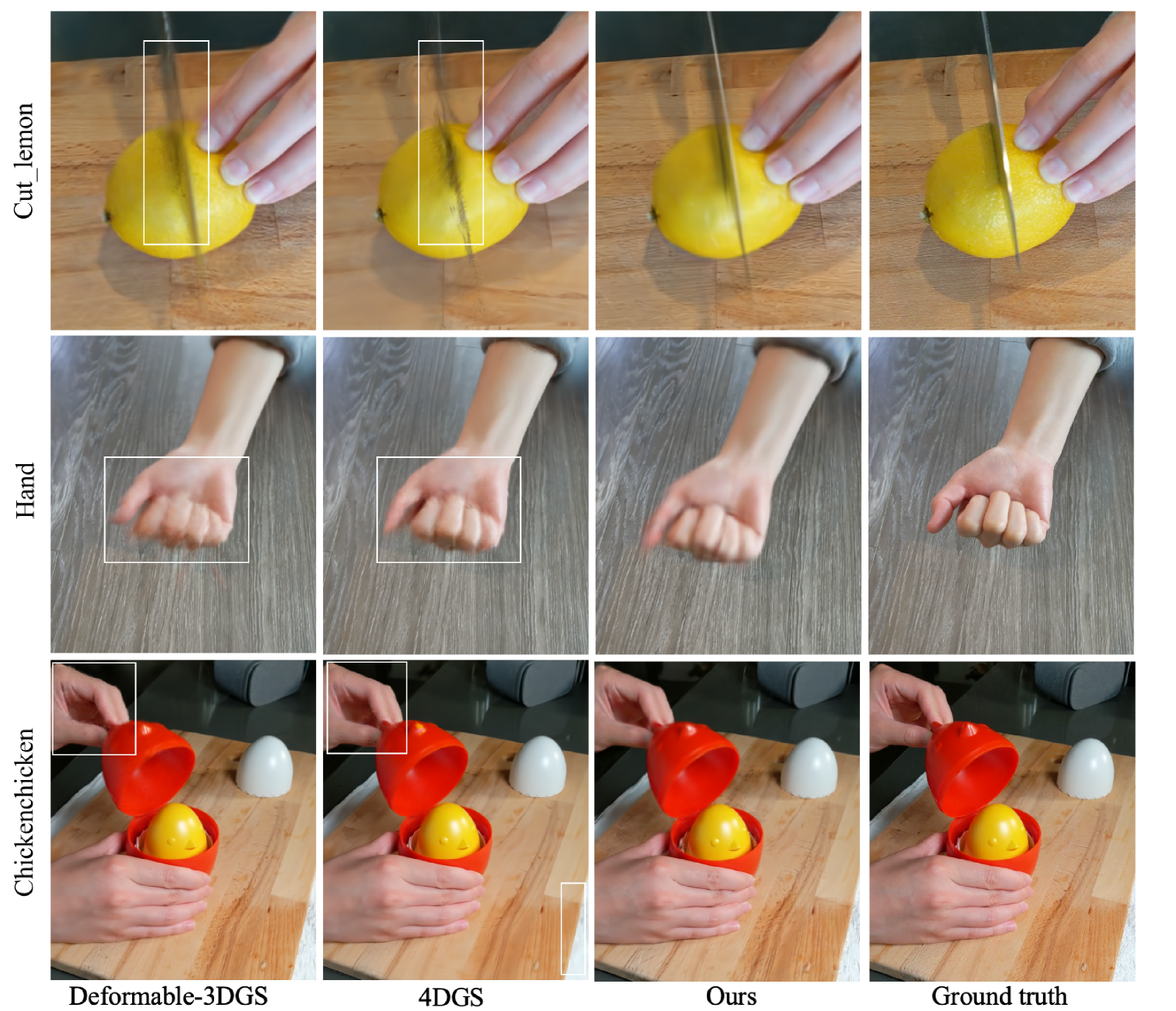

实验结果表明,SD-GS在模型大小上平均减少了60%,在FPS上平均提高了100%,同时保持或超过了现有方法的视觉质量。例如,在某些复杂动态场景中,SD-GS能够以更少的存储空间和更高的渲染速度,实现与最先进方法相当甚至更好的重建效果。这些结果证明了SD-GS在动态场景重建方面的优越性能。

🎯 应用场景

SD-GS在虚拟现实、增强现实、机器人导航、自动驾驶等领域具有广泛的应用前景。它可以用于创建逼真的动态虚拟环境,提高机器人对动态环境的感知能力,以及实现更安全、更可靠的自动驾驶系统。该研究的成果有助于推动这些领域的发展,并为人们带来更丰富的体验。

📄 摘要(原文)

Current 4D Gaussian frameworks for dynamic scene reconstruction deliver impressive visual fidelity and rendering speed, however, the inherent trade-off between storage costs and the ability to characterize complex physical motions significantly limits the practical application of these methods. To tackle these problems, we propose SD-GS, a compact and efficient dynamic Gaussian splatting framework for complex dynamic scene reconstruction, featuring two key contributions. First, we introduce a deformable anchor grid, a hierarchical and memory-efficient scene representation where each anchor point derives multiple 3D Gaussians in its local spatiotemporal region and serves as the geometric backbone of the 3D scene. Second, to enhance modeling capability for complex motions, we present a deformation-aware densification strategy that adaptively grows anchors in under-reconstructed high-dynamic regions while reducing redundancy in static areas, achieving superior visual quality with fewer anchors. Experimental results demonstrate that, compared to state-of-the-art methods, SD-GS achieves an average of 60\% reduction in model size and an average of 100\% improvement in FPS, significantly enhancing computational efficiency while maintaining or even surpassing visual quality.