A LoD of Gaussians: Unified Training and Rendering for Ultra-Large Scale Reconstruction with External Memory

作者: Felix Windisch, Thomas Köhler, Lukas Radl, Michael Steiner, Dieter Schmalstieg, Markus Steinberger

分类: cs.GR, cs.LG

发布日期: 2025-07-01 (更新: 2025-11-06)

💡 一句话要点

提出基于外存的LoD高斯表示,实现超大规模场景的统一训练与渲染

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 高斯溅射 三维重建 外存计算 细节层次 超大规模场景

📋 核心要点

- 现有高斯溅射方法难以扩展到超大规模场景,主要瓶颈在于GPU内存限制和场景分割引入的伪影。

- 提出LoD高斯表示,将完整场景存储在CPU内存中,动态流式传输相关高斯,实现统一训练和渲染。

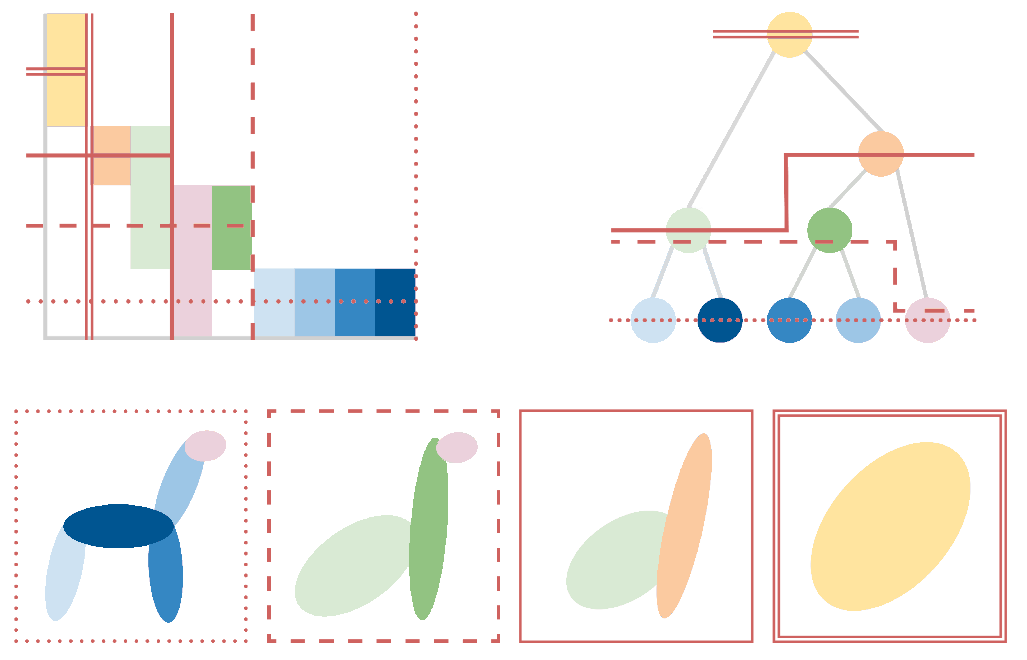

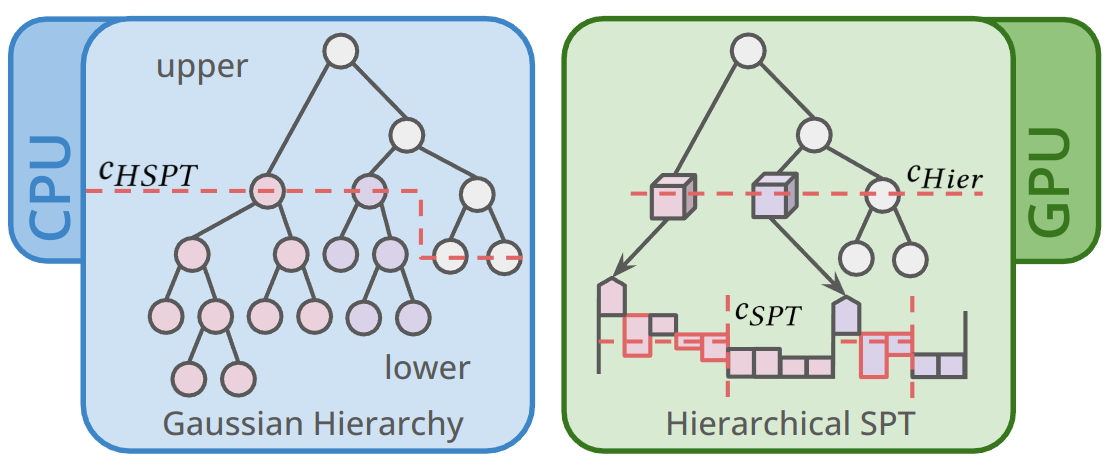

- 结合高斯层级结构和顺序点树,实现高效的视角相关LoD选择,并通过缓存和视角调度优化实时渲染。

📝 摘要(中文)

高斯溅射(Gaussian Splatting)已成为一种用于新视角合成的高性能技术,能够对小场景进行实时渲染和高质量重建。然而,扩展到更大的环境通常依赖于将场景分割成块,这种策略会在块边界引入伪影,使跨不同尺度的训练变得复杂,并且不适合非结构化场景,例如城市规模的飞行鸟瞰与街道视图的结合。此外,渲染在根本上受到GPU内存的限制,因为所有可见的块必须同时驻留在VRAM中。我们引入了一种高斯LoD(A LoD of Gaussians)框架,用于在单个消费级GPU上训练和渲染超大规模高斯场景,而无需进行分割。我们的方法将完整场景存储在核外(例如,在CPU内存中),并直接训练细节层次(LoD)表示,动态地流式传输相关的Gaussian。结合高斯层次结构与顺序点树的混合数据结构能够实现高效的、与视角相关的LoD选择,而轻量级的缓存和视角调度系统利用时间一致性来支持实时流式传输和渲染。总之,这些创新实现了复杂场景的无缝多尺度重建和交互式可视化,从广阔的航拍视图到精细的地面细节。

🔬 方法详解

问题定义:现有基于高斯溅射的三维重建方法在处理超大规模场景时面临挑战。主要痛点在于:1) GPU内存容量限制,无法同时加载整个场景;2) 为了处理大规模场景,通常采用分块策略,但分块会导致块边界出现伪影,影响重建质量;3) 分块策略使得跨尺度的训练变得复杂,难以处理非结构化场景。

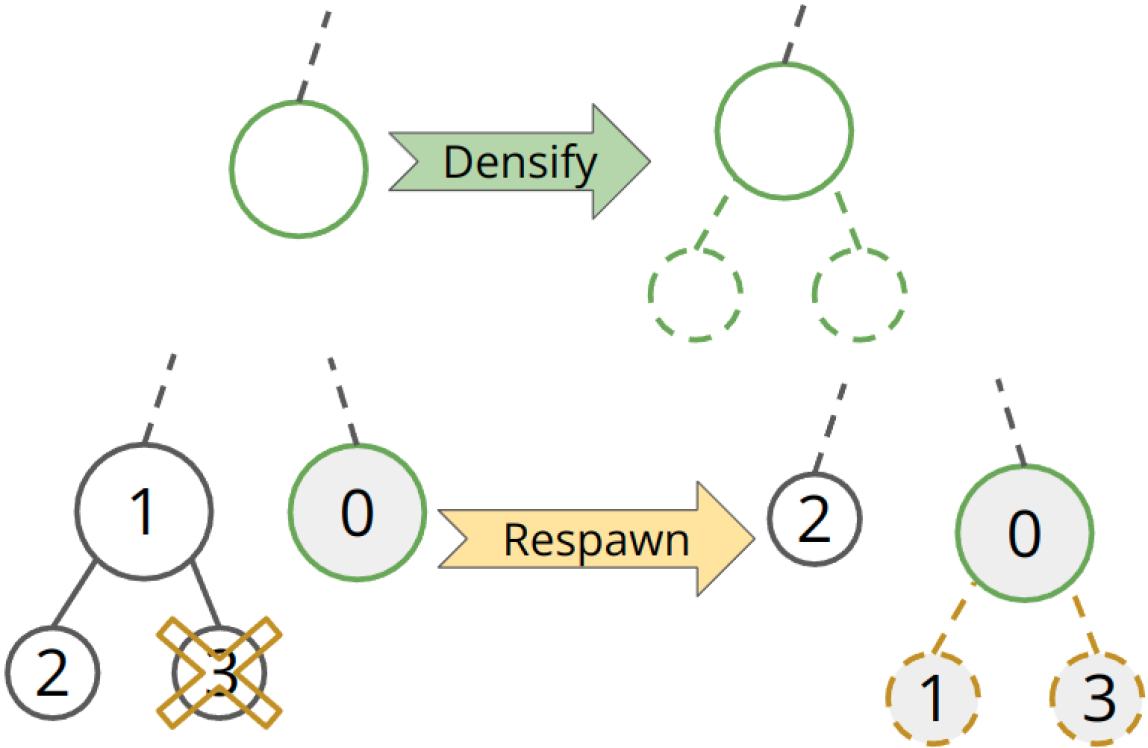

核心思路:论文的核心思路是引入Level-of-Detail (LoD) 的概念,对高斯模型进行分层表示,并结合外存存储,只将当前视角下需要的高斯模型加载到GPU进行渲染。通过动态加载和卸载高斯模型,突破GPU内存的限制,实现超大规模场景的渲染。同时,避免了分块策略带来的伪影问题。

技术框架:该框架主要包含以下几个模块:1) 外存存储:将完整的高斯场景存储在CPU内存中,作为数据源。2) LoD表示:构建高斯模型的层级结构,每一层代表不同的细节程度。3) 视角相关LoD选择:根据当前视角,动态选择合适的LoD层级。4) 数据流式传输:将选定的LoD数据从CPU内存传输到GPU内存。5) 缓存和视角调度:利用时间一致性,缓存常用的高斯模型,并优化视角调度,提高渲染效率。

关键创新:该论文的关键创新在于:1) 提出了基于外存的LoD高斯表示,突破了GPU内存的限制,实现了超大规模场景的渲染。2) 结合高斯层级结构和顺序点树,实现了高效的视角相关LoD选择。3) 设计了轻量级的缓存和视角调度系统,利用时间一致性,提高了渲染效率。

关键设计:1) 混合数据结构:结合高斯层级结构和顺序点树,用于高效的LoD选择。高斯层级结构用于表示不同细节程度的高斯模型,顺序点树用于加速空间查询。2) 视角相关LoD选择策略:根据高斯模型与视点的距离、高斯模型的大小等因素,动态选择合适的LoD层级。3) 缓存策略:缓存最近使用的高斯模型,减少数据传输的开销。4) 视角调度策略:优化视角的顺序,提高缓存命中率。

🖼️ 关键图片

📊 实验亮点

该论文提出的方法能够在单个消费级GPU上渲染超大规模的高斯场景,而无需进行场景分割。通过动态加载和卸载高斯模型,突破了GPU内存的限制。实验结果表明,该方法能够实现实时渲染,并且避免了分块策略带来的伪影问题。具体性能数据未知。

🎯 应用场景

该研究成果可广泛应用于城市级三维重建、虚拟现实、游戏开发、自动驾驶等领域。例如,可以用于构建城市级别的数字孪生,为城市规划、交通管理等提供支持。在虚拟现实和游戏开发中,可以用于创建更加逼真的场景。在自动驾驶中,可以用于构建高精地图,提高自动驾驶系统的安全性。

📄 摘要(原文)

Gaussian Splatting has emerged as a high-performance technique for novel view synthesis, enabling real-time rendering and high-quality reconstruction of small scenes. However, scaling to larger environments has so far relied on partitioning the scene into chunks -- a strategy that introduces artifacts at chunk boundaries, complicates training across varying scales, and is poorly suited to unstructured scenarios such as city-scale flyovers combined with street-level views. Moreover, rendering remains fundamentally limited by GPU memory, as all visible chunks must reside in VRAM simultaneously. We introduce A LoD of Gaussians, a framework for training and rendering ultra-large-scale Gaussian scenes on a single consumer-grade GPU -- without partitioning. Our method stores the full scene out-of-core (e.g., in CPU memory) and trains a Level-of-Detail (LoD) representation directly, dynamically streaming only the relevant Gaussians. A hybrid data structure combining Gaussian hierarchies with Sequential Point Trees enables efficient, view-dependent LoD selection, while a lightweight caching and view scheduling system exploits temporal coherence to support real-time streaming and rendering. Together, these innovations enable seamless multi-scale reconstruction and interactive visualization of complex scenes -- from broad aerial views to fine-grained ground-level details.